Estratégia de IA no Apoio ao Cliente: O Que Automatizar e O Que Manter Humano

A estratégia de IA no apoio ao cliente é um enquadramento para decidir onde a IA pode ajudar, onde deve escalar, e como as equipas de suporte mantêm as respostas precisas, alinhadas com as políticas e seguras em grande escala.

A maioria das equipas não falha porque a sua IA não é suficientemente inteligente. Os problemas surgem quando um assistente integrado é tratado como substituto seguro do discernimento humano. No apoio ao cliente, uma resposta errada dada com confiança sai cara. Pode desencadear reembolsos, violar políticas e minar silenciosamente a confiança. É por isso que uma estratégia de IA no apoio ao cliente é mais importante do que ativar mais uma funcionalidade de IA.

A verdadeira questão é quem toma a decisão e segundo que regras. Este guia mostra onde a automação é de baixo risco, onde precisa de revisão, e como manter resultados consistentes com Think → Verify → Act, salvaguardas contra alucinações e transições que preservam o contexto para que os clientes não tenham de se repetir.

O Que Significa Realmente "Estratégia de IA no Apoio ao Cliente" em 2026

Estratégia torna-se frequentemente sinónimo de simplesmente ativar a funcionalidade. Um equívoco comum é pensar que basta ligar um assistente ao helpdesk, apontá-lo para uma base de conhecimento e dar o assunto por encerrado. O outro extremo é o oposto: se o assistente consegue responder, deve responder a tudo. Ambas as abordagens falham habitualmente no mesmo tipo de pedidos: questões reais de clientes que exigem discernimento, exceções ou nuances nas políticas.

Uma estratégia sólida de experiência do cliente com IA é muito mais específica. Define claramente onde o assistente participa e onde não lhe é permitido tomar decisões. Também estabelece regras de qualidade, para que as respostas se mantenham fundamentadas à medida que as políticas, produtos e casos excecionais mudam.

Se não consegue explicar estes princípios básicos em linguagem simples, ainda não tem uma estratégia. Tem uma funcionalidade ativada e a esperança de que ela faça o resto.

Chatbots de IA, Assistentes de IA, Agentes de IA, Copilots: Papéis Sem Confusão

Estes termos confundem-se facilmente, e é assim que as equipas acabam por dar a uma ferramenta mais autonomia do que deviam. Para manter os conceitos claros, a tabela abaixo compara cada papel pela autonomia permitida e pelas falhas mais comuns.

| Papel | Autonomia permitida | Falhas típicas |

|---|---|---|

| Chatbot (scripts/FAQ) | Responde apenas ao que foi pré-escrito e aprovado. | Becos sem saída fora do guião; ciclos frustrantes. |

| Assistente de IA (IA integrada) | Integrado no Shopify ou Magento como funcionalidade de IA. Resume, redige rascunhos, classifica e sugere próximos passos. | Falha em nuances específicas da loja; rascunhos que ignoram casos excecionais; tom inconsistente sem orientação. |

| Chatbot de IA (respostas geradas) | Gera respostas com base nas fontes fornecidas e no contexto da conversa. | Alucinações; promessas excessivas; referências a políticas desatualizadas. |

| Agente de IA (ações + fluxo de trabalho) | Executa ações em vários sistemas com base em regras e aprovações. | Ações erradas em escala; problemas de conformidade; erros dispendiosos sem salvaguardas. |

| Copilot (para agentes) | Apoia o agente humano com rascunhos e sugestões; a pessoa decide o que é enviado ou executado. | Confiança excessiva; erros de copiar e colar; ganhos fracos se o contexto for insuficiente. |

Quando o nível de autonomia está errado, os erros escalam mais depressa do que a fila de suporte. O risco não está no nome. Está na responsabilidade indefinida.

Automação do Apoio ao Cliente: Onde a IA Ajuda e Onde Não Deve Decidir

Nem todas as tarefas de suporte são igualmente automatizáveis. Os ganhos mais seguros vêm de fluxos de trabalho onde o assistente não pode acidentalmente prometer dinheiro, contornar políticas ou desencadear ações irreversíveis.

Uma regra simples funciona bem: automatize o que é repetitivo e verificável, e mantenha um humano no circuito quando o pedido envolve discernimento, exceções ou um compromisso real.

Automação de alto valor e baixo risco

São tarefas onde a rapidez conta e a resposta pode ser fundamentada em fontes aprovadas.

- FAQ e questões básicas sobre políticas (quando o texto da política está atualizado)

- Recolha de dados (número de encomenda, e-mail, fotografias, motivo)

- Classificação e encaminhamento (identificação de intenção, prioridade)

- Resumos e rascunhos (síntese do ticket, resposta para revisão)

Automação de alto risco (requer controlo)

Estes pedidos parecem simples, mas um único detalhe em falta pode alterar o resultado correto.

- Devoluções (casos-limite de elegibilidade, prazos)

- Cancelamentos (fase de expedição, verificações de fraude)

- Promessas de entrega (encomendas em espera, restrições de armazém)

- Compensações (créditos, substituições, reembolsos de envio)

O que nunca deve ser totalmente autónomo

Se o resultado afeta dinheiro, exposição legal ou exceções à política, o sistema deve optar por uma transição controlada.

- Dinheiro (reembolsos, créditos, descontos)

- Compromissos legais (garantias, certificações, declarações de conformidade)

- Exceções às políticas (alterações manuais)

Matriz de Risco

Utilize uma matriz simples para definir o que o assistente pode fazer consoante a intenção. Isto mantém o apoio ao cliente automatizado consistente entre agentes, turnos e épocas de maior volume. Funciona como caminho por defeito: resposta automática para intenções de baixo risco, transferência quando é necessário discernimento humano, e bloqueio ou escalada nos casos críticos.

| Intenção / tarefa | Nível de risco | Automação permitida | Fontes / políticas necessárias |

|---|---|---|---|

| Onde está a minha encomenda? | Baixo | Resposta automática permitida | Política de envio + fonte de rastreamento |

| Alterar morada de envio | Médio | Transição | Regras de edição de encomenda + passos de verificação |

| Cancelar a minha encomenda | Alto | Transição / bloqueio em caso de incerteza | Política de cancelamento + estado do pagamento |

| Pedido de reembolso | Alto | Apenas transição | Política de reembolso + regras de elegibilidade + dados da encomenda |

| Pedido de desconto | Alto | Bloqueio + fluxo alternativo | Política de descontos + regras de escalamento |

| Garantia / reclamação legal | Crítico | Bloqueio + transição imediata | Política legal + aprovação humana |

Se uma intenção ainda não estiver mapeada, opte por uma transição e adicione-a quando a política e as fontes estiverem definidas.

IA vs Apoio Humano: Redija a Resposta, Aprove a Decisão

Quando um assistente está integrado no fluxo de trabalho de suporte, é tentador tratá-lo como um agente mais rápido. Mas rapidez não é o mesmo que responsabilidade. Uma resposta gerada pode parecer bem redigida e mesmo assim estar errada no ponto que mais importa: aquilo a que compromete o seu negócio.

O modelo mais seguro é simples: deixe a IA fazer o trabalho pesado, mas mantenha as decisões sob responsabilidade humana. Use IA generativa no apoio ao cliente para análise e redação de rascunhos, não para compromissos independentes.

O assistente pode ler a conversa, extrair detalhes relevantes, consultar fontes aprovadas e propor uma resposta fundamentada. Um humano aprova então o que é enviado ou redireciona o caso quando envolve dinheiro, exceções às políticas ou questões juridicamente sensíveis. Pense nisto como um rascunho e um editor. Continua a ser mais rápido, mas com salvaguardas.

Regra prática a partilhar: a IA deve redigir a resposta. A sua equipa deve aprovar a decisão.

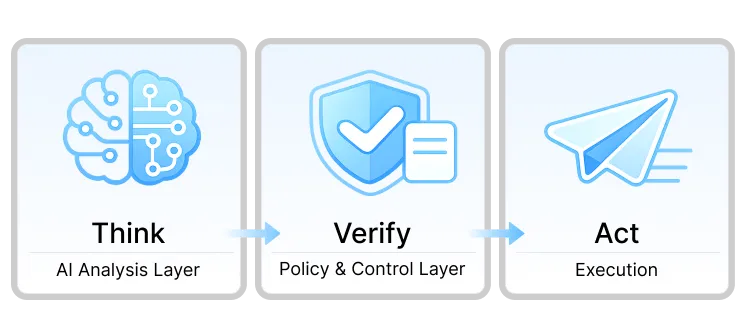

Arquitetura de IA no Apoio ao Cliente: Think → Verify → Act

Não precisa de um assistente que envie mensagens sozinho. Precisa de um fluxo de trabalho que separe a análise da aprovação e mantenha a execução sob controlo. Na prática, é uma implementação de IA no apoio ao cliente que ajuda a ser mais rápido no trabalho de rotina sem transformar casos excecionais em promessas feitas ao cliente.

Think: camada de análise da IA

O Think acontece nos bastidores. O assistente lê a mensagem e o histórico do ticket, identifica a intenção, extrai detalhes relevantes de fontes aprovadas e redige uma resposta com fundamentação, nível de confiança e sinalizadores de risco. É preparação, não uma promessa, por isso não deve ser a camada que fala com o cliente.

Verify: camada de política e controlo

O Verify é o ponto de verificação. O rascunho é comparado com as regras de negócio e as fontes em que se baseia. O fluxo de trabalho escolhe então um dos seguintes resultados:

- Resposta automática segura (intenções de baixo risco com fontes sólidas)

- Transição para humano (discernimento, exceções, contexto em falta)

- Bloqueio + fluxo alternativo (dinheiro, questões legais, pedidos pouco claros)

Act: execução

O Act é a saída controlada. Um caso seguro recebe uma resposta alinhada com a política. Tudo o que necessita de uma pessoa é encaminhado com o contexto essencial já preparado, para que o agente possa continuar sem reler toda a conversa. Casos bloqueados seguem um caminho alternativo, como recolher detalhes em falta ou escalar para um especialista.

Como funciona numa equipa real

No dia a dia, o assistente analisa o histórico completo, verifica a documentação e produz um breve resumo mais um rascunho de resposta. Um humano revê-o, ajusta as nuances e envia a resposta final. Se o rascunho não estiver à altura, o agente pede uma versão mais precisa e itera até ficar exata e utilizável.

A questão não é que a IA nunca erre. É que os erros são detetados antes de se tornarem compromissos perante o cliente, enquanto a sua equipa poupa tempo na leitura e nos primeiros rascunhos.

Como Prevenir Alucinações da IA Antes de Chegarem aos Clientes

No suporte, um detalhe inventado pode transformar-se numa promessa pela qual o cliente o responsabilizará. O objetivo é simples: impedir que respostas pouco fiáveis cheguem aos clientes, especialmente quando o pedido envolve reembolsos, compromissos de entrega ou exceções às políticas.

1. Política de resposta (obrigatória)

Comece com um pequeno conjunto de regras que o assistente segue sempre:

- O que lhe é permitido fazer (redigir rascunhos, resumir, fazer perguntas de clarificação, citar fontes aprovadas)

- O que nunca deve fazer (inventar passos, adivinhar políticas, prometer resultados que não consegue verificar)

- Quando deve escalar (dinheiro, compromissos legais, exceções, baixa confiança)

2. Salvaguardas que realmente funcionam

As salvaguardas só ajudam quando correspondem ao fluxo de trabalho real. É aqui que a IA no apoio ao cliente se torna fiável:

- Fundamentação em fontes aprovadas (base de conhecimento, páginas de política, dados de encomenda, rastreamento)

- Limiares de confiança (abaixo do limiar, sem resposta automática)

- Sinalizadores de risco que impõem controlo (dinheiro, promessas de entrega, linguagem jurídica)

3. Checklist simples de controlo de alucinações

Antes de expandir a automação para uma nova intenção, verifique os gatilhos de desvio mais comuns:

- Lacunas na base de conhecimento (sem fontes fiáveis para fundamentação)

- Políticas contraditórias (regras que se contradizem ou "exceções" que não estão documentadas)

- Casos excecionais (envios parciais, encomendas em espera, pacotes, exceções pontuais)

Se tratar as alucinações como um problema de fluxo de trabalho em vez de um problema do modelo, vai resolvê-las mais depressa e com muito menos erros visíveis para o cliente.

Como a IA Transfere Contexto para Humanos

Mais cedo ou mais tarde, um caso precisa de uma pessoa. Uma transição bem feita parece a continuação da mesma conversa, não um recomeço.

A confiança quebra-se quando os clientes se repetem, os detalhes se perdem entre sistemas ou o agente seguinte contradiz o que o assistente disse antes. A partir do momento em que o cliente acha que o assistente prometeu algo, já não está a resolver um ticket — está a reparar credibilidade.

Para evitar isso, cada transição deve incluir um pacote de contexto pequeno e consistente. É isto que transforma a IA conversacional numa verdadeira melhoria do fluxo de trabalho em vez de mais uma camada intermédia:

- Intenção + confiança (o que o cliente pretende fazer e qual o grau de certeza do sistema)

- Campos extraídos (número de encomenda, e-mail, produto, datas, estado do envio, motivo)

- Resumo da IA (recapitulação num parágrafo do que aconteceu até ao momento)

- Fontes utilizadas (que políticas ou páginas da KB foram consultadas)

- Sinalizadores de risco (dinheiro, compromissos de entrega, questões legais, exceção à política)

Para preservar a confiança, a própria mensagem de transição é importante. Ao escalar, sinalize continuidade e evite linguagem que soe a recomeço. Uma frase simples como esta costuma funcionar bem: "O nosso especialista já tem os detalhes e vai dar seguimento a partir daqui." Se precisar que o cliente forneça algo, seja específico sobre o que falta e porquê, para que pareça progresso e não atrito.

Automação do apoio ao cliente: Métricas a Acompanhar

É fácil entusiasmar-se com o número de tickets tratados e perder de vista o que realmente importa: o cliente obteve o resultado correto, com o nível de confiança adequado?

Estas métricas mostram se está a melhorar a qualidade e a confiança, e não apenas a tirar conversas da fila:

- CSAT após interações com IA: Monitorize a satisfação especificamente para conversas assistidas por IA, não apenas o CSAT global.

- Motivos de escalamento: Etiquete o motivo pelo qual um caso foi transferido (dados em falta, exceção à política, baixa confiança, pedido relacionado com dinheiro) para saber o que corrigir a seguir.

- Decisões de IA bloqueadas: Registe quando as salvaguardas impedem uma resposta ou ação insegura e reveja os principais gatilhos para refinar regras e fontes.

- Tempo de resolução após transição: Avalie se o pacote de contexto ajuda os agentes a concluir mais rapidamente sem que os clientes tenham de se repetir.

- Tempo poupado pelo agente: Estime o tempo reduzido na leitura de conversas longas, pesquisa de políticas e redação de primeiras respostas.

As métricas de vaidade podem ajudar, mas apenas quando acompanhadas de indicadores de qualidade:

- Desvio sem CSAT: Menos tickets não significa nada se os clientes ficam frustrados ou inseguros.

- Rapidez sem correção: Respostas rápidas que geram follow-ups, reembolsos ou conflitos com políticas são progresso negativo.

Se estes indicadores evoluírem na direção certa em conjunto, está a construir um sistema que se mantém preciso sob pressão e que escala com segurança quando deve.

Roteiro de IA no suporte: Um Plano de Implementação Realista em 30 Dias

Não precisa de um sistema perfeito no primeiro dia. Precisa de uma sequência segura que comece com controlo, prove fiabilidade e só depois expanda a autonomia.

Semana 1: Políticas + base da KB

- Foco: Política de resposta, intenções de alto risco, fontes aprovadas e atualizadas.

- Critério de avanço: Política aprovada e lista de fontes finalizada.

Semana 2: Apenas análise da IA (sem respostas automáticas)

- Foco: Intenção + campos extraídos + rascunho com fundamentação, confiança e sinalizadores de risco. Os humanos enviam todas as respostas. Registe as falhas.

- Critério de avanço: Uma percentagem-alvo de rascunhos é utilizável com pequenas edições (frequentemente ~60–70% como meta inicial).

Semana 3: Intenções seguras + transição controlada

- Foco: Respostas automáticas apenas para intenções de baixo risco. Risco médio/alto encaminhado para humanos com pacote de contexto. Intenções críticas bloqueadas com fluxo alternativo.

- Critério de avanço: O CSAT mantém-se estável nas respostas automáticas de baixo risco e os motivos de escalamento estão claros.

Semana 4: Copilot + otimização do encaminhamento

- Foco: Copilot no espaço de trabalho do agente, encaminhamento afinado com base nos registos, intenções seguras expandidas uma categoria de cada vez.

- Critério de avanço: As métricas mantêm-se estáveis (CSAT constante, tempo de resolução melhora, decisões bloqueadas em tendência decrescente, agentes reportam poupança de tempo).

Se não cumprir um critério de avanço, não avance. Corrija a política, as fontes ou o encaminhamento primeiro e só depois expanda novamente.

Conclusão

Neste ponto, o padrão é claro. A maioria dos assistentes integrados falha não porque não consiga redigir uma resposta razoável, mas porque o fluxo de trabalho lhes permite comprometer-se com resultados sem controlo suficiente. Com uma estratégia de IA no apoio ao cliente, mantém o assistente focado na investigação e nos rascunhos, verificando tudo o que envolve risco antes de chegar ao cliente.

Para dar um próximo passo concreto, escolha algumas intenções de baixo risco, escreva uma política de resposta de uma página e comece já a medir o CSAT e os motivos de escalada. A partir daí, aumente a autonomia apenas quando as regras, as fontes e as transições se mantiverem fiáveis com volume real.

Perguntas frequentes

Quais são as melhores ferramentas de IA para apoio ao cliente em 2026?

Não existe uma ferramenta "melhor" para todas as equipas, por isso convém comparar as capacidades que mantêm a automação segura. Dê prioridade aos fundamentos do fluxo de trabalho: fundamentação em fontes aprovadas, sinais de confiança ou risco, e transições limpas que preservem o contexto. Extras como controlo de tom ou suporte multilingue só importam depois destes básicos estarem sólidos.

Chatbot de IA para apoio ao cliente vs assistente integrado: qual é a diferença?

Um assistente integrado funciona dentro do fluxo de trabalho (rascunhos, resumos, encaminhamento). Um bot virado para o cliente fala diretamente com os compradores, pelo que precisa de limites mais rígidos e escalamento previsível para tudo o que envolva encomendas ou risco.

Que métricas acompanhar na IA para apoio ao cliente?

Comece pelos indicadores de qualidade, não pelo volume: CSAT após interações assistidas, motivos de escalamento e decisões de risco bloqueadas. Depois observe se as transições se tornam mais rápidas e se os agentes gastam menos tempo a pesquisar e a redigir.

Quais são as melhores práticas de IA no apoio ao cliente para prevenir alucinações?

Comece pela análise e redação de rascunhos, não pelas respostas automáticas. Defina zonas proibidas (dinheiro, questões legais, exceções), exija verificação para tudo o que envolva risco e expanda o âmbito apenas quando os resultados se mantiverem estáveis nas intenções de baixo risco.

Saiba como automatizar o suporte com fluxos, encaminhamento, segmentos e lógica de SLA em situações de rastreio de encomendas, devoluções, cancelamentos e reclamações por danos.

Guia prático para escolher um chat gratuito: o que importa nos planos free, como configurar e quando fazer upgrade.

Um guia prático sobre apoio ao cliente gratuito no Shopify: modelos de preços, resumo de funcionalidades, limites de escalabilidade e o que usar quando o Inbox já não chega.

Comece grátis e reúna todas as suas lojas, tickets e chats num helpdesk que controla.