AIカスタマーサポート戦略:自動化すべき領域と人が担うべき領域

AIカスタマーサポート戦略とは、AIが対応できる範囲、エスカレーションが必要な場面、そしてサポートチームが正確でポリシーに沿った安全な対応を大規模に維持する方法を決定するフレームワークです。

ほとんどのチームが失敗するのは、AIの性能が足りないからではありません。組み込み型アシスタントを判断の代替として扱ったときに問題が起きるのです。カスタマーサポートにおいて、自信を持った誤回答は高くつきます。返金の発生、ポリシー違反、そして静かに信頼を損なう原因になり得ます。だからこそ、新しいAI機能を追加するよりも、AIカスタマーサポート戦略の方がはるかに重要なのです。

本当に重要なのは、誰がどのルールに基づいて判断を下すかです。本ガイドでは、自動化が低リスクな領域、レビューが必要な領域、そしてThink → Verify → Actのフレームワーク、ハルシネーション防止のガードレール、顧客が同じ説明を繰り返さずに済むコンテキスト保持型の引き継ぎによって、一貫した成果を維持する方法を解説します。

2026年における「AIカスタマーサポート戦略」の本当の意味

「戦略」という言葉が、単にAIを有効化することの代名詞になりがちです。よくある誤解の一つは、ヘルプデスクにアシスタントを接続し、ナレッジベースを参照させれば完了というもの。もう一つは正反対で、アシスタントが回答できるなら全てに回答させるべきというものです。どちらのアプローチも、判断力や例外対応、ポリシーの微妙なニュアンスが求められる実際の顧客からの問い合わせで破綻します。

優れたAI顧客体験戦略はもっと具体的です。アシスタントが関与する場面と、判断を委ねてはいけない場面を明確にします。また、ポリシーや製品、エッジケースが変化しても回答の品質を維持するためのルールも設定します。

これらの基本をシンプルな言葉で説明できないなら、まだ戦略があるとは言えません。機能を有効にして、あとはうまくいくことを祈っているだけです。

AIチャットボット、AIアシスタント、AIエージェント、Copilot:役割を正しく理解する

これらの呼び名は混同されやすく、それがツールに必要以上の自律性を与えてしまう原因になります。用語を整理するため、以下の表では各役割を許容される自律性のレベルと、よくある失敗パターンで比較しています。

| 役割 | 許容される自律性 | よくある失敗 |

|---|---|---|

| チャットボット(スクリプト/FAQ) | 事前に作成・承認した回答のみを返します。 | スクリプト外での行き詰まり、ストレスの溜まるループ。 |

| AIアシスタント(組み込み型AI) | ShopifyやMagentoにAI機能として組み込まれ、要約・下書き・分類・次のアクションの提案を行います。 | ストア固有のニュアンスを見落とす、エッジケースを無視した下書き、ガイダンスがないと一貫性のないトーン。 |

| AIチャットボット(生成型回答) | 提供されたソースと会話のコンテキストに基づいて回答を生成します。 | ハルシネーション、過度な約束、古いポリシーの参照。 |

| AIエージェント(アクション+ワークフロー) | ルールと承認に基づいて複数のシステムにまたがるアクションを実行します。 | 大規模な誤操作、コンプライアンス違反、ガードレールなしの高コストなミス。 |

| Copilot(エージェント向け) | 人間のエージェントに下書きと提案で支援し、最終的な送信・実行は人が判断します。 | 過度な信頼、コピー&ペーストのミス、コンテキストが不十分だと効果が薄い。 |

自律性のレベルが間違っていると、ミスはサポートキューよりも速く拡大します。リスクは呼び名にあるのではなく、責任の所在が不明確なことにあるのです。

カスタマーサポートの自動化:AIが役立つ領域と判断を委ねるべきでない領域

すべてのサポート業務が同じように自動化できるわけではありません。最も安全な成果は、アシスタントが金銭の約束、ポリシーの逸脱、取り消せないアクションを誤って実行できないワークフローから生まれます。

シンプルなルールが効果的です。繰り返し発生し検証可能な業務は自動化し、判断・例外・実際のコミットメントが必要な場合は人を介在させましょう。

高価値・低リスクの自動化

スピードが重要で、回答を承認済みソースに基づいて行えるタスクです。

- FAQと基本的なポリシーに関する質問(ポリシーテキストが最新の場合)

- データ収集(注文番号、メール、写真、理由)

- チケット分類とルーティング(インテントタグ付け・優先度設定)

- 要約と下書き作成(チケット要約・返信案のレビュー)

高リスクの自動化(コントロールが必要)

一見シンプルに見えるリクエストでも、細部の見落とし一つで正しい結果が変わることがあります。

- 返品(対象条件のエッジケース、期限)

- キャンセル(フルフィルメント段階、不正チェック)

- 配送約束(入荷待ち、倉庫の制約)

- 補償(クレジット、交換、送料返金)

完全自動化してはいけない領域

結果が金銭、法的リスク、またはポリシー例外に影響する場合、システムはデフォルトで制御された引き継ぎを行うべきです。

- 金銭(返金、クレジット、割引)

- 法的コミットメント(保証、保証書、コンプライアンス関連の声明)

- ポリシー例外(手動オーバーライド)

リスクマトリクス

インテントごとにAIが実行できる操作をシンプルなマトリクスで定義しましょう。これにより、担当者・シフト・繁忙期を問わず、自動化されたカスタマーサポートの一貫性が保たれます。基本的な流れは、リスクの低いインテントは自動返信、判断が必要なものは担当者に引き渡し、重要なケースはブロックまたはエスカレーションです。

| 意図 / タスク | リスクレベル | 許可される自動化 | 必要なソース / ポリシー |

|---|---|---|---|

| 注文はどこですか? | 低 | 自動返信可 | 配送ポリシー+追跡ソース |

| 配送先住所の変更 | 中 | 引き継ぎ | 注文編集ルール+本人確認手順 |

| 注文のキャンセル | 高 | 引き継ぎ / 不明な場合はブロック | キャンセルポリシー+決済状況 |

| 返金リクエスト | 高 | 引き継ぎのみ | 返金ポリシー+対象条件+注文情報 |

| 割引リクエスト | 高 | ブロック+代替フロー | 割引ポリシー+エスカレーションルール |

| 保証 / 法的請求 | 重大 | ブロック+即時引き継ぎ | 法務ポリシー+人による承認 |

まだマッピングされていない意図は、デフォルトで引き継ぎとし、ポリシーとソースが明確になってから追加しましょう。

AI vs 人間のカスタマーサービス:AIが下書き、人が最終判断

アシスタントがサポートワークフローに組み込まれると、より速いエージェントとして扱いたくなります。しかし、スピードと責任は別物です。生成された回答は洗練されて聞こえても、最も重要な部分、つまりビジネスとして次に何をコミットするかという点で間違っている可能性があります。

より安全なモデルはシンプルです。AIに重い作業を任せつつ、判断には責任を持たせること。生成AIカスタマーサポートは分析と下書きに活用し、独立したコミットメントには使わないようにしましょう。

アシスタントはスレッドを読み、関連する詳細を取得し、承認済みソースを確認し、根拠付きの回答案を提示できます。その後、人間が送信内容を承認するか、金銭・ポリシー例外・法的に機微な内容に関わる場合はケースを適切にルーティングします。下書きと編集者の関係と考えてください。対応スピードは上がりますが、ガードレール付きで進められます。

覚えておくべき原則:AIが回答を下書きし、チームが判断を承認する。

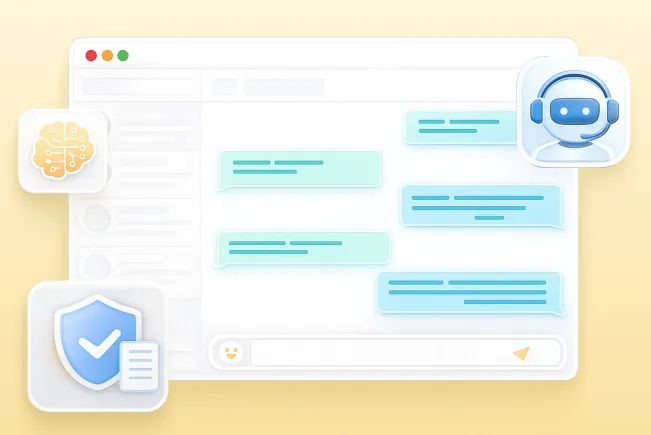

AIカスタマーサポートのアーキテクチャ:Think → Verify → Act

必要なのは、自律的にメッセージを送信できるアシスタントではありません。分析と承認を分離し、実行をコントロール下に置くワークフローです。実際の運用では、これはルーティンワークの処理速度を上げながら、エッジケースを顧客への約束に変えてしまうことを防ぐAIカスタマーサービスの実装方法です。

Think:AI分析レイヤー

Thinkはバックグラウンドで実行されます。アシスタントはメッセージとチケット履歴を読み、意図を特定し、承認済みソースから関連情報を取得し、根拠・信頼度・リスクフラグ付きの返信案を作成します。これは準備段階であり約束ではないため、顧客に直接対応するレイヤーであってはなりません。

Verify:ポリシー&コントロールレイヤー

Verifyはチェックポイントです。下書きをビジネスルールと参照ソースに照らし合わせて検証します。その後、ワークフローが以下のいずれかの結果を選択します:

- 安全な自動返信(確実なソースに基づく低リスクの意図)

- 人間への引き継ぎ(判断、例外、コンテキスト不足)

- ブロック+代替フロー(金銭、法的問題、不明確なリクエスト)

Act:実行

Actは制御された出力です。安全なケースにはポリシーに沿った回答が返されます。人の対応が必要なものは、主要なコンテキストがパッケージ化された状態でルーティングされるため、エージェントはスレッド全体を読み返すことなく対応を継続できます。ブロックされたケースは、不足情報の収集や専門担当者へのエスカレーションなどのフォールバックパスに従います。

実際のチームでの運用イメージ

日々の運用では、アシスタントが全履歴を確認し、ドキュメントを参照して、簡潔な要約と返信案を作成します。人間がそれをレビューし、ニュアンスを調整して最終的な回答を送信します。下書きが的外れな場合は、エージェントがより精度の高い修正を指示し、正確で使えるものになるまで繰り返します。

ポイントはAIがミスをしないということではありません。ミスが顧客へのコミットメントになる前に発見できること、そしてチームが情報の確認と初稿作成の時間を節約できることです。

AIのハルシネーションが顧客に届く前に防ぐ方法

サポートの現場では、でっち上げられた情報が顧客にとっての「約束」になりかねません。目標はシンプルです。信頼性の低い回答が顧客に届かないようにすること。特に返金、配送の約束、ポリシー例外に関わるリクエストでは重要です。

1. レスポンスポリシー(必須)

アシスタントが毎回従う短いルールブックから始めましょう:

- 許可される行動(下書き、要約、確認質問、承認済みソースの引用)

- 決してしてはならない行動(手順の捏造、ポリシーの推測、検証できない結果の約束)

- エスカレーションが必要なとき(金銭、法的コミットメント、例外、低い信頼度)

2. 実際に機能するガードレール

ガードレールは実際のワークフローと一致して初めて効果を発揮します。ここが、カスタマーサービスにおけるAIが信頼できるものになるポイントです:

- 承認済みソースに基づく回答生成(ナレッジベース、ポリシーページ、注文データ、追跡情報)

- 信頼度の閾値(閾値以下の場合、自動返信なし)

- コントロールを強制するリスクフラグ(金銭、配送の約束、法的表現)

3. ハルシネーション防止のQAチェックリスト

新しい意図に自動化を拡大する前に、最もよくある逸脱のトリガーを確認しましょう:

- ナレッジベースの空白(信頼できる根拠がない)

- 矛盾するポリシー(食い違うルールやドキュメント化されていない「例外」)

- エッジケース(分割出荷、入荷待ち、バンドル、一回限りの例外)

ハルシネーションをモデルの問題ではなくワークフローの問題として捉えれば、より速く、顧客に影響するミスを大幅に減らして解決できます。

AIから人間へのコンテキスト引き継ぎ方法

遅かれ早かれ、人の対応が必要なケースが出てきます。スムーズな引き継ぎとは、会話がそのまま続いているように感じられること、最初からやり直しではないということです。

信頼が崩れるのは、顧客が同じことを繰り返し説明させられたとき、システム間で情報が失われたとき、または次の担当者がアシスタントの以前の発言と矛盾したときです。顧客がアシスタントに何かを約束されたと感じた瞬間、もはやチケットの解決ではなく、信頼の回復作業になります。

そうならないために、すべての引き継ぎに小さく一貫したコンテキストパケットを含めるべきです。これが、会話型AIを余分な中間レイヤーではなく、真のワークフロー改善に変えるポイントです:

- 意図+信頼度(顧客がやろうとしていること、システムの確信度)

- 抽出フィールド(注文番号、メール、製品、日付、配送状況、理由)

- AI要約(これまでの経緯を1段落でまとめたもの)

- 参照ソース(どのポリシーやKBページが参照されたか)

- リスクフラグ(金銭、配送の約束、法的問題、ポリシー例外)

信頼を維持するには、引き継ぎメッセージ自体が重要です。エスカレーションの際は、継続性を示し、最初からやり直すような表現は避けましょう。「担当スペシャリストがすでに詳細を把握しており、ここから対応を引き継ぎます」のようなシンプルな一文が効果的です。顧客に何か提供してもらう必要がある場合は、何が不足していてなぜ必要なのかを具体的に伝え、進捗を感じてもらえるようにしましょう。

カスタマーサービス自動化:追跡すべき指標

処理したチケット数に目を奪われがちですが、本当に重要なのは、顧客が適切な確信度で正しい結果を得られたかどうかです。

これらの指標は、単にキューから会話を消化しているだけでなく、品質と信頼を向上させているかどうかを示します:

- AI対応後のCSAT:全体のCSATだけでなく、AI支援スレッドに特化した満足度を追跡しましょう。

- エスカレーション理由:引き継ぎの理由(データ不足、ポリシー例外、低い信頼度、金銭関連のリクエスト)をタグ付けし、次に何を改善すべきかを把握しましょう。

- ブロックされたAI判断:ガードレールが安全でない返信やアクションを停止したタイミングを追跡し、主なトリガーをレビューしてルールとソースを改善しましょう。

- 引き継ぎ後の解決時間:コンテキストパケットによってエージェントの対応が速くなり、顧客に同じ説明を繰り返させていないかを計測しましょう。

- エージェントの時間削減:長いスレッドの確認、ポリシーの検索、初回返信の作成にかかる時間がどれだけ削減されたかを推定しましょう。

見栄えの良い指標も参考にはなりますが、品質指標と組み合わせてこそ意味があります:

- CSATなしのデフレクション:顧客が不満や不安を抱えたまま離れているなら、チケット数の減少に意味はありません。

- 正確性なしのスピード:フォローアップ、返金、ポリシー違反を引き起こす速い回答は、マイナスの進捗です。

これらの指標が同時に正しい方向に動いていれば、負荷がかかっても正確性を維持し、必要なときに安全にエスカレーションできるシステムを構築できています。

AIサポートロードマップ:現実的な30日間の導入計画

初日から完璧なシステムは必要ありません。コントロールから始め、信頼性を実証し、その後に自律性を拡大する安全な手順が必要です。

第1週:ポリシー+KBの基盤構築

- 重点:レスポンスポリシー、高リスクの意図、精査された承認済みソース。

- ゲート:ポリシーの承認とソースリストの確定。

第2週:AI分析のみ(自動返信なし)

- 重点:意図+抽出フィールド+根拠・信頼度・リスクフラグ付きの下書き。返信はすべて人間が送信。失敗をログに記録。

- ゲート:下書きの目標割合が軽微な修正で使用可能(初期目標として約60〜70%が一般的)。

第3週:安全な意図+制御された引き継ぎ

- 重点:低リスクの意図にのみ自動返信。中・高リスクはコンテキストパケット付きで人間にルーティング。重大な意図は代替フローでブロック。

- ゲート:低リスクの自動返信でCSATが安定し、エスカレーション理由が明確。

第4週:Copilot+ルーティングの最適化

- 重点:エージェントワークスペース内のCopilot、ログに基づくルーティングの調整、安全な意図をカテゴリごとに段階的に拡大。

- ゲート:指標が安定を維持(CSATが安定、解決時間が改善、ブロックされた判断が減少傾向、エージェントが時間短縮を報告)。

ゲートを通過できなかった場合、無理に先に進まないでください。まずポリシー、ソース、またはルーティングを修正してから、再度拡大しましょう。

まとめ

ここまで読めば、パターンは明確です。ほとんどの組み込み型アシスタントが失敗するのは、適切な回答が書けないからではなく、ワークフローが十分なコントロールなしに結果へのコミットを許してしまうからです。AIカスタマーサポート戦略があれば、アシスタントをリサーチと下書きに集中させ、リスクを伴うものは顧客に届く前に検証できます。

具体的な次のアクションとして、リスクの低いインテントをいくつか選んで1ページの対応ポリシーを策定し、CSATとエスカレーション理由の計測をすぐに始めることをお勧めします。そこから、ルール・情報源・引き渡しの精度が実際のトラフィック量でも安定していると確認できた段階で、自動化の範囲を段階的に広げていきましょう。

よくある質問

2026年のカスタマーサポートに最適なAIツールは?

すべてのチームに共通する「最高の」ツールは存在しないため、自動化の安全性を保つ機能を比較することが重要です。ワークフローの基本を優先しましょう:承認済みソースに基づく回答生成、信頼度やリスクのシグナル、コンテキストを保持するスムーズな引き継ぎ。トーンの調整や多言語対応などは、これらの基本が確立された後に検討すべき項目です。

カスタマーサービス向けAIチャットボットと組み込み型アシスタントの違いは?

組み込み型アシスタントはワークフロー内で動作します(下書き、要約、ルーティング)。顧客対応ボットは購入者と直接会話するため、注文固有の内容やリスクのある対応については、より厳格な制限と予測可能なエスカレーションが必要です。

カスタマーサービスAIで追跡すべき指標は?

ボリュームではなく品質指標から始めましょう:AI支援後のCSAT、エスカレーション理由、ブロックされたリスクのある判断。その後、引き継ぎが速くなっているか、エージェントの検索・下書き時間が減っているかを確認します。

AIカスタマーサービスにおけるハルシネーション防止のベストプラクティスは?

自動返信ではなく、分析と下書きから始めましょう。禁止ゾーン(金銭、法的問題、例外)を定義し、リスクのあるものには検証を必須とし、低リスクの意図で結果が安定している場合にのみ範囲を拡大してください。

フロー設計・ルーティング・セグメント・SLAロジックを活用して、WISMO・返品・キャンセル・破損クレームのサポートを自動化する方法を解説します。

Shopifyで無料カスタマーサポートを始めるための実践ガイド。料金モデル、機能比較、拡張性の限界、そしてInboxでは足りなくなったときの選択肢を解説します。