Estrategia de atención al cliente con IA: qué automatizar y qué dejar en manos humanas

Una estrategia de atención al cliente con IA es un marco para decidir dónde puede asistir la IA, dónde debe escalar y cómo los equipos de soporte mantienen las respuestas precisas, alineadas con las políticas y seguras a escala.

La mayoría de los equipos no fallan porque su IA no sea lo suficientemente inteligente. Los problemas surgen cuando un asistente integrado se trata como un sustituto seguro del criterio humano. En atención al cliente, una respuesta errónea dada con seguridad sale cara. Puede provocar reembolsos, violar políticas y dañar la confianza sin que nadie se dé cuenta. Por eso una estrategia de IA para atención al cliente importa más que activar otra función de IA.

La verdadera pregunta es quién toma la decisión y bajo qué reglas. Esta guía muestra dónde la automatización es de bajo riesgo, dónde necesita revisión y cómo mantener resultados consistentes con Pensar → Verificar → Actuar, mecanismos de protección contra alucinaciones y transferencias que conservan el contexto para que los clientes no tengan que repetirse.

Qué significa realmente “estrategia de atención al cliente con IA” en 2026

Estrategia a menudo se convierte en sinónimo de simplemente activarlo. Un error común es pensar que puedes conectar un asistente a tu helpdesk, apuntarlo a una base de conocimiento y darlo por hecho. El otro extremo: si el asistente puede responder, debería responder a todo. Ambos enfoques suelen fallar con el mismo tipo de solicitudes: preguntas reales de clientes que requieren criterio, excepciones o matices en las políticas.

Una estrategia sólida de experiencia del cliente con IA es mucho más específica. Aclara dónde participa el asistente y dónde no tiene permitido decidir. También establece reglas de calidad para que las respuestas sigan siendo fundamentadas a medida que cambian las políticas, los productos y los casos límite.

Si no puedes explicar estos conceptos básicos en un lenguaje sencillo, aún no tienes una estrategia. Tienes una función activada y esperas que haga el resto.

Chatbots de IA, asistentes de IA, agentes de IA, copilots: roles sin confusión

Estas etiquetas se confunden fácilmente, y así es como los equipos dan a una herramienta más autonomía de la que debería tener. Para mantener los términos claros, la siguiente tabla compara cada rol por autonomía permitida y los fallos más frecuentes.

| Rol | Autonomía permitida | Fallos típicos |

|---|---|---|

| Chatbot (scripts/FAQ) | Responde solo lo que escribes y apruebas previamente. | Callejones sin salida fuera del script; bucles frustrantes. |

| Asistente de IA (IA integrada) | Integrado en Shopify o Magento como función de IA. Resume, redacta borradores, clasifica y sugiere próximos pasos. | Pasa por alto matices específicos de la tienda; borradores que ignoran casos límite; tono inconsistente sin orientación. |

| Chatbot de IA (respuestas generadas) | Genera respuestas basadas en fuentes proporcionadas y el contexto de la conversación. | Alucinaciones; promesas excesivas; referencias a políticas desactualizadas. |

| Agente de IA (acciones + workflow) | Ejecuta acciones en varios sistemas según reglas y aprobaciones. | Acciones incorrectas a escala; problemas de cumplimiento; errores costosos sin mecanismos de protección. |

| Copilot (para agentes) | Asiste a un agente humano con borradores y sugerencias; una persona decide qué se envía o se hace. | Confianza excesiva; errores de copiar y pegar; beneficios débiles si el contexto es deficiente. |

Cuando el nivel de autonomía es incorrecto, los errores escalan más rápido que la cola de soporte. El riesgo no está en la etiqueta. Está en la responsabilidad poco clara.

Automatización de la atención al cliente: dónde ayuda la IA y dónde no debería decidir

No todas las tareas de soporte se pueden automatizar de la misma forma. Las victorias más seguras vienen de flujos de trabajo donde el asistente no puede accidentalmente prometer dinero, eludir políticas o desencadenar una acción irreversible.

Una regla sencilla funciona bien: automatiza lo repetitivo y verificable, y mantén a un humano en el proceso cuando la solicitud implique criterio, excepciones o un compromiso real.

Automatización de alto valor y bajo riesgo

Son tareas donde la velocidad importa y la respuesta puede fundamentarse en fuentes aprobadas.

- Preguntas frecuentes y consultas básicas sobre políticas (cuando el texto de la política está actualizado)

- Recopilación de datos (número de pedido, correo electrónico, fotos, motivo)

- Clasificación y enrutamiento (etiquetado de intención, prioridad)

- Resúmenes y borradores (resumen del ticket, respuesta borrador para revisión)

Automatización de alto riesgo (requiere control)

Estas solicitudes parecen simples, pero un detalle faltante puede cambiar el resultado correcto.

- Devoluciones (casos límite de elegibilidad, plazos)

- Cancelaciones (etapa de cumplimiento, verificación de fraude)

- Promesas de entrega (pedidos pendientes, restricciones de almacén)

- Compensaciones (créditos, reemplazos, reembolsos de envío)

Lo que nunca debería ser completamente autónomo

Si el resultado afecta al dinero, la exposición legal o las excepciones de políticas, el sistema debería recurrir por defecto a una transferencia controlada.

- Dinero (reembolsos, créditos, descuentos)

- Compromisos legales (garantías, certificaciones, declaraciones de cumplimiento)

- Excepciones de políticas (anulaciones manuales)

Matriz de riesgos

Usa una matriz sencilla para definir qué puede hacer el asistente según cada tipo de solicitud. Así se mantiene la coherencia del soporte automatizado entre agentes, turnos y temporadas de alta demanda. Interpreta esta matriz como una ruta predeterminada: respuesta automática para intenciones de bajo riesgo, derivación cuando se requiere criterio humano, y bloqueo o escalado para casos críticos.

| Intención / tarea | Nivel de riesgo | Automatización permitida | Fuentes / políticas requeridas |

|---|---|---|---|

| ¿Dónde está mi pedido? | Bajo | Respuesta automática permitida | Política de envío + fuente de rastreo |

| Cambiar dirección de envío | Medio | Transferencia | Reglas de edición de pedidos + pasos de verificación |

| Cancelar mi pedido | Alto | Transferencia / bloqueo en caso de incertidumbre | Política de cancelación + estado del pago |

| Solicitud de reembolso | Alto | Solo transferencia | Política de reembolso + reglas de elegibilidad + datos del pedido |

| Solicitud de descuento | Alto | Bloqueo + flujo alternativo | Política de descuentos + reglas de escalación |

| Garantía / reclamación legal | Crítico | Bloqueo + transferencia inmediata | Política legal + aprobación humana |

Si una intención aún no está mapeada, usa la transferencia como opción predeterminada. Agrégala cuando la política y las fuentes estén claras.

IA vs atención humana: redacta el borrador, aprueba la decisión

Cuando un asistente está integrado en tu flujo de soporte, resulta tentador tratarlo como un agente más rápido. Pero velocidad no es lo mismo que responsabilidad. Una respuesta generada puede sonar pulida y aun así equivocarse en lo que más importa: a qué compromete a tu negocio.

El modelo más seguro es simple: deja que la IA haga el trabajo pesado, pero mantén las decisiones bajo control. Usa la IA generativa en atención al cliente para análisis y borradores, no para compromisos independientes.

El asistente puede leer el hilo, extraer detalles relevantes, consultar fuentes aprobadas y proponer una respuesta con argumentación. Un humano entonces aprueba lo que se envía o redirige el caso cuando involucra dinero, excepciones de políticas o cualquier tema legalmente sensible. Piénsalo como un borrador y un editor. Sigues avanzando más rápido, pero con mecanismos de protección.

Regla práctica para compartir: la IA debería redactar el borrador. Tu equipo debería aprobar la decisión.

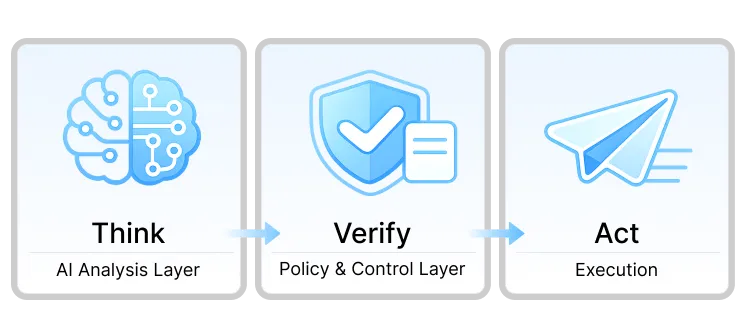

Arquitectura de IA para atención al cliente: Pensar → Verificar → Actuar

No necesitas un asistente que pueda enviar mensajes por su cuenta. Necesitas un flujo de trabajo que separe el análisis de la aprobación y mantenga la ejecución bajo control. En la práctica, es una implementación de IA en atención al cliente que te ayuda a avanzar más rápido en el trabajo rutinario sin convertir los casos límite en promesas de cara al cliente.

Pensar: capa de análisis de IA

La fase Pensar ocurre entre bastidores. El asistente lee el mensaje y el historial del ticket, identifica la intención, extrae detalles relevantes de fuentes aprobadas y redacta un borrador de respuesta con razonamiento, nivel de confianza y señales de riesgo. Es preparación, no una promesa, así que no debería ser la capa que habla con el cliente.

Verificar: capa de políticas y control

Verificar es el punto de control. El borrador se compara con tus reglas de negocio y las fuentes en las que se basa. Luego, el flujo de trabajo elige un resultado:

- Respuesta automática segura (intenciones de bajo riesgo con fuentes sólidas)

- Transferencia a un humano (criterio, excepciones, contexto faltante)

- Bloqueo + flujo alternativo (dinero, legal, solicitudes poco claras)

Actuar: ejecución

Actuar es la salida controlada. Un caso seguro recibe una respuesta alineada con las políticas. Todo lo que necesite una persona se redirige con el contexto clave ya preparado, para que el agente pueda continuar sin releer todo el hilo. Los casos bloqueados siguen una ruta alternativa, como recopilar detalles faltantes o escalar a un especialista.

Cómo se ve esto en un equipo real

En el día a día, el asistente revisa el historial completo, consulta la documentación y produce un breve resumen con un borrador de respuesta. Un humano lo revisa, ajusta los matices y envía la respuesta final. Si el borrador no da en el blanco, el agente pide una versión más ajustada e itera hasta que sea precisa y utilizable.

La cuestión no es que la IA nunca se equivoque. Es que los errores se detectan antes de convertirse en compromisos de cara al cliente, mientras tu equipo ahorra tiempo en lectura y primeros borradores.

Cómo prevenir las alucinaciones de la IA antes de que lleguen a los clientes

En soporte, un detalle inventado puede convertirse en una promesa a la que el cliente te responsabilizará. El objetivo es simple: evitar que las respuestas poco fiables lleguen a los clientes, especialmente cuando una solicitud involucra reembolsos, compromisos de entrega o excepciones de políticas.

1. Política de respuesta (imprescindible)

Empieza con un breve conjunto de reglas que el asistente siga siempre:

- Qué tiene permitido hacer (redactar borradores, resumir, hacer preguntas aclaratorias, citar fuentes aprobadas)

- Qué no debe hacer nunca (inventar pasos, adivinar políticas, prometer resultados que no puede verificar)

- Cuándo debe escalar (dinero, compromisos legales, excepciones, baja confianza)

2. Mecanismos de protección que realmente funcionan

Los mecanismos de protección solo ayudan cuando coinciden con el flujo de trabajo real. Aquí es donde la IA en atención al cliente se vuelve fiable:

- Fundamentación en fuentes aprobadas (base de conocimiento, páginas de políticas, datos de pedidos, rastreo)

- Umbrales de confianza (por debajo del umbral, sin respuesta automática)

- Señales de riesgo que fuerzan el control (dinero, promesas de entrega, lenguaje legal)

3. Checklist sencillo de QA para alucinaciones

Antes de expandir la automatización a una nueva intención, verifica los desencadenantes de desvío más comunes:

- Vacíos en tu base de conocimiento (nada fiable en qué fundamentar)

- Políticas contradictorias (reglas que se contradicen o “excepciones” que no están documentadas)

- Casos límite (envíos parciales, pedidos pendientes, paquetes, excepciones puntuales)

Si tratas las alucinaciones como un problema de flujo de trabajo en lugar de un problema del modelo, las resolverás más rápido y con muchos menos errores de cara al cliente.

Cómo la IA transfiere el contexto a los humanos

Tarde o temprano, un caso necesita una persona. Una transferencia fluida se siente como la continuación de la misma conversación, no como empezar de cero.

La confianza se rompe cuando los clientes tienen que repetirse, los detalles se pierden entre sistemas o el siguiente agente contradice lo que dijo el asistente antes. En el momento en que un cliente cree que el asistente le prometió algo, ya no estás resolviendo un ticket, estás reparando tu credibilidad.

Para evitarlo, cada transferencia debe incluir un pequeño paquete de contexto consistente. Esto es lo que convierte la IA conversacional en una mejora real del flujo de trabajo en lugar de una capa extra en medio:

- Intención + confianza (qué intenta hacer el cliente y cuán seguro está el sistema)

- Campos extraídos (número de pedido, correo electrónico, producto, fechas, estado del envío, motivo)

- Resumen de IA (recapitulación en un párrafo de lo ocurrido hasta ahora)

- Fuentes utilizadas (qué políticas o páginas de la base de conocimiento se consultaron)

- Señales de riesgo (dinero, compromisos de entrega, legal, excepción de política)

Para preservar la confianza, el mensaje de transferencia en sí importa. Cuando escales, señala continuidad y evita un lenguaje que suene a empezar de cero. Una frase simple como esta suele funcionar bien: “Nuestro especialista ya tiene los detalles y continuará desde aquí.” Si necesitas que el cliente proporcione algo, sé específico sobre qué falta y por qué, para que se sienta como progreso, no como fricción.

Automatización del servicio al cliente: métricas a seguir

Es fácil entusiasmarse con la cantidad de tickets gestionados y pasar por alto lo que realmente importa: ¿obtuvo el cliente el resultado correcto, con el nivel adecuado de confianza?

Estas métricas muestran si estás mejorando la calidad y la confianza, y no solo sacando conversaciones de la cola:

- CSAT después de interacciones con IA: Mide la satisfacción específicamente en hilos asistidos por IA, no solo tu CSAT general.

- Motivos de escalación: Etiqueta por qué se transfirió un caso (datos faltantes, excepción de política, baja confianza, solicitud relacionada con dinero) para saber qué corregir a continuación.

- Decisiones de IA bloqueadas: Registra cuándo los mecanismos de protección detienen una respuesta o acción insegura, y luego revisa los principales desencadenantes para refinar reglas y fuentes.

- Tiempo de resolución tras la transferencia: Mide si el paquete de contexto ayuda a los agentes a terminar más rápido sin que los clientes tengan que repetirse.

- Tiempo ahorrado del agente: Estima el tiempo reducido en leer hilos largos, buscar políticas y redactar primeras respuestas.

Las métricas de vanidad aún pueden ayudar, pero solo junto con señales de calidad:

- Deflexión sin CSAT: Menos tickets no significa nada si los clientes se van frustrados o inseguros.

- Velocidad sin exactitud: Respuestas rápidas que generan seguimientos, reembolsos o conflictos de políticas son progreso negativo.

Si estas métricas avanzan juntas en la dirección correcta, estás construyendo un sistema que se mantiene preciso bajo presión y escala de forma segura cuando corresponde.

Hoja de ruta de IA para soporte: un plan de implementación realista de 30 días

No necesitas un sistema perfecto el primer día. Necesitas una secuencia segura que comience con control, demuestre fiabilidad y solo entonces amplíe la autonomía.

Semana 1: Políticas + base de conocimiento

- Enfoque: Política de respuesta, intenciones de alto riesgo, fuentes aprobadas limpias.

- Puerta: Política aprobada y lista de fuentes finalizada.

Semana 2: Solo análisis de IA (sin respuestas automáticas)

- Enfoque: Intención + campos extraídos + borrador con razonamiento, confianza y señales de riesgo. Los humanos envían todas las respuestas. Registrar fallos.

- Puerta: Un porcentaje objetivo de borradores es utilizable con ediciones menores (frecuentemente ~60–70 % como meta inicial).

Semana 3: Intenciones seguras + transferencia controlada

- Enfoque: Respuestas automáticas solo para intenciones de bajo riesgo. Riesgo medio/alto se redirige a humanos con un paquete de contexto. Las intenciones críticas se bloquean con un flujo alternativo.

- Puerta: El CSAT se mantiene estable en respuestas automáticas de bajo riesgo, y los motivos de escalación son claros.

Semana 4: Copilot + optimización del enrutamiento

- Enfoque: Copilot en el espacio de trabajo del agente, enrutamiento ajustado desde los logs, intenciones seguras expandidas una categoría a la vez.

- Puerta: Las métricas se mantienen estables (CSAT constante, el tiempo de resolución mejora, las decisiones bloqueadas tienden a la baja, los agentes reportan ahorro de tiempo).

Si no superas una puerta, no avances. Corrige primero la política, las fuentes o el enrutamiento, y luego amplía de nuevo.

Conclusión

A estas alturas, el patrón es claro. La mayoría de los asistentes integrados no fallan porque no puedan escribir una respuesta decente, sino porque el flujo de trabajo les permite comprometerse con resultados sin suficiente control. Con una estrategia de IA para atención al cliente, mantienes al asistente enfocado en investigación y borradores, y verificas todo lo que conlleve riesgo antes de que llegue al cliente.

Si buscas un primer paso concreto, elige algunas intenciones de bajo riesgo, redacta una política de respuesta de una página y empieza a medir el CSAT y los motivos de escalado de inmediato. A partir de ahí, amplía la autonomía del sistema solo cuando las reglas, las fuentes y las transferencias se mantengan fiables bajo volumen real.

Preguntas frecuentes

¿Cuáles son las mejores herramientas de IA para atención al cliente en 2026?

No existe una herramienta “mejor” para todos los equipos, así que conviene comparar las capacidades que mantienen la automatización segura. Prioriza los fundamentos del flujo de trabajo: fundamentación en fuentes aprobadas, señales de confianza o riesgo, y transferencias limpias que preserven el contexto. Extras como controles de tono o soporte multilingüe importan solo después de que estos fundamentos sean sólidos.

Chatbot de IA para atención al cliente vs asistente integrado: ¿cuál es la diferencia?

Un asistente integrado trabaja dentro del flujo de trabajo (borradores, resúmenes, enrutamiento). Un bot de cara al cliente habla directamente con los compradores, por lo que necesita límites más estrictos y una escalación predecible para cualquier cosa específica del pedido o de riesgo.

¿Qué métricas seguir para la IA en atención al cliente?

Empieza con señales de calidad, no de volumen: CSAT después de interacciones asistidas, motivos de escalación y decisiones riesgosas bloqueadas. Luego observa si las transferencias son más rápidas y los agentes dedican menos tiempo a buscar y redactar borradores.

¿Cuáles son las mejores prácticas de IA en atención al cliente para prevenir alucinaciones?

Empieza con análisis y borradores, no con respuestas automáticas. Define zonas prohibidas (dinero, legal, excepciones), exige verificación para todo lo riesgoso y amplía el alcance solo cuando los resultados se mantengan estables en intenciones de bajo riesgo.

Aprende a automatizar el soporte con flujos, enrutamiento, segmentos y lógica de SLA para gestionar consultas de seguimiento, devoluciones, cancelaciones y reclamaciones por daños.

Guía práctica para elegir un chat gratuito: qué importa en los planes free, cómo configurarlo y cuándo conviene pasarse a un plan de pago.

Guía práctica de soporte al cliente gratuito en Shopify: modelos de precios, resumen de funcionalidades, límites de escalabilidad y qué usar cuando Inbox ya no es suficiente.

Comience gratis y ponga todas sus tiendas, tickets y chats bajo un helpdesk que usted controla.