AI-strategi for kundestøtte: Hva du bør automatisere og hva som bør forbli menneskelig

En AI-strategi for kundestøtte er et rammeverk for å avgjøre hvor AI kan hjelpe, hvor den må eskalere, og hvordan støtteteam holder svarene nøyaktige, i tråd med retningslinjene og trygge i stor skala.

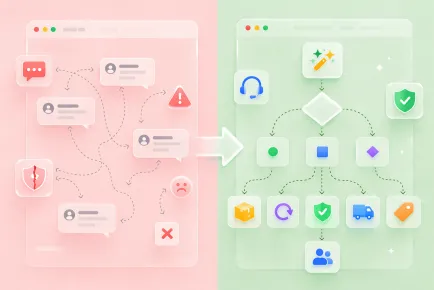

De fleste team feiler ikke fordi AI-en deres ikke er smart nok. Problemene oppstår når en innebygd assistent behandles som en trygg erstatning for menneskelig vurdering. I kundestøtte er et selvsikkert feilsvar dyrt. Det kan utløse refusjoner, bryte retningslinjer og stille ødelegge tillit. Derfor er en AI-strategi for kundestøtte viktigere enn å skru på enda en AI-funksjon.

Det egentlige spørsmålet er hvem som tar avgjørelsen, og etter hvilke regler. Denne guiden viser hvor automatisering er lavrisiko, hvor det trengs gjennomgang, og hvordan du holder resultater konsistente med Think → Verify → Act, sikring mot hallusinasjoner og overleveringer som bevarer kontekst slik at kunder slipper å gjenta seg.

Hva «AI-strategi for kundestøtte» egentlig betyr i 2026

Strategi blir ofte et synonym for å bare skru det på. Én misforståelse er at du kan koble en assistent til helpdesken, peke den mot en kunnskapsbase og si deg ferdig. Den andre ytterligheten er at hvis assistenten kan svare, bør den svare på alt. Begge tilnærmingene bryter vanligvis sammen på de samme typene henvendelser: ekte kundespørsmål som krever vurdering, unntak eller nyanser i retningslinjene.

En solid AI-strategi for kundeopplevelsen er mye mer spesifikk. Den klargjør hvor assistenten deltar og hvor den ikke får ta avgjørelsen. Den setter også kvalitetsregler slik at svarene forblir forankret når retningslinjer, produkter og spesialtilfeller endrer seg.

Hvis du ikke kan forklare disse grunnprinsippene i klartekst, har du ingen strategi ennå. Du har en funksjon påskrudd og håper den gjør resten.

AI-chatboter, AI-assistenter, AI-agenter, Copilots: Roller uten forvirring

Disse betegnelsene blandes lett sammen, og det er slik team gir et verktøy mer autonomi enn det bør ha. For å holde begrepene klare, sammenligner tabellen nedenfor hver rolle etter tillatt autonomi og de vanligste feilene team opplever.

| Rolle | Tillatt autonomi | Typiske feil |

|---|---|---|

| Chatbot (skript/FAQ) | Svarer bare på det du har forhåndsskrevet og godkjent. | Blindveier utenfor skriptet; frustrerende løkker. |

| AI-assistent (innebygd AI) | Innebygd i Shopify eller Magento som en AI-funksjon. Oppsummerer, utkaster, klassifiserer og foreslår neste steg. | Overser butikkspesifikke nyanser; utkast som ignorerer spesialtilfeller; inkonsistent tone uten veiledning. |

| AI-chatbot (genererte svar) | Genererer svar basert på oppgitte kilder og samtalekontekst. | Hallusinasjoner; overløfter; utdaterte policyhenvisninger. |

| AI-agent (handlinger + arbeidsflyt) | Utfører handlinger på tvers av systemer basert på regler og godkjenninger. | Feil handlinger i stor skala; regelverksproblemer; kostbare feil uten sikring. |

| Copilot (for agenter) | Bistår en menneskelig agent med utkast og forslag; et menneske bestemmer hva som sendes eller gjøres. | Overtillit; kopier-og-lim-feil; svake gevinster ved dårlig kontekst. |

Når autonominivået er feil, skalerer feilene raskere enn støttekøen. Risikoen er ikke betegnelsen. Det er uklart ansvar.

Automatisering av kundestøtte: Hvor AI hjelper og hvor den ikke bør bestemme

Ikke alle støtteoppgaver er like automatiserbare. De tryggeste gevinstene kommer fra arbeidsflyter der assistenten ikke ved et uhell kan love penger, bøye retningslinjer eller utløse en irreversibel handling.

En enkel regel fungerer godt: automatiser det som er repeterende og verifiserbart, og hold et menneske i løkken når forespørselen involverer vurdering, unntak eller en reell forpliktelse.

Høy verdi, lav risiko-automatisering

Dette er oppgaver der hastighet betyr noe og svaret kan forankres i godkjente kilder.

- FAQ og grunnleggende policyspørsmål (når policyteksten er oppdatert)

- Datainnsamling (ordrenummer, e-post, bilder, årsak)

- Klassifisering og ruting (intentstagging, prioritering)

- Sammendrag og utkast (saksoppsummering, svarpåbegynnelse til gjennomgang)

Høyrisiko-automatisering (krever kontroll)

Disse forespørslene ser enkle ut, men én manglende detalj kan endre riktig utfall.

- Returer (spesialtilfeller for kvalifisering, frister)

- Kanselleringer (leveringsstatus, svindelkontroller)

- Leveringsløfter (restordrer, lagerbegrensninger)

- Kompensasjon (kreditter, erstatninger, fraktrefusjoner)

Hva som aldri bør være helautomatisk

Hvis utfallet påvirker penger, juridisk eksponering eller policyunntak, bør systemet som standard gå til en kontrollert overlevering.

- Penger (refusjoner, kreditter, rabatter)

- Juridiske forpliktelser (garantier, løfter, samsvarserklæringer)

- Policyunntak (manuelle overstyringer)

Risikomatrise

Bruk en enkel matrise for å definere hva assistenten kan gjøre per intensjon. Det sikrer at automatisert kundestøtte er konsistent på tvers av agenter, vakter og travle perioder. Se det som en standardrute: autosvar for lavrisikohenvendelser, overlevering til menneskelig vurdering der det kreves, og blokkering eller eskalering av kritiske saker.

| Intensjon / oppgave | Risikonivå | Tillatt automatisering | Påkrevde kilder / retningslinjer |

|---|---|---|---|

| Hvor er bestillingen min? | Lav | Autosvar tillatt | Fraktpolicy + sporingsdata |

| Endre leveringsadresse | Middels | Overlevering | Redigeringsregler for ordre + verifiseringssteg |

| Kanseller bestillingen min | Høy | Overlevering / blokker ved usikkerhet | Kanselleringspolicy + betalingsstatus |

| Refusjonsforespørsel | Høy | Kun overlevering | Refusjonspolicy + kvalifiseringsregler + ordrefakta |

| Rabattforespørsel | Høy | Blokker + alternativ flyt | Rabattpolicy + eskaleringsregler |

| Garanti / juridisk krav | Kritisk | Blokker + umiddelbar overlevering | Juridisk policy + menneskelig godkjenning |

Hvis en intensjon ikke er kartlagt ennå, bruk overlevering som standard, og legg den til når retningslinjene og kildene er på plass.

AI vs. menneskelig kundeservice: Skriv utkastet, godkjenn avgjørelsen

Når en assistent er innebygd i støttearbeidsflyten din, er det fristende å behandle den som en raskere agent. Men hastighet er ikke det samme som ansvar. Et generert svar kan høres polert ut og likevel ta feil på det ene punktet som betyr noe: hva det forplikter bedriften din til å gjøre.

Den tryggere modellen er enkel: la AI gjøre grovarbeidet, men hold avgjørelser ansvarlige. Bruk generativ AI i kundestøtte til analyse og utkast, ikke til selvstendige forpliktelser.

Assistenten kan lese tråden, hente relevante detaljer, sjekke godkjente kilder og foreslå et svar med begrunnelse. Et menneske godkjenner deretter det som sendes eller ruter saken videre når den involverer penger, policyunntak eller noe juridisk sensitivt. Tenk på det som et utkast og en redaktør. Du er fortsatt raskere, men med sikring på plass.

Tommelfingerregel: AI bør skrive utkastet. Teamet ditt bør godkjenne avgjørelsen.

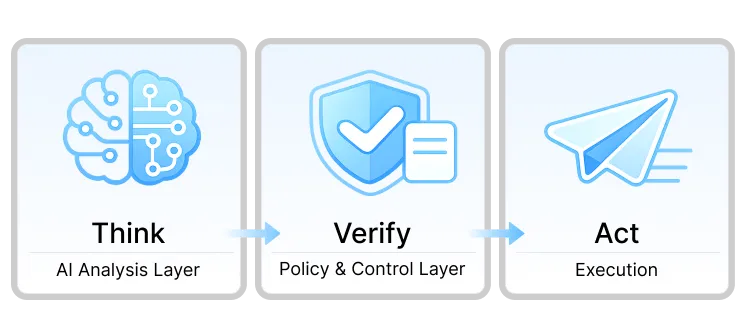

AI-arkitektur for kundestøtte: Think → Verify → Act

Du trenger ikke en assistent som kan sende meldinger på egen hånd. Du trenger en arbeidsflyt som skiller analyse fra godkjenning og holder utførelsen under kontroll. I praksis er dette en AI-implementering for kundeservice som hjelper deg å jobbe raskere med rutinearbeid uten å gjøre spesialtilfeller til kundevendte løfter.

Think: AI-analyselaget

Think skjer i kulissene. Assistenten leser meldingen og billetthistorikken, identifiserer intensjon, henter relevante detaljer fra godkjente kilder og utarbeider et svar med begrunnelse, konfidens og risikoflagg. Det er forberedelse, ikke et løfte, så det bør ikke være laget som snakker med kunden.

Verify: policy- og kontrollaget

Verify er kontrollpunktet. Utkastet sammenlignes med forretningsreglene dine og kildene det baserer seg på. Deretter velger arbeidsflyten ett utfall:

- Trygt autosvar (lavrisikointensjoner med solide kilder)

- Overlevering til et menneske (vurdering, unntak, manglende kontekst)

- Blokker + alternativ flyt (penger, juridisk, uklare forespørsler)

Act: utførelse

Act er den kontrollerte utførelsen. En trygg sak får et policyriktig svar. Alt som trenger et menneske rutes med nøkkelkonteksten allerede pakket, slik at agenten kan fortsette uten å lese hele tråden på nytt. Blokkerte saker følger en reserveflyt, som å samle inn manglende detaljer eller eskalere til en spesialist.

Slik ser dette ut i et ekte team

I det daglige går assistenten gjennom hele historikken, sjekker dokumentasjonen og produserer et kort sammendrag pluss et utkast til svar. Et menneske gjennomgår det, justerer for nyanser og sender det endelige svaret. Hvis utkastet bommer, ber agenten om en strammere versjon og itererer til det er nøyaktig og brukbart.

Poenget er ikke at AI aldri gjør feil. Poenget er at feil fanges opp før de blir kundevendte forpliktelser, mens teamet ditt sparer tid på lesing og førsteutkast.

Slik forebygger du AI-hallusinasjoner før de når kundene

I kundestøtte kan en oppdiktet detalj bli et løfte kunden holder deg til. Målet er enkelt: hold upålitelige svar borte fra kundene, spesielt når en forespørsel berører refusjoner, leveringsløfter eller policyunntak.

1. Svarpolicy (obligatorisk)

Start med et kort regelverk assistenten følger hver gang:

- Hva den har lov til å gjøre (utkast, oppsummere, stille oppklarende spørsmål, sitere godkjente kilder)

- Hva den aldri må gjøre (finne opp steg, gjette retningslinjer, love utfall den ikke kan verifisere)

- Når den må eskalere (penger, juridiske forpliktelser, unntak, lav konfidens)

2. Sikring som faktisk fungerer

Sikring hjelper bare når den matcher den virkelige arbeidsflyten. Det er her AI i kundeservice blir pålitelig:

- Forankring i godkjente kilder (kunnskapsbase, policysider, ordredata, sporing)

- Konfidensterksler (under terskelen, ingen autosvar)

- Risikoflagg som tvinger kontroll (penger, leveringsløfter, juridisk språk)

3. Enkel QA-sjekkliste for hallusinasjoner

Før du utvider automatisering til en ny intensjon, sjekk de vanligste årsakene til avdrift:

- Hull i kunnskapsbasen (ingen pålitelig forankring)

- Motstridende retningslinjer (regler som er uenige eller «unntak» som ikke er dokumentert)

- Spesialtilfeller (delsendinger, restordrer, pakker, engangsunntak)

Hvis du behandler hallusinasjoner som et arbeidsflytproblem i stedet for et modellproblem, løser du dem raskere og med langt færre kundevendte feil.

Slik overfører AI kontekst til mennesker

Før eller senere trenger en sak et menneske. En smidig overlevering føles som en fortsettelse av samtalen, ikke en omstart.

Tilliten brytes når kunder må gjenta seg, detaljer går tapt mellom systemer, eller neste agent motsier det assistenten sa tidligere. I det øyeblikket en kunde tror assistenten lovte noe, løser du ikke lenger en billett – du reparerer troverdighet.

For å unngå dette bør hver overlevering inkludere en liten, konsistent kontekstpakke. Det er dette som gjør samtale-AI til en reell oppgradering av arbeidsflyten i stedet for et ekstra lag i midten:

- Intensjon + konfidens (hva kunden prøver å gjøre, og hvor sikker systemet er)

- Ekstraherte felter (ordrenummer, e-post, produkt, datoer, fraktstatus, årsak)

- AI-sammendrag (ett avsnitt med oppsummering av hva som har skjedd så langt)

- Kilder brukt (hvilke retningslinjer eller KB-sider ble referert)

- Risikoflagg (penger, leveringsforpliktelser, juridisk, policyunntak)

For å bevare tilliten er selve overleveringsmeldingen viktig. Når du eskalerer, signal kontinuitet og unngå språk som høres ut som å starte på nytt. En enkel setning som dette fungerer vanligvis godt: «Vår spesialist har allerede detaljene og fortsetter herfra.» Hvis du trenger at kunden oppgir noe, vær spesifikk om hva som mangler og hvorfor, slik at det føles som fremgang, ikke friksjon.

Automatisering av kundeservice: Målinger å følge med på

Det er lett å bli begeistret over antall billetter som håndteres og overse det som faktisk betyr noe: fikk kunden riktig utfall, med riktig grad av sikkerhet?

Disse målingene viser om du forbedrer kvalitet og tillit, ikke bare flytter samtaler ut av køen:

- CSAT etter AI-interaksjoner: Følg med på tilfredshet spesifikt for AI-assisterte tråder, ikke bare den overordnede CSAT-en din.

- Eskaleringsårsaker: Merk hvorfor en sak ble overlevert (manglende data, policyunntak, lav konfidens, pengerelatert forespørsel) slik at du vet hva du skal fikse neste gang.

- Blokkerte AI-avgjørelser: Følg med på når sikringen stopper et utrygt svar eller handling, og gå gjennom de vanligste utløserne for å forbedre regler og kilder.

- Løsningstid etter overlevering: Mål om kontekstpakken hjelper agenter å fullføre raskere uten at kunder må gjenta seg.

- Spart agenttid: Estimer tidsbesparelse på å lese lange tråder, søke i retningslinjer og skrive førsteutkast.

Forfengelighetsmetrikker kan fortsatt hjelpe, men bare sammen med kvalitetssignaler:

- Avledning uten CSAT: Færre billetter betyr ingenting hvis kunder forlater frustrerte eller usikre.

- Hastighet uten korrekthet: Raske svar som utløser oppfølginger, refusjoner eller policykonflikter er negativ fremgang.

Hvis disse beveger seg i riktig retning sammen, bygger du et system som forblir nøyaktig under press og eskalerer trygt når det bør.

AI-veikart for støtte: En realistisk 30-dagers utrullingsplan

Du trenger ikke et perfekt system på dag én. Du trenger en trygg sekvens som starter med kontroll, beviser pålitelighet, og først da utvider autonomien.

Uke 1: Retningslinjer + KB-fundament

- Fokus: Svarpolicy, høyrisikointensjoner, rene godkjente kilder.

- Gate: Policy godkjent og kildeliste ferdigstilt.

Uke 2: Kun AI-analyse (ingen autosvar)

- Fokus: Intensjon + ekstraherte felter + utkast med begrunnelse, konfidens og risikoflagg. Mennesker sender alle svar. Logg feil.

- Gate: En målsatt andel av utkastene er brukbare med mindre redigeringer (ofte ~60–70 % som et tidlig mål).

Uke 3: Trygge intensjoner + kontrollert overlevering

- Fokus: Autosvar kun for lavrisikointensjoner. Middels/høy risiko rutes til mennesker med en kontekstpakke. Kritiske intensjoner blokkeres med en alternativ flyt.

- Gate: CSAT forblir stabil på lavrisiko-autosvar, og eskaleringsårsakene er tydelige.

Uke 4: Copilot + rutingoptimalisering

- Fokus: Copilot i agentarbeidsområdet, ruting finjustert fra logger, trygge intensjoner utvidet én kategori om gangen.

- Gate: Målingene forblir stabile (CSAT stabil, løsningstid forbedres, blokkerte avgjørelser synker, agenter rapporterer tidsbesparelse).

Hvis du ikke passerer en gate, ikke press videre. Fiks retningslinjene, kildene eller rutingen først, og utvid deretter igjen.

Konklusjon

På dette punktet er mønsteret tydelig. De fleste innebygde assistenter feiler ikke fordi de ikke kan skrive et greit svar, men fordi arbeidsflyten lar dem forplikte seg til utfall uten tilstrekkelig kontroll. Med en AI-strategi for kundestøtte holder du assistenten fokusert på research og utkast, og verifiserer alt som innebærer risiko før det når kunden.

Vil du komme i gang raskt? Velg noen lavrisikohenvendelser, skriv en enkel svarpolicy, og begynn å måle CSAT og eskaleringsgrunner umiddelbart. Derfra utvider du automasjonens handlingsrom kun når reglene, kildene og overleveringene holder seg pålitelige under reell belastning.

Ofte stilte spørsmål

Hva er de beste AI-verktøyene for kundestøtte i 2026?

Det finnes ikke ett «beste» verktøy for alle team, så det hjelper å sammenligne funksjoner som holder automatisering trygg. Prioriter grunnleggende arbeidsflyt: forankring i godkjente kilder, konfidens- eller risikosignaler og rene overleveringer som bevarer kontekst. Tillegg som tonekontroll eller flerspråklig støtte betyr noe først når grunnlaget er solid.

AI-chatbot for kundeservice vs. innebygd assistent: hva er forskjellen?

En innebygd assistent jobber inne i arbeidsflyten (utkast, oppsummeringer, ruting). En kundevendt bot snakker direkte med kunder, så den trenger strengere grenser og forutsigbar eskalering for alt som er ordrerelatert eller risikofylt.

Hvilke målinger bør du følge for AI i kundeservice?

Start med kvalitetssignaler, ikke volum: CSAT etter assisterte interaksjoner, eskaleringsårsaker og blokkerte risikobeslutninger. Følg deretter med på om overleveringer blir raskere og agenter bruker mindre tid på å søke og skrive utkast.

Hva er beste praksis for å forebygge hallusinasjoner i AI-kundeservice?

Start med analyse og utkast, ikke autosvar. Definer forbudte soner (penger, juridisk, unntak), krev verifisering for alt som er risikofylt, og utvid omfanget kun når resultatene forblir stabile på lavrisikointensjoner.

Lær hvordan du automatiserer kundestøtte med flyter, ruting, segmenter og SLA-logikk for ordrestatus, retur, kansellering og reklamasjoner.

En praktisk guide til å velge gratis chat: hva som betyr noe på gratisplaner, oppsett og når du bør oppgradere.

En praktisk guide til gratis kundestøtte på Shopify: prismodeller, funksjonsoversikt, skaleringsbegrensninger og hva du kan bruke når Inbox ikke lenger er nok.

Start gratis og sett alle butikkene, billettene og chattene dine under én helpdesk du kontrollerer.