KI-Strategie für den Kundenservice: Was automatisieren und was beim Menschen belassen

Eine KI-Strategie für den Kundenservice ist ein Rahmenwerk, das festlegt, wo KI unterstützen darf, wo sie eskalieren muss und wie Support-Teams Antworten präzise, richtlinienkonform und sicher im großen Maßstab halten.

Die meisten Teams scheitern nicht daran, dass ihre KI nicht intelligent genug ist. Probleme entstehen, wenn ein eingebetteter Assistent wie ein sicherer Ersatz für menschliches Urteilsvermögen behandelt wird. Im Kundenservice ist eine selbstbewusst falsche Antwort teuer. Sie kann Rückerstattungen auslösen, Richtlinien verletzen und unbemerkt Vertrauen beschädigen. Deshalb ist eine KI-Strategie für den Kundenservice wichtiger als die Aktivierung einer weiteren KI-Funktion.

Die eigentliche Frage lautet: Wer entscheidet – und nach welchen Regeln? Dieser Leitfaden zeigt, wo Automatisierung risikoarm ist, wo sie Prüfung erfordert und wie Sie mit Denken → Prüfen → Handeln, Schutzmechanismen gegen Halluzinationen und Übergaben, die den Kontext bewahren, konsistente Ergebnisse erzielen, damit Kunden sich nicht wiederholen müssen.

Was „KI-Strategie für den Kundenservice“ 2026 wirklich bedeutet

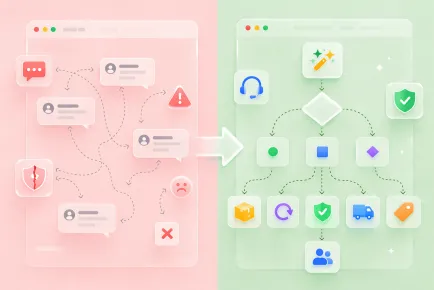

Strategie wird oft zum Synonym für bloßes Einschalten. Ein Irrtum: Man steckt einen Assistenten in sein Helpdesk, verbindet ihn mit einer Wissensdatenbank und erklärt es für erledigt. Das andere Extrem: Wenn der Assistent antworten kann, sollte er alles beantworten. Beide Ansätze scheitern meist an denselben Anfragen – echte Kundenfragen, die Urteilsvermögen, Ausnahmen oder Richtlinien-Nuancen erfordern.

Eine solide KI-Strategie für die Kundenerfahrung ist wesentlich konkreter. Sie legt fest, wo der Assistent mitwirkt und wo er nicht entscheiden darf. Außerdem definiert sie Qualitätsregeln, damit Antworten fundiert bleiben, wenn sich Richtlinien, Produkte und Sonderfälle ändern.

Wenn Sie diese Grundlagen nicht in einfacher Sprache erklären können, haben Sie noch keine Strategie. Sie haben eine Funktion aktiviert und hoffen, dass sie den Rest erledigt.

KI-Chatbots, KI-Assistenten, KI-Agenten, Copilots: Rollen ohne Verwirrung

Diese Bezeichnungen werden leicht verwechselt – und genau so geben Teams einem Tool mehr Autonomie als vorgesehen. Damit die Begriffe klar bleiben, vergleicht die folgende Tabelle jede Rolle nach erlaubter Autonomie und den häufigsten Fehlern.

| Rolle | Erlaubte Autonomie | Typische Fehler |

|---|---|---|

| Chatbot (Skripte/FAQ) | Antwortet nur auf das, was Sie vorab verfassen und freigeben. | Sackgassen außerhalb des Skripts; frustrierende Schleifen. |

| KI-Assistent (eingebettete KI) | In Shopify oder Magento als KI-Funktion integriert. Fasst zusammen, erstellt Entwürfe, klassifiziert und schlägt nächste Schritte vor. | Übersieht shop-spezifische Nuancen; Entwürfe, die Sonderfälle ignorieren; inkonsistenter Ton ohne Anleitung. |

| KI-Chatbot (generierte Antworten) | Generiert Antworten auf Basis bereitgestellter Quellen und des Gesprächskontexts. | Halluzinationen; überzogene Versprechen; veraltete Richtlinienverweise. |

| KI-Agent (Aktionen + Workflow) | Führt Aktionen über Systeme hinweg auf Basis von Regeln und Freigaben aus. | Falsche Aktionen in großem Maßstab; Compliance-Probleme; kostspielige Fehler ohne Schutzmechanismen. |

| Copilot (für Agenten) | Unterstützt einen menschlichen Agenten mit Entwürfen und Vorschlägen; ein Mensch entscheidet, was gesendet oder getan wird. | Übermäßiges Vertrauen; Copy-Paste-Fehler; geringe Vorteile bei schlechtem Kontext. |

Wenn die Autonomiestufe falsch ist, skalieren Fehler schneller als die Support-Warteschlange. Das Risiko liegt nicht in der Bezeichnung. Es liegt in unklarer Verantwortung.

Automatisierung im Kundenservice: Wo KI hilft und wo sie nicht entscheiden sollte

Nicht jede Support-Aufgabe lässt sich gleich gut automatisieren. Die sichersten Erfolge kommen aus Workflows, in denen der Assistent nicht versehentlich Geld versprechen, Richtlinien umgehen oder eine irreversible Aktion auslösen kann.

Eine einfache Regel funktioniert gut: Automatisieren Sie Wiederkehrendes und Überprüfbares und behalten Sie einen Menschen in der Schleife, wenn die Anfrage Urteilsvermögen, Ausnahmen oder eine echte Zusage erfordert.

Automatisierung mit hohem Nutzen und geringem Risiko

Das sind Aufgaben, bei denen Geschwindigkeit zählt und die Antwort auf genehmigten Quellen basieren kann.

- FAQ und grundlegende Richtlinienfragen (sofern der Richtlinientext aktuell ist)

- Datenerfassung (Bestellnummer, E-Mail, Fotos, Grund)

- Klassifizierung & Routing (Intent-Tagging, Prioritätsstufen)

- Zusammenfassungen & Entwürfe (Ticket-Zusammenfassung, Antwortentwurf zur Prüfung)

Hochrisiko-Automatisierung (erfordert Kontrolle)

Diese Anfragen wirken einfach, aber ein fehlendes Detail kann das korrekte Ergebnis verändern.

- Retouren (Grenzfälle bei Berechtigung, Fristen)

- Stornierungen (Fulfillment-Status, Betrugsprüfungen)

- Lieferversprechen (Nachbestellungen, Lagerbeschränkungen)

- Entschädigungen (Gutschriften, Ersatzlieferungen, Versandkostenerstattungen)

Was niemals vollständig autonom sein sollte

Wenn das Ergebnis Geld, rechtliche Risiken oder Richtlinien-Ausnahmen betrifft, sollte das System standardmäßig eine kontrollierte Übergabe einleiten.

- Geld (Rückerstattungen, Gutschriften, Rabatte)

- Rechtliche Verpflichtungen (Garantien, Gewährleistungen, Compliance-Erklärungen)

- Richtlinien-Ausnahmen (manuelle Überschreibungen)

Risikomatrix

Verwenden Sie eine einfache Matrix, um festzulegen, was der Assistent je nach Anfrage-Intent tun darf. So bleibt der automatisierte Kundensupport über alle Mitarbeiter, Schichten und Stoßzeiten hinweg konsistent. Das Prinzip: Automatische Antwort bei risikoarmen Intents, Übergabe bei Ermessensfragen, Blockierung oder Eskalation bei kritischen Fällen.

| Intent / Aufgabe | Risikostufe | Erlaubte Automatisierung | Erforderliche Quellen / Richtlinien |

|---|---|---|---|

| Wo ist meine Bestellung? | Niedrig | Automatische Antwort erlaubt | Versandrichtlinie + Tracking-Quelle |

| Lieferadresse ändern | Mittel | Übergabe | Bestelländerungsregeln + Verifizierungsschritte |

| Bestellung stornieren | Hoch | Übergabe / Blockierung bei Unsicherheit | Stornierungsrichtlinie + Zahlungsstatus |

| Rückerstattungsanfrage | Hoch | Nur Übergabe | Rückerstattungsrichtlinie + Berechtigungsregeln + Bestelldaten |

| Rabattanfrage | Hoch | Blockierung + alternativer Ablauf | Rabattrichtlinie + Eskalationsregeln |

| Garantie- / Rechtsanspruch | Kritisch | Blockierung + sofortige Übergabe | Rechtsrichtlinie + menschliche Freigabe |

Wenn ein Intent noch nicht zugeordnet ist, nehmen Sie eine Übergabe als Standard. Fügen Sie ihn hinzu, sobald Richtlinie und Quellen feststehen.

KI vs Mensch im Kundenservice: Entwurf erstellen, Entscheidung freigeben

Wenn ein Assistent in Ihren Support-Workflow eingebettet ist, liegt es nahe, ihn wie einen schnelleren Agenten zu behandeln. Aber Geschwindigkeit ist nicht dasselbe wie Verantwortung. Eine generierte Antwort kann geschliffen klingen und trotzdem genau dort falsch sein, wo es zählt: bei dem, wozu sie Ihr Unternehmen verpflichtet.

Das sicherere Modell ist einfach: Lassen Sie KI die schwere Arbeit erledigen, aber halten Sie Entscheidungen nachvollziehbar. Nutzen Sie generative KI im Kundenservice für Analyse und Entwürfe, nicht für eigenständige Zusagen.

Der Assistent kann den Thread lesen, relevante Details herausziehen, genehmigte Quellen prüfen und eine Antwort mit Begründung vorschlagen. Ein Mensch gibt dann frei, was gesendet wird, oder leitet den Fall weiter, wenn er Geld, Richtlinien-Ausnahmen oder rechtlich Sensibles betrifft. Stellen Sie es sich als Entwurf und Redakteur vor. Sie arbeiten weiterhin schneller – aber mit Schutzmechanismen.

Faustregel zum Teilen: KI sollte die Antwort entwerfen. Ihr Team sollte die Entscheidung freigeben.

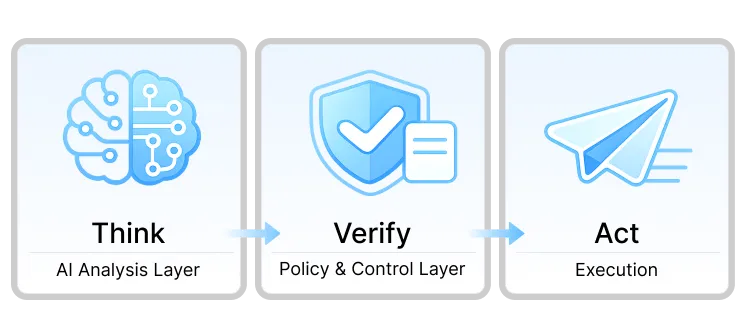

KI-Architektur im Kundenservice: Denken → Prüfen → Handeln

Sie brauchen keinen Assistenten, der eigenständig Nachrichten senden kann. Sie brauchen einen Workflow, der Analyse von Freigabe trennt und die Ausführung unter Kontrolle hält. In der Praxis ist das eine KI-Implementierung im Kundenservice, die Routinearbeit beschleunigt, ohne Sonderfälle zu kundengerichteten Versprechen zu machen.

Denken: KI-Analyseschicht

Die Denken-Phase läuft im Hintergrund. Der Assistent liest die Nachricht und die Ticket-Historie, identifiziert den Intent, zieht relevante Details aus genehmigten Quellen und erstellt einen Antwortentwurf mit Begründung, Konfidenzniveau und Risiko-Flags. Es ist Vorbereitung, kein Versprechen – daher sollte diese Schicht nicht direkt mit dem Kunden kommunizieren.

Prüfen: Richtlinien- und Kontrollschicht

Prüfen ist der Kontrollpunkt. Der Entwurf wird mit Ihren Geschäftsregeln und den verwendeten Quellen abgeglichen. Dann wählt der Workflow ein Ergebnis:

- Sichere automatische Antwort (Niedrigrisiko-Intents mit solider Quellengrundlage)

- Übergabe an einen Menschen (Urteilsvermögen, Ausnahmen, fehlender Kontext)

- Blockierung + alternativer Ablauf (Geld, rechtlich, unklare Anfragen)

Handeln: Ausführung

Handeln ist die kontrollierte Ausgabe. Ein sicherer Fall erhält eine richtlinienkonforme Antwort. Alles, was einen Menschen braucht, wird mit bereits aufbereitetem Schlüsselkontext weitergeleitet, damit der Agent fortfahren kann, ohne den gesamten Thread erneut zu lesen. Blockierte Fälle folgen einem Fallback-Pfad, etwa dem Sammeln fehlender Details oder der Eskalation an einen Spezialisten.

Wie das in einem echten Team aussieht

Im Tagesgeschäft prüft der Assistent die vollständige Historie, kontrolliert die Dokumentation und erstellt eine kurze Zusammenfassung mit Antwortentwurf. Ein Mensch prüft ihn, passt Nuancen an und sendet die endgültige Antwort. Wenn der Entwurf nicht trifft, fordert der Agent eine präzisere Version an und iteriert, bis sie korrekt und nutzbar ist.

Es geht nicht darum, dass KI nie Fehler macht. Es geht darum, dass Fehler erkannt werden, bevor sie zu kundengerichteten Zusagen werden – während Ihr Team Zeit beim Lesen und bei ersten Entwürfen spart.

Wie Sie KI-Halluzinationen verhindern, bevor sie Kunden erreichen

Im Support kann ein erfundenes Detail zu einem Versprechen werden, an dem ein Kunde Sie festhält. Das Ziel ist einfach: Halten Sie unzuverlässige Antworten von Kunden fern, besonders wenn eine Anfrage Rückerstattungen, Lieferversprechen oder Richtlinien-Ausnahmen betrifft.

1. Antwortrichtlinie (Pflicht)

Beginnen Sie mit einem kurzen Regelwerk, das der Assistent jedes Mal befolgt:

- Was er tun darf (Entwürfe erstellen, zusammenfassen, klärende Fragen stellen, genehmigte Quellen zitieren)

- Was er nie tun darf (Schritte erfinden, Richtlinien erraten, Ergebnisse versprechen, die er nicht verifizieren kann)

- Wann er eskalieren muss (Geld, rechtliche Verpflichtungen, Ausnahmen, niedrige Konfidenz)

2. Schutzmechanismen, die tatsächlich funktionieren

Schutzmechanismen helfen nur, wenn sie zum tatsächlichen Workflow passen. Hier wird KI im Kundenservice zuverlässig:

- Verankerung in genehmigten Quellen (Wissensdatenbank, Richtlinienseiten, Bestelldaten, Tracking)

- Konfidenzschwellen (unterhalb der Schwelle keine automatische Antwort)

- Risiko-Flags, die Kontrolle erzwingen (Geld, Lieferversprechen, juristische Sprache)

3. Einfache QA-Checkliste für Halluzinationen

Bevor Sie die Automatisierung auf einen neuen Intent ausweiten, prüfen Sie die häufigsten Drift-Auslöser:

- Lücken in Ihrer Wissensdatenbank (keine zuverlässige Grundlage)

- Widersprüchliche Richtlinien (Regeln, die sich widersprechen, oder „Ausnahmen“, die nicht dokumentiert sind)

- Sonderfälle (Teillieferungen, Nachbestellungen, Bundles, Einmalausnahmen)

Wenn Sie Halluzinationen als Workflow-Problem statt als Modell-Problem behandeln, beheben Sie sie schneller und mit deutlich weniger kundengerichteten Fehlern.

Wie KI Kontext an Menschen übergibt

Früher oder später braucht ein Fall einen Menschen. Eine reibungslose Übergabe fühlt sich an wie die Fortsetzung desselben Gesprächs, nicht wie ein Neustart.

Vertrauen bricht, wenn Kunden sich wiederholen müssen, Details zwischen Systemen verloren gehen oder der nächste Agent dem widerspricht, was der Assistent zuvor gesagt hat. Sobald ein Kunde glaubt, der Assistent habe etwas versprochen, lösen Sie kein Ticket mehr – Sie reparieren Ihre Glaubwürdigkeit.

Um das zu vermeiden, sollte jede Übergabe ein kleines, einheitliches Kontextpaket enthalten. Genau das macht konversationelle KI zu einem echten Workflow-Upgrade statt einer zusätzlichen Schicht dazwischen:

- Intent + Konfidenz (was der Kunde versucht und wie sicher sich das System ist)

- Extrahierte Felder (Bestellnummer, E-Mail, Produkt, Daten, Versandstatus, Grund)

- KI-Zusammenfassung (Zusammenfassung des bisherigen Verlaufs in einem Absatz)

- Verwendete Quellen (welche Richtlinien oder KB-Seiten referenziert wurden)

- Risiko-Flags (Geld, Lieferzusagen, rechtlich, Richtlinien-Ausnahme)

Um Vertrauen zu bewahren, kommt es auf die Übergabenachricht an. Bei einer Eskalation signalisieren Sie Kontinuität und vermeiden Formulierungen, die nach Neustart klingen. Eine einfache Zeile wie diese funktioniert meist gut: „Unser Spezialist hat bereits alle Details und wird von hier aus weiterarbeiten.“ Wenn Sie vom Kunden etwas benötigen, seien Sie konkret darüber, was fehlt und warum, damit es sich nach Fortschritt anfühlt und nicht nach Reibung.

Automatisierung im Kundenservice: Kennzahlen zum Verfolgen

Es ist leicht, sich von der Anzahl bearbeiteter Tickets begeistern zu lassen und zu übersehen, worauf es wirklich ankommt: Hat der Kunde das richtige Ergebnis mit dem richtigen Konfidenzniveau erhalten?

Diese Kennzahlen zeigen, ob Sie Qualität und Vertrauen verbessern und nicht nur Gespräche aus der Warteschlange schieben:

- CSAT nach KI-Interaktionen: Verfolgen Sie die Zufriedenheit speziell für KI-gestützte Threads, nicht nur Ihr Gesamt-CSAT.

- Eskalationsgründe: Taggen Sie, warum ein Fall übergeben wurde (fehlende Daten, Richtlinien-Ausnahme, niedrige Konfidenz, geldbezogene Anfrage), damit Sie wissen, was als Nächstes zu beheben ist.

- Blockierte KI-Entscheidungen: Verfolgen Sie, wann Schutzmechanismen eine unsichere Antwort oder Aktion stoppen, und prüfen Sie dann die häufigsten Auslöser, um Regeln und Quellen zu verfeinern.

- Lösungszeit nach Übergabe: Messen Sie, ob das Kontextpaket Agenten hilft, schneller abzuschließen, ohne dass Kunden sich wiederholen müssen.

- Eingesparte Agentenzeit: Schätzen Sie die Zeitersparnis beim Lesen langer Threads, Suchen nach Richtlinien und Erstellen erster Antworten.

Vanity Metrics können weiterhin helfen, aber nur zusammen mit Qualitätssignalen:

- Deflection ohne CSAT: Weniger Tickets bedeuten nichts, wenn Kunden frustriert oder unsicher gehen.

- Geschwindigkeit ohne Korrektheit: Schnelle Antworten, die Rückfragen, Rückerstattungen oder Richtlinienkonflikte auslösen, sind negativer Fortschritt.

Wenn sich diese Kennzahlen gemeinsam in die richtige Richtung bewegen, bauen Sie ein System, das unter Druck präzise bleibt und sicher eskaliert, wenn es nötig ist.

KI-Support-Roadmap: ein realistischer 30-Tage-Rollout-Plan

Sie brauchen kein perfektes System am ersten Tag. Sie brauchen eine sichere Abfolge, die mit Kontrolle beginnt, Zuverlässigkeit beweist und erst dann die Autonomie erweitert.

Woche 1: Richtlinien + Wissensdatenbank-Fundament

- Fokus: Antwortrichtlinie, Hochrisiko-Intents, saubere genehmigte Quellen.

- Gate: Richtlinie genehmigt und Quellenliste finalisiert.

Woche 2: Nur KI-Analyse (keine automatischen Antworten)

- Fokus: Intent + extrahierte Felder + Entwurf mit Begründung, Konfidenz und Risiko-Flags. Menschen senden alle Antworten. Fehler protokollieren.

- Gate: Ein Zielanteil der Entwürfe ist mit geringfügigen Anpassungen nutzbar (oft ~60–70 % als frühes Ziel).

Woche 3: Sichere Intents + kontrollierte Übergabe

- Fokus: Automatische Antworten nur für Niedrigrisiko-Intents. Mittleres/hohes Risiko wird mit Kontextpaket an Menschen weitergeleitet. Kritische Intents werden mit alternativem Ablauf blockiert.

- Gate: CSAT bleibt bei Niedrigrisiko-Auto-Antworten stabil und Eskalationsgründe sind klar.

Woche 4: Copilot + Routing-Optimierung

- Fokus: Copilot im Agenten-Workspace, Routing aus Logs optimiert, sichere Intents eine Kategorie nach der anderen erweitert.

- Gate: Kennzahlen bleiben stabil (CSAT stabil, Lösungszeit verbessert sich, blockierte Entscheidungen rückläufig, Agenten berichten Zeitersparnis).

Wenn Sie ein Gate nicht bestehen, gehen Sie nicht weiter. Beheben Sie zuerst die Richtlinie, Quellen oder das Routing und erweitern Sie dann erneut.

Fazit

An diesem Punkt ist das Muster klar. Die meisten eingebetteten Assistenten scheitern nicht, weil sie keine ordentliche Antwort schreiben können, sondern weil der Workflow ihnen erlaubt, sich ohne ausreichende Kontrolle auf Ergebnisse festzulegen. Mit einer KI-Strategie für den Kundenservice halten Sie den Assistenten auf Recherche und Entwürfe fokussiert und prüfen alles Risikobehaftete, bevor es den Kunden erreicht.

Als konkreten nächsten Schritt wählen Sie einige risikoarme Intents aus, erstellen eine einseitige Response-Policy und beginnen sofort mit der Messung von CSAT und Eskalationsgründen. Erweitern Sie den Automatisierungsgrad erst dann, wenn Regeln, Datenquellen und Übergaben auch unter realem Aufkommen zuverlässig funktionieren.

Häufig gestellte Fragen

Was sind die besten KI-Tools für den Kundenservice 2026?

Es gibt nicht das eine „beste“ Tool für jedes Team, daher lohnt es sich, Fähigkeiten zu vergleichen, die Automatisierung sicher halten. Priorisieren Sie Workflow-Grundlagen: Verankerung in genehmigten Quellen, Konfidenz- oder Risikosignale und saubere Übergaben, die den Kontext bewahren. Extras wie Tonsteuerung oder mehrsprachiger Support spielen erst eine Rolle, wenn diese Grundlagen stehen.

KI-Chatbot für den Kundenservice vs eingebetteter Assistent: Was ist der Unterschied?

Ein eingebetteter Assistent arbeitet innerhalb des Workflows (Entwürfe, Zusammenfassungen, Routing). Ein kundengerichteter Bot spricht direkt mit Käufern und braucht daher strengere Grenzen und vorhersagbare Eskalation für alles Bestellungsspezifische oder Risikobehaftete.

Welche Kennzahlen sollte man bei KI im Kundenservice verfolgen?

Beginnen Sie mit Qualitätssignalen, nicht mit Volumen: CSAT nach assistierten Interaktionen, Eskalationsgründe und blockierte riskante Entscheidungen. Beobachten Sie dann, ob Übergaben schneller werden und Agenten weniger Zeit mit Suchen und Entwerfen verbringen.

Was sind die Best Practices für KI im Kundenservice zur Vermeidung von Halluzinationen?

Beginnen Sie mit Analyse und Entwürfen, nicht mit automatischen Antworten. Definieren Sie No-Go-Zonen (Geld, rechtlich, Ausnahmen), verlangen Sie Verifizierung für alles Risikobehaftete und erweitern Sie den Umfang nur, wenn die Ergebnisse bei Niedrigrisiko-Intents stabil bleiben.

So automatisieren Sie Ihren Support mit Flows, Routing, Kundensegmentierung und SLA-Logik – für WISMO-Anfragen, Retouren, Stornierungen und Schadensreklamationen.

Ein praktischer Leitfaden zur Wahl eines kostenlosen Chats: Worauf es bei Free-Tarifen ankommt, wie Sie ihn einrichten und wann ein Upgrade sinnvoll ist.

Ein praktischer Leitfaden für kostenlosen Kundensupport auf Shopify: Preismodelle, Funktionsübersichten, Skalierungsgrenzen und was Sie nutzen können, wenn Inbox nicht mehr ausreicht.

Starten Sie kostenlos und vereinen Sie alle Shops, Tickets und Chats in einem Helpdesk.