กลยุทธ์ AI สำหรับงานซัพพอร์ตลูกค้า: อะไรควรทำอัตโนมัติ อะไรต้องใช้คนตัดสิน

กลยุทธ์ AI สำหรับงานซัพพอร์ตลูกค้าคือกรอบสำหรับตัดสินใจว่า AI ช่วยได้ตรงไหน ตรงไหนต้องยกระดับให้คน และทีมซัพพอร์ตจะรักษาคุณภาพคำตอบให้ถูกต้อง สอดคล้องกับนโยบาย และปลอดภัยในระดับใหญ่ได้อย่างไร

ทีมส่วนใหญ่ไม่ได้ล้มเหลวเพราะ AI ไม่เก่งพอ แต่ปัญหาเกิดขึ้นเมื่อปฏิบัติกับผู้ช่วย AI เหมือนเป็นตัวแทนการตัดสินใจที่ปลอดภัย ในงานซัพพอร์ตลูกค้า คำตอบผิดที่ดูมั่นใจนั้นมีต้นทุนสูง อาจนำไปสู่การคืนเงิน ผิดนโยบาย และทำลายความไว้วางใจอย่างเงียบ ๆ นั่นคือเหตุผลว่าทำไมกลยุทธ์ AI สำหรับงานซัพพอร์ตจึงสำคัญกว่าการเปิดใช้ฟีเจอร์ AI อีกตัวหนึ่ง

คำถามที่แท้จริงคือใครเป็นคนตัดสินใจ ภายใต้กฎอะไร คู่มือนี้ชี้ให้เห็นว่าการทำงานอัตโนมัติตรงไหนเสี่ยงต่ำ ตรงไหนต้องตรวจทาน และจะรักษาผลลัพธ์ให้สม่ำเสมอได้อย่างไรด้วย Think → Verify → Act กลไกป้องกัน Hallucination และการส่งต่อที่เก็บบริบทไว้ครบเพื่อให้ลูกค้าไม่ต้องเล่าซ้ำ

"กลยุทธ์ AI สำหรับงานซัพพอร์ตลูกค้า" หมายถึงอะไรจริง ๆ ในปี 2026

คำว่า "กลยุทธ์" มักกลายเป็นคำเรียกสั้น ๆ ของแค่การเปิดใช้งาน ความเข้าใจผิดแรกคือแค่ต่อผู้ช่วยเข้ากับ Helpdesk ชี้ไปที่ฐานความรู้ แล้วถือว่าเสร็จ อีกมุมหนึ่งคือขั้วตรงข้าม: ถ้าผู้ช่วยตอบได้ ก็ให้ตอบทุกอย่าง ทั้งสองแนวทางมักพังเมื่อเจอคำถามจริงของลูกค้าที่ต้องใช้วิจารณญาณ ข้อยกเว้น หรือความละเอียดอ่อนด้านนโยบาย

กลยุทธ์ AI สำหรับประสบการณ์ลูกค้าที่ดีจะเจาะจงกว่านั้นมาก กำหนดว่าผู้ช่วยมีส่วนร่วมตรงไหนและตรงไหนห้ามตัดสินใจเอง พร้อมตั้งกฎคุณภาพเพื่อให้คำตอบยังคงอ้างอิงได้ แม้นโยบาย สินค้า และกรณีพิเศษจะเปลี่ยนไป

ถ้าอธิบายพื้นฐานเหล่านี้เป็นภาษาง่าย ๆ ไม่ได้ แสดงว่ายังไม่มีกลยุทธ์ คุณแค่เปิดฟีเจอร์แล้วหวังว่ามันจะจัดการที่เหลือเอง

AI Chatbot, AI Assistant, AI Agent, Copilot: แบ่งบทบาทให้ชัดไม่สับสน

ป้ายชื่อเหล่านี้สับสนง่าย และนั่นทำให้ทีมให้อำนาจเครื่องมือมากเกินควร ตารางด้านล่างเปรียบเทียบแต่ละบทบาทตามระดับอำนาจที่อนุญาตและข้อผิดพลาดที่พบบ่อย

| บทบาท | ระดับอำนาจที่อนุญาต | ข้อผิดพลาดที่พบบ่อย |

|---|---|---|

| Chatbot (สคริปต์/FAQ) | ตอบเฉพาะสิ่งที่เขียนและอนุมัติไว้ล่วงหน้า | ตันเมื่ออยู่นอกสคริปต์ วนซ้ำจนน่าหงุดหงิด |

| AI Assistant (AI แบบฝังตัว) | ฝังอยู่ใน Shopify หรือ Magento เป็นฟีเจอร์ AI สรุป ร่างคำตอบ จำแนกประเภท แนะนำขั้นตอนถัดไป | พลาดรายละเอียดเฉพาะร้าน ร่างคำตอบที่ละเลยกรณีพิเศษ โทนไม่สม่ำเสมอเมื่อไม่มีแนวทาง |

| AI chatbot (คำตอบที่สร้างขึ้น) | สร้างคำตอบจากแหล่งข้อมูลที่ให้ไว้และบริบทของการสนทนา | Hallucination สัญญาเกินจริง อ้างอิงนโยบายที่ล้าสมัย |

| AI agent (ดำเนินการ + เวิร์กโฟลว์) | ดำเนินการข้ามระบบตามกฎและการอนุมัติ | ดำเนินการผิดในวงกว้าง ปัญหาการปฏิบัติตามกฎ ข้อผิดพลาดที่มีต้นทุนสูงเมื่อไร้กลไกควบคุม |

| Copilot (สำหรับเจ้าหน้าที่) | ช่วยเจ้าหน้าที่ด้วยร่างคำตอบและข้อเสนอแนะ คนเป็นผู้ตัดสินใจว่าจะส่งหรือทำอะไร | เชื่อถือมากเกินไป ผิดพลาดจากคัดลอก-วาง ประสิทธิผลต่ำถ้าบริบทไม่ดี |

เมื่อระดับอำนาจไม่เหมาะสม ข้อผิดพลาดจะขยายตัวเร็วกว่าคิวซัพพอร์ต ความเสี่ยงไม่ใช่ป้ายชื่อ แต่คือความรับผิดชอบที่ไม่ชัดเจน

ระบบอัตโนมัติสำหรับงานซัพพอร์ต: AI ช่วยได้ตรงไหน ตรงไหนไม่ควรให้ตัดสินใจ

ไม่ใช่ทุกงานซัพพอร์ตจะทำอัตโนมัติได้เท่ากัน ชัยชนะที่ปลอดภัยที่สุดมาจากเวิร์กโฟลว์ที่ผู้ช่วยไม่สามารถสัญญาเรื่องเงินโดยบังเอิญ บิดเบือนนโยบาย หรือก่อให้เกิดการดำเนินการที่ย้อนกลับไม่ได้

กฎง่าย ๆ ที่ใช้ได้ผล: ทำอัตโนมัติในสิ่งที่ซ้ำ ๆ และตรวจสอบได้ แต่ให้คนอยู่ในลูปเมื่อคำขอต้องใช้วิจารณญาณ เป็นข้อยกเว้น หรือเป็นข้อผูกมัดจริง

ระบบอัตโนมัติที่มูลค่าสูง ความเสี่ยงต่ำ

งานเหล่านี้ความเร็วสำคัญ และคำตอบสามารถอ้างอิงจากแหล่งที่อนุมัติแล้ว

- FAQ และคำถามนโยบายพื้นฐาน (เมื่อข้อความนโยบายเป็นปัจจุบัน)

- รวบรวมข้อมูล (หมายเลขคำสั่งซื้อ อีเมล ภาพถ่าย เหตุผล)

- การจำแนกประเภทและการจัดเส้นทาง (การติดแท็กความต้องการ การกำหนดลำดับความสำคัญ)

- สรุปและร่างข้อความ (สรุปทิกเก็ต ร่างคำตอบเพื่อตรวจสอบ)

ระบบอัตโนมัติความเสี่ยงสูง (ต้องมีการควบคุม)

คำขอเหล่านี้ดูง่าย แต่รายละเอียดที่ขาดหายไปเพียงอย่างเดียวสามารถเปลี่ยนผลลัพธ์ที่ถูกต้องได้

- การคืนสินค้า (กรณีพิเศษด้านสิทธิ์ กำหนดเวลา)

- การยกเลิก (สถานะจัดส่ง การตรวจสอบฉ้อโกง)

- สัญญาการจัดส่ง (สินค้าค้างส่ง ข้อจำกัดคลังสินค้า)

- การชดเชย (เครดิต สินค้าทดแทน คืนค่าจัดส่ง)

สิ่งที่ไม่ควรเป็นอัตโนมัติทั้งหมดเด็ดขาด

ถ้าผลลัพธ์กระทบเรื่องเงิน ความเสี่ยงทางกฎหมาย หรือข้อยกเว้นนโยบาย ระบบควรส่งต่อให้คนแบบควบคุมเป็นค่าเริ่มต้น

- เงิน (คืนเงิน เครดิต ส่วนลด)

- ข้อผูกมัดทางกฎหมาย (การรับประกัน การค้ำประกัน แถลงการณ์ด้าน Compliance)

- ข้อยกเว้นนโยบาย (การแทรกแซงด้วยตนเอง)

ตารางประเมินความเสี่ยง

ใช้ตารางอย่างง่ายในการกำหนดขอบเขตการทำงานของผู้ช่วยตามประเภทความต้องการ ช่วยให้ระบบซัพพอร์ตอัตโนมัติทำงานสม่ำเสมอทั้งทีม กะการทำงาน และช่วงเวลาที่งานหนาแน่น ใช้เป็นแนวทางหลัก: ตอบกลับอัตโนมัติสำหรับเรื่องความเสี่ยงต่ำ ส่งต่อเรื่องที่ต้องใช้วิจารณญาณ และบล็อกหรือยกระดับกรณีที่สำคัญ

| Intent / งาน | ระดับความเสี่ยง | ระบบอัตโนมัติที่อนุญาต | แหล่งข้อมูล / นโยบายที่จำเป็น |

|---|---|---|---|

| คำสั่งซื้อของฉันอยู่ไหน? | ต่ำ | ตอบอัตโนมัติได้ | นโยบายจัดส่ง + แหล่งติดตามพัสดุ |

| เปลี่ยนที่อยู่จัดส่ง | กลาง | ส่งต่อ | กฎแก้ไขคำสั่งซื้อ + ขั้นตอนยืนยัน |

| ยกเลิกคำสั่งซื้อ | สูง | ส่งต่อ / บล็อกถ้าไม่แน่ใจ | นโยบายการยกเลิก + สถานะการชำระเงิน |

| คำขอคืนเงิน | สูง | ส่งต่อเท่านั้น | นโยบายคืนเงิน + เกณฑ์สิทธิ์ + ข้อมูลคำสั่งซื้อ |

| คำขอส่วนลด | สูง | บล็อก + เส้นทางสำรอง | นโยบายส่วนลด + กฎการยกระดับ |

| เคลมการรับประกัน / ข้อเรียกร้องทางกฎหมาย | วิกฤต | บล็อก + ส่งต่อทันที | นโยบายกฎหมาย + การอนุมัติจากคน |

ถ้า Intent ไหนยังไม่ได้แมป ให้ส่งต่อเป็นค่าเริ่มต้น แล้วเพิ่มเข้ามาเมื่อนโยบายและแหล่งข้อมูลชัดเจนแล้ว

AI กับคนในงานบริการลูกค้า: AI ร่างคำตอบ คนอนุมัติการตัดสินใจ

เมื่อผู้ช่วยถูกฝังในเวิร์กโฟลว์ซัพพอร์ต เป็นเรื่องง่ายที่จะมองว่ามันเป็นเจ้าหน้าที่ที่เร็วกว่า แต่ความเร็วไม่เท่ากับความรับผิดชอบ คำตอบที่สร้างขึ้นอาจฟังดูเนี้ยบ แต่ยังผิดในจุดที่สำคัญที่สุด: สิ่งที่มันผูกมัดธุรกิจของคุณให้ทำต่อไป

โมเดลที่ปลอดภัยกว่านั้นง่าย: ให้ AI ทำงานหนัก แต่ให้การตัดสินใจมีผู้รับผิดชอบ ใช้ Generative AI ในงานซัพพอร์ตเพื่อวิเคราะห์และร่างคำตอบ ไม่ใช่เพื่อผูกมัดโดยลำพัง

ผู้ช่วยสามารถอ่านเธรด ดึงรายละเอียดที่เกี่ยวข้อง ตรวจสอบแหล่งข้อมูลที่อนุมัติ และเสนอคำตอบพร้อมเหตุผล จากนั้นคนอนุมัติสิ่งที่จะส่ง หรือส่งต่อเคสเมื่อเกี่ยวข้องกับเงิน ข้อยกเว้นนโยบาย หรือเรื่องที่มีความอ่อนไหวทางกฎหมาย มองว่าเป็นร่างและบรรณาธิการ ยังเร็วกว่าเดิม แต่มีกลไกควบคุม

หลักง่าย ๆ ที่แชร์ต่อได้: AI ร่างคำตอบ ทีมของคุณอนุมัติการตัดสินใจ

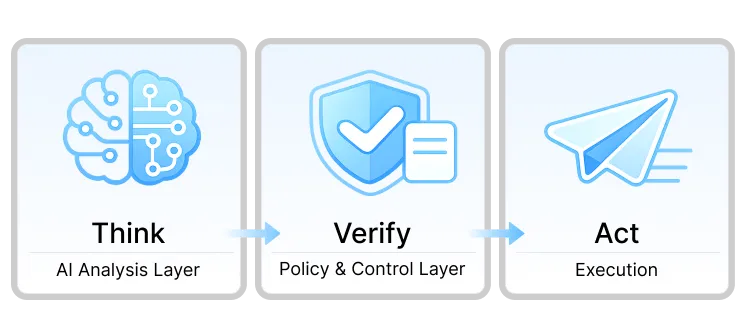

สถาปัตยกรรม AI สำหรับงานซัพพอร์ตลูกค้า: Think → Verify → Act

คุณไม่ต้องการผู้ช่วยที่ส่งข้อความเองได้ คุณต้องการเวิร์กโฟลว์ที่แยกการวิเคราะห์ออกจากการอนุมัติ และควบคุมการดำเนินการ ในทางปฏิบัตินี่คือการนำ AI มาใช้ในงานบริการลูกค้าที่ช่วยให้ทำงานประจำเร็วขึ้นโดยไม่เปลี่ยนกรณีพิเศษเป็นคำมั่นสัญญาต่อลูกค้า

Think: ชั้นวิเคราะห์ด้วย AI

Think ทำงานเบื้องหลัง ผู้ช่วยอ่านข้อความและประวัติตั๋ว ระบุ Intent ดึงรายละเอียดจากแหล่งที่อนุมัติ และร่างคำตอบพร้อมเหตุผล ระดับความมั่นใจ และธงความเสี่ยง มันเป็นการเตรียมการ ไม่ใช่คำมั่นสัญญา จึงไม่ควรเป็นชั้นที่พูดกับลูกค้า

Verify: ชั้นนโยบายและการควบคุม

Verify คือจุดตรวจสอบ ร่างคำตอบถูกเปรียบเทียบกับกฎธุรกิจและแหล่งข้อมูลที่อ้างอิง จากนั้นเวิร์กโฟลว์เลือกผลลัพธ์:

- ตอบอัตโนมัติที่ปลอดภัย (Intent เสี่ยงต่ำที่มีแหล่งอ้างอิงมั่นคง)

- ส่งต่อให้คน (ต้องใช้วิจารณญาณ ข้อยกเว้น บริบทขาดหาย)

- บล็อก + เส้นทางสำรอง (เงิน กฎหมาย คำขอที่ไม่ชัดเจน)

Act: การดำเนินการ

Act คือผลลัพธ์ที่ควบคุมแล้ว เคสที่ปลอดภัยจะได้คำตอบตามนโยบาย สิ่งที่ต้องการคนจะถูกส่งต่อพร้อมบริบทสำคัญที่จัดเตรียมไว้แล้ว เพื่อให้เจ้าหน้าที่ทำงานต่อได้โดยไม่ต้องอ่านทั้งเธรด เคสที่ถูกบล็อกจะเข้าเส้นทางสำรอง เช่น เก็บรายละเอียดที่ขาดหรือยกระดับไปยังผู้เชี่ยวชาญ

หน้าตาจริงในทีมงาน

ในแต่ละวัน ผู้ช่วยจะทบทวนประวัติทั้งหมด ตรวจสอบเอกสาร และสร้างสรุปสั้น ๆ พร้อมร่างคำตอบ คนตรวจทาน ปรับความละเอียด แล้วส่งคำตอบสุดท้าย ถ้าร่างยังไม่ตรงจุด เจ้าหน้าที่จะขอให้ปรับแก้และทำซ้ำจนกว่าจะถูกต้องและใช้ได้

ประเด็นไม่ใช่ว่า AI ไม่เคยทำผิดพลาด แต่ข้อผิดพลาดจะถูกจับก่อนที่จะกลายเป็นคำมั่นสัญญาต่อลูกค้า ในขณะที่ทีมของคุณประหยัดเวลาในการอ่านและร่างคำตอบแรก

วิธีป้องกัน AI Hallucination ก่อนที่จะถึงมือลูกค้า

ในงานซัพพอร์ต รายละเอียดที่แต่งขึ้นสามารถกลายเป็นสัญญาที่ลูกค้าจะถือเอาตามคำพูด เป้าหมายง่าย ๆ คือ กันคำตอบที่ไม่น่าเชื่อถือไม่ให้ถึงมือลูกค้า โดยเฉพาะเมื่อคำขอเกี่ยวข้องกับการคืนเงิน สัญญาจัดส่ง หรือข้อยกเว้นนโยบาย

1. นโยบายการตอบ (จำเป็น)

เริ่มด้วยกฎสั้น ๆ ที่ผู้ช่วยต้องปฏิบัติตามทุกครั้ง:

- สิ่งที่อนุญาตให้ทำ (ร่างคำตอบ สรุป ถามคำถามเพื่อความชัดเจน อ้างอิงแหล่งข้อมูลที่อนุมัติ)

- สิ่งที่ห้ามทำเด็ดขาด (แต่งขั้นตอนขึ้นมา เดานโยบาย สัญญาผลลัพธ์ที่ตรวจสอบไม่ได้)

- เมื่อต้องยกระดับ (เรื่องเงิน ข้อผูกมัดทางกฎหมาย ข้อยกเว้น ความมั่นใจต่ำ)

2. กลไกควบคุมที่ใช้ได้จริง

กลไกควบคุมจะช่วยได้ก็ต่อเมื่อสอดคล้องกับเวิร์กโฟลว์จริง จุดนี้คือจุดที่ AI ในงานบริการลูกค้ากลายเป็นสิ่งที่วางใจได้:

- ยึดโยงกับแหล่งข้อมูลที่อนุมัติ (ฐานความรู้ หน้านโยบาย ข้อมูลคำสั่งซื้อ การติดตามพัสดุ)

- เกณฑ์ความมั่นใจ (ต่ำกว่าเกณฑ์ ไม่ตอบอัตโนมัติ)

- ธงความเสี่ยงที่บังคับการควบคุม (เงิน สัญญาจัดส่ง ภาษากฎหมาย)

3. เช็กลิสต์ QA ป้องกัน Hallucination อย่างง่าย

ก่อนขยายระบบอัตโนมัติไปยัง Intent ใหม่ ตรวจสอบสาเหตุที่ทำให้เบี่ยงเบนบ่อยที่สุด:

- ช่องว่างในฐานความรู้ (ไม่มีข้อมูลที่เชื่อถือได้ให้อ้างอิง)

- นโยบายขัดแย้ง (กฎที่ไม่สอดคล้องกัน หรือ "ข้อยกเว้น" ที่ไม่ได้บันทึกไว้)

- กรณีพิเศษ (จัดส่งบางส่วน สินค้าค้างส่ง สินค้าชุด ข้อยกเว้นเฉพาะกรณี)

ถ้ามอง Hallucination เป็นปัญหาเวิร์กโฟลว์แทนที่จะเป็นปัญหาโมเดล คุณจะแก้ได้เร็วขึ้นและมีข้อผิดพลาดที่กระทบลูกค้าน้อยกว่ามาก

AI ส่งต่อบริบทให้คนอย่างไร

ไม่ช้าก็เร็ว เคสหนึ่งจะต้องการคน การส่งต่อที่ราบรื่นให้ความรู้สึกเหมือนบทสนทนาเดิมดำเนินต่อ ไม่ใช่เริ่มใหม่

ความไว้วางใจพังเมื่อลูกค้าต้องเล่าซ้ำ รายละเอียดหายระหว่างระบบ หรือเจ้าหน้าที่คนต่อไปขัดกับสิ่งที่ผู้ช่วยพูดไว้ก่อนหน้า ช่วงเวลาที่ลูกค้าคิดว่าผู้ช่วยสัญญาอะไรไว้ คุณไม่ได้แก้ตั๋วอีกต่อไปแล้ว คุณกำลังซ่อมความน่าเชื่อถือ

เพื่อหลีกเลี่ยงปัญหานี้ ทุกการส่งต่อควรมีชุดข้อมูลบริบทที่กระชับและสม่ำเสมอ นี่คือสิ่งที่เปลี่ยน Conversational AI จากแค่ชั้นเพิ่มเติมให้เป็นการอัปเกรดเวิร์กโฟลว์จริง:

- Intent + ระดับความมั่นใจ (ลูกค้าต้องการทำอะไร และระบบมั่นใจแค่ไหน)

- ข้อมูลที่ดึงมา (หมายเลขคำสั่งซื้อ อีเมล สินค้า วันที่ สถานะจัดส่ง เหตุผล)

- สรุปจาก AI (ย่อสิ่งที่เกิดขึ้นในหนึ่งย่อหน้า)

- แหล่งข้อมูลที่ใช้ (อ้างอิงนโยบายหรือหน้า KB ใดบ้าง)

- ธงความเสี่ยง (เงิน สัญญาจัดส่ง กฎหมาย ข้อยกเว้นนโยบาย)

เพื่อรักษาความไว้วางใจ ข้อความส่งต่อนั้นสำคัญ เมื่อยกระดับ ให้ส่งสัญญาณความต่อเนื่องและหลีกเลี่ยงภาษาที่ฟังเหมือนเริ่มใหม่ ประโยคง่าย ๆ แบบนี้มักได้ผลดี: "ผู้เชี่ยวชาญของเรามีรายละเอียดทั้งหมดแล้วและจะดำเนินการต่อจากตรงนี้" ถ้าต้องการให้ลูกค้าให้ข้อมูลเพิ่ม ให้ระบุชัดว่าอะไรขาดหายและทำไม เพื่อให้รู้สึกเหมือนมีความคืบหน้า ไม่ใช่ความยุ่งยาก

ระบบอัตโนมัติสำหรับงานบริการลูกค้า: ตัวชี้วัดที่ต้องติดตาม

เป็นเรื่องง่ายที่จะตื่นเต้นกับจำนวนตั๋วที่จัดการได้และมองข้ามสิ่งที่สำคัญจริง ๆ: ลูกค้าได้ผลลัพธ์ที่ถูกต้องด้วยระดับความมั่นใจที่เหมาะสมหรือไม่?

ตัวชี้วัดเหล่านี้แสดงว่าคุณกำลังปรับปรุงคุณภาพและความไว้วางใจ ไม่ใช่แค่เลื่อนบทสนทนาออกจากคิว:

- CSAT หลังการโต้ตอบกับ AI: ติดตามความพึงพอใจเฉพาะเธรดที่ AI ช่วยดูแล ไม่ใช่แค่ CSAT ภาพรวม

- เหตุผลการยกระดับ: ติดแท็กว่าทำไมเคสถึงถูกส่งต่อ (ข้อมูลขาด ข้อยกเว้นนโยบาย ความมั่นใจต่ำ คำขอเกี่ยวกับเงิน) เพื่อให้รู้ว่าต้องแก้อะไรต่อไป

- การตัดสินใจของ AI ที่ถูกบล็อก: ติดตามเมื่อกลไกควบคุมหยุดคำตอบหรือการดำเนินการที่ไม่ปลอดภัย จากนั้นทบทวนสาเหตุหลักเพื่อปรับปรุงกฎและแหล่งข้อมูล

- เวลาแก้ปัญหาหลังส่งต่อ: วัดว่าชุดข้อมูลบริบทช่วยให้เจ้าหน้าที่ปิดเคสเร็วขึ้นโดยไม่ต้องให้ลูกค้าเล่าซ้ำหรือไม่

- เวลาที่เจ้าหน้าที่ประหยัดได้: ประมาณเวลาที่ลดได้จากการอ่านเธรดยาว ค้นหานโยบาย และร่างคำตอบแรก

ตัวชี้วัดภาพลักษณ์ยังมีประโยชน์ แต่เฉพาะเมื่อใช้ควบคู่กับสัญญาณคุณภาพ:

- การเบี่ยงเบนตั๋วโดยไม่มี CSAT: ตั๋วน้อยลงไม่มีความหมายถ้าลูกค้าจากไปด้วยความหงุดหงิดหรือไม่แน่ใจ

- ความเร็วโดยไม่ถูกต้อง: คำตอบเร็วที่ทำให้เกิดการติดตามผล คืนเงิน หรือขัดแย้งกับนโยบาย ถือเป็นความก้าวหน้าในทางลบ

ถ้าตัวชี้วัดเหล่านี้เคลื่อนไปในทิศทางที่ถูกต้องพร้อมกัน คุณกำลังสร้างระบบที่แม่นยำภายใต้แรงกดดันและยกระดับอย่างปลอดภัยเมื่อจำเป็น

แผนงาน AI ซัพพอร์ต: แผนเปิดตัว 30 วันที่ทำได้จริง

ไม่จำเป็นต้องมีระบบที่สมบูรณ์แบบตั้งแต่วันแรก สิ่งที่ต้องการคือลำดับที่ปลอดภัยซึ่งเริ่มจากการควบคุม พิสูจน์ความน่าเชื่อถือ แล้วจึงขยายอำนาจ

สัปดาห์ที่ 1: วางรากฐานนโยบาย + ฐานความรู้

- โฟกัส: นโยบายการตอบ Intent ที่เสี่ยงสูง แหล่งข้อมูลที่อนุมัติและตรวจสอบแล้ว

- เกณฑ์ผ่าน: นโยบายได้รับอนุมัติและรายการแหล่งข้อมูลสรุปแล้ว

สัปดาห์ที่ 2: AI วิเคราะห์เท่านั้น (ไม่ตอบอัตโนมัติ)

- โฟกัส: Intent + ข้อมูลที่ดึงมา + ร่างคำตอบพร้อมเหตุผล ระดับความมั่นใจ และธงความเสี่ยง คนส่งคำตอบทั้งหมด บันทึกข้อผิดพลาด

- เกณฑ์ผ่าน: สัดส่วนร่างคำตอบที่ใช้ได้ด้วยการแก้ไขเล็กน้อยถึงเป้าหมาย (มักตั้งไว้ ~60–70% เป็นเป้าเริ่มต้น)

สัปดาห์ที่ 3: Intent ที่ปลอดภัย + การส่งต่อแบบควบคุม

- โฟกัส: ตอบอัตโนมัติเฉพาะ Intent ที่เสี่ยงต่ำ ความเสี่ยงกลาง/สูงส่งต่อให้คนพร้อมชุดข้อมูลบริบท Intent วิกฤตถูกบล็อกพร้อมเส้นทางสำรอง

- เกณฑ์ผ่าน: CSAT คงที่สำหรับการตอบอัตโนมัติเสี่ยงต่ำ และเหตุผลการยกระดับชัดเจน

สัปดาห์ที่ 4: Copilot + ปรับปรุงการจัดส่งงาน

- โฟกัส: Copilot ในพื้นที่ทำงานของเจ้าหน้าที่ ปรับการจัดส่งงานจากบันทึก ขยาย Intent ที่ปลอดภัยทีละหมวดหมู่

- เกณฑ์ผ่าน: ตัวชี้วัดคงที่ (CSAT มั่นคง เวลาแก้ปัญหาดีขึ้น การตัดสินใจที่ถูกบล็อกลดลง เจ้าหน้าที่รายงานว่าประหยัดเวลา)

ถ้าไม่ผ่านเกณฑ์ อย่าฝืนเดินหน้า แก้นโยบาย แหล่งข้อมูล หรือการจัดส่งงานก่อน แล้วค่อยขยายอีกครั้ง

สรุป

ถึงตรงนี้ รูปแบบชัดเจน ผู้ช่วย AI ส่วนใหญ่ล้มเหลวไม่ใช่เพราะเขียนคำตอบไม่ดี แต่เพราะเวิร์กโฟลว์ปล่อยให้ผูกมัดผลลัพธ์โดยไม่มีการควบคุมเพียงพอ ด้วยกลยุทธ์ AI สำหรับงานซัพพอร์ตลูกค้า คุณให้ผู้ช่วยโฟกัสที่การค้นคว้าและร่างคำตอบ แล้วตรวจสอบทุกอย่างที่มีความเสี่ยงก่อนถึงมือลูกค้า

หากต้องการเริ่มต้นในทางปฏิบัติ เลือกความต้องการที่มีความเสี่ยงต่ำสักไม่กี่รายการ เขียนนโยบายการตอบกลับสั้น ๆ หนึ่งหน้า แล้วเริ่มวัด CSAT และสาเหตุการยกระดับทันที จากนั้นค่อยขยายการทำงานอัตโนมัติเมื่อกฎ แหล่งข้อมูล และการส่งต่อยังคงเชื่อถือได้ในปริมาณงานจริง

คำถามที่พบบ่อย

เครื่องมือ AI ที่ดีที่สุดสำหรับงานซัพพอร์ตลูกค้าในปี 2026 คืออะไร?

ไม่มีเครื่องมือ "ดีที่สุด" สำหรับทุกทีม ดังนั้นควรเปรียบเทียบความสามารถที่ทำให้ระบบอัตโนมัติปลอดภัย ให้ความสำคัญกับพื้นฐานเวิร์กโฟลว์: การยึดโยงกับแหล่งข้อมูลที่อนุมัติ สัญญาณความมั่นใจหรือความเสี่ยง และการส่งต่อที่เก็บบริบทไว้ครบ ฟีเจอร์เสริมอย่างการควบคุมโทนหรือรองรับหลายภาษาจะสำคัญก็ต่อเมื่อพื้นฐานแข็งแรงแล้ว

AI chatbot สำหรับงานบริการลูกค้า กับ Embedded Assistant ต่างกันอย่างไร?

Embedded Assistant ทำงานภายในเวิร์กโฟลว์ (ร่างคำตอบ สรุป จัดส่งงาน) ส่วนบอทที่หันหน้าเข้าหาลูกค้าสื่อสารกับผู้ซื้อโดยตรง จึงต้องมีขอบเขตที่เข้มงวดกว่าและการยกระดับที่คาดเดาได้สำหรับทุกเรื่องที่เกี่ยวกับคำสั่งซื้อหรือมีความเสี่ยง

ตัวชี้วัดอะไรที่ควรติดตามสำหรับ AI ในงานบริการลูกค้า?

เริ่มจากสัญญาณคุณภาพ ไม่ใช่ปริมาณ: CSAT หลังการโต้ตอบที่ AI ช่วย เหตุผลการยกระดับ และการตัดสินใจเสี่ยงที่ถูกบล็อก จากนั้นดูว่าการส่งต่อเร็วขึ้นหรือไม่และเจ้าหน้าที่ใช้เวลาค้นหาและร่างคำตอบน้อยลงหรือไม่

แนวทางปฏิบัติที่ดีที่สุดของ AI ในงานบริการลูกค้าเพื่อป้องกัน Hallucination คืออะไร?

เริ่มจากการวิเคราะห์และร่างคำตอบ ไม่ใช่ตอบอัตโนมัติ กำหนดโซนห้ามเข้า (เงิน กฎหมาย ข้อยกเว้น) กำหนดให้ตรวจสอบทุกเรื่องที่เสี่ยง และขยายขอบเขตเฉพาะเมื่อผลลัพธ์มั่นคงใน Intent ที่เสี่ยงต่ำ

เรียนรู้วิธีทำระบบซัพพอร์ตอัตโนมัติด้วย Flow การจัดเส้นทาง การแบ่งกลุ่มลูกค้า และตรรกะ SLA ครอบคลุมทั้ง WISMO การคืนสินค้า การยกเลิก และการเรียกร้องความเสียหาย

คู่มือเลือกแชทฟรี: สิ่งที่สำคัญในแผนฟรี วิธีตั้งค่า และเมื่อไหร่ควรอัปเกรด

คู่มือเชิงปฏิบัติสำหรับการให้บริการลูกค้าฟรีบน Shopify: รูปแบบราคา, ภาพรวมฟีเจอร์, ข้อจำกัดด้านการขยายตัว และควรใช้อะไรเมื่อ Inbox ไม่เพียงพออีกต่อไป

เริ่มต้นฟรีและรวมร้านค้า ตั๋ว และแชททั้งหมดของคุณไว้ใน Helpdesk เดียวที่คุณควบคุม