AI-strategi för kundsupport: vad du bör automatisera och vad som kräver mänsklig bedömning

En AI-strategi för kundsupport är ett ramverk för att avgöra var AI kan hjälpa till, var ärenden måste eskaleras och hur supportteam håller svar korrekta, policyenliga och säkra i stor skala.

De flesta team misslyckas inte för att deras AI är för dålig. Problemen uppstår när en inbyggd assistent behandlas som ett säkert substitut för mänskligt omdöme. Inom kundsupport är ett självsäkert men felaktigt svar dyrt. Det kan utlösa återbetalningar, bryta mot policyer och i tysthet urholka förtroendet. Därför är en genomtänkt AI-strategi viktigare än att aktivera ännu en AI-funktion.

Den verkliga frågan är vem som fattar besluten och under vilka regler. Den här guiden visar var automatisering innebär låg risk, var den behöver granskning och hur du håller resultaten konsekventa med Think → Verify → Act, skyddsmekanismer mot hallucinationer och överlämningar som bevarar kontexten så att kunder inte behöver upprepa sig.

Vad "AI-strategi för kundsupport" verkligen innebär 2026

Strategi blir ofta en omskrivning för att bara slå på funktionen. En vanlig missuppfattning är att det räcker med att koppla en assistent till helpdesken, peka den mot en kunskapsbas och anse sig klar. Den andra ytterligheten är att assistenten borde svara på allt den kan svara på. Båda synsätten brukar fallera på samma typ av frågor: riktiga kundärenden som kräver bedömning, undantag eller policynyanser.

En gedigen AI-strategi för kundupplevelsen är mycket mer specifik. Den klargör var assistenten deltar och var den inte får fatta beslut. Den sätter också kvalitetsregler så att svaren förblir förankrade även när policyer, produkter och specialfall ändras.

Om du inte kan förklara grunderna med enkla ord har du ingen strategi ännu. Du har en funktion påslagen och hoppas att den sköter resten.

AI-chatbotar, AI-assistenter, AI-agenter, Copilots: roller utan förvirring

De här begreppen blandas lätt ihop, och det är så team ger ett verktyg mer autonomi än det borde ha. Tabellen nedan jämför varje roll utifrån tillåten autonomi och de vanligaste misstagen.

| Roll | Tillåten autonomi | Vanliga problem |

|---|---|---|

| Chatbot (skript/FAQ) | Svarar bara på det du skrivit och godkänt i förväg. | Återvändsgränder utanför skriptet; frustrerande loopar. |

| AI-assistent (inbyggd AI) | Inbyggd i Shopify eller Magento som en AI-funktion. Sammanfattar, föreslår utkast, klassificerar och rekommenderar nästa steg. | Missar butiksspecifika nyanser; utkast som ignorerar specialfall; inkonsekvent ton utan riktlinjer. |

| AI-chatbot (genererade svar) | Genererar svar baserat på godkända källor och konversationskontext. | Hallucinationer; överlöften; föråldrade policyreferenser. |

| AI-agent (åtgärder + arbetsflöde) | Utför åtgärder i flera system baserat på regler och godkännanden. | Felaktiga åtgärder i stor skala; regelefterlevnadsproblem; kostsamma misstag utan skyddsmekanismer. |

| Copilot (för agenter) | Assisterar en mänsklig agent med utkast och förslag; en person avgör vad som skickas eller görs. | Övertillit; kopiera-och-klistra-fel; svaga vinster om kontexten är bristfällig. |

När autonominivån är fel skalas misstagen snabbare än supportkön. Risken ligger inte i etiketten – den ligger i otydligt ansvar.

Automatisering av kundsupport: var AI hjälper och var den inte bör besluta

Inte alla supportuppgifter går lika bra att automatisera. De säkraste vinsterna kommer från arbetsflöden där assistenten inte av misstag kan lova pengar, böja policyer eller utlösa en oåterkallelig åtgärd.

En enkel regel fungerar bra: automatisera det som är repetitivt och verifierbart, och ha en människa i loopen när begäran kräver bedömning, undantag eller ett faktiskt åtagande.

Automatisering med högt värde och låg risk

Det här är uppgifter där snabbhet är viktigt och svaret kan grundas i godkända källor.

- FAQ och grundläggande policyfrågor (när policytexten är aktuell)

- Datainsamling (ordernummer, e-post, foton, anledning)

- Klassificering & routing (intentstaggning, prioritering)

- Sammanfattningar & utkast (ärendeöversikt, svarsutkast för granskning)

Högriskautomatisering (kräver kontroll)

De här förfrågningarna ser enkla ut, men en saknad detalj kan ändra rätt utfall.

- Returer (gränsfall i behörighet, tidsfrister)

- Avbeställningar (leveransstatus, bedrägerikontroller)

- Leveranslöften (restordrar, lagerbegränsningar)

- Kompensation (tillgodohavanden, ersättningsprodukter, fraktåterbetalningar)

Vad som aldrig bör vara helt autonomt

Om utfallet påverkar pengar, juridisk exponering eller policyundantag bör systemet som standard göra en kontrollerad överlämning.

- Pengar (återbetalningar, tillgodohavanden, rabatter)

- Juridiska åtaganden (garantier, utfästelser, regelefterlevnad)

- Policyundantag (manuella överträdanden)

Riskmatris

Använd en enkel matris för att avgöra vad assistenten får göra per intention. Det håller automatiserad kundsupport konsekvent oavsett handläggare, arbetspass och högsäsong. Se det som en standardväg: autosvar för lågriskärenden, överlämning till människa när omdöme krävs, och blockering eller eskalering av kritiska ärenden.

| Ärendetyp / uppgift | Risknivå | Tillåten automatisering | Nödvändiga källor / policyer |

|---|---|---|---|

| Var är min beställning? | Låg | Autosvar tillåtet | Fraktpolicy + spårningskälla |

| Ändra leveransadress | Medel | Överlämning | Regler för orderändringar + verifieringssteg |

| Avbeställ min order | Hög | Överlämning / blockering vid osäkerhet | Avbeställningspolicy + betalningsstatus |

| Begäran om återbetalning | Hög | Enbart överlämning | Återbetalningspolicy + behörighetsregler + orderuppgifter |

| Begäran om rabatt | Hög | Blockering + alternativt flöde | Rabattpolicy + eskaleringsregler |

| Garanti- / juridiskt anspråk | Kritisk | Blockering + omedelbar överlämning | Juridisk policy + mänskligt godkännande |

Om en ärendetyp inte är mappad ännu, gör en överlämning som standard och lägg till den när policy och källor är klarlagda.

AI vs mänsklig kundservice: ta fram utkastet, godkänn beslutet

När en assistent är inbyggd i ert supportflöde är det frestande att behandla den som en snabbare agent. Men snabbhet är inte detsamma som ansvar. Ett genererat svar kan låta polerat men ändå vara fel på den punkt som spelar roll: vad det binder ert företag att göra härnäst.

Den säkrare modellen är enkel: låt AI göra grovjobbet, men håll besluten ansvarsfulla. Använd generativ AI i kundsupporten för analys och utkast, inte för självständiga åtaganden.

Assistenten kan läsa tråden, hämta relevanta detaljer, kontrollera godkända källor och föreslå ett svar med resonemang. En människa godkänner sedan det som skickas eller dirigerar ärendet när det rör pengar, policyundantag eller juridiskt känsliga frågor. Se det som ett utkast och en redaktör. Ni arbetar fortfarande snabbare, men med skyddsmekanismer.

Enkel tumregel att dela: AI tar fram utkastet. Ert team godkänner beslutet.

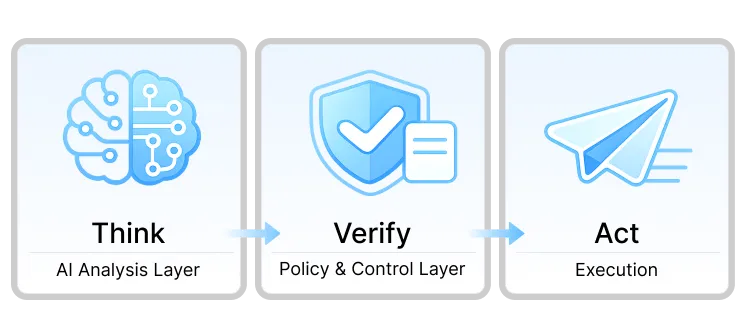

AI-arkitektur för kundsupport: Think → Verify → Act

Du behöver inte en assistent som kan skicka meddelanden på egen hand. Du behöver ett arbetsflöde som skiljer analys från godkännande och håller utförandet under kontroll. I praktiken är det här en AI-implementation för kundservice som hjälper er arbeta snabbare med rutinärenden utan att specialfall förvandlas till löften gentemot kunder.

Think: AI-analyslager

Think sker bakom kulisserna. Assistenten läser meddelandet och ärendehistoriken, identifierar avsikten, hämtar relevanta detaljer från godkända källor och tar fram ett utkast med resonemang, konfidensgrad och riskflaggor. Det är förberedelse, inte ett löfte – så det bör inte vara lagret som talar med kunden.

Verify: policy- och kontrollager

Verify är kontrollpunkten. Utkastet jämförs mot era affärsregler och de källor det bygger på. Sedan väljer arbetsflödet ett utfall:

- Säkert autosvar (lågriskärenden med pålitliga källor)

- Överlämning till en människa (bedömning, undantag, saknad kontext)

- Blockering + alternativt flöde (pengar, juridik, otydliga förfrågningar)

Act: utförande

Act är den kontrollerade utmatningen. Ett säkert ärende får ett policyenligt svar. Allt som behöver en person dirigeras med nyckelkontexten redan paketerad, så att agenten kan fortsätta utan att läsa om hela tråden. Blockerade ärenden följer en reservväg, som att samla in saknade detaljer eller eskalera till en specialist.

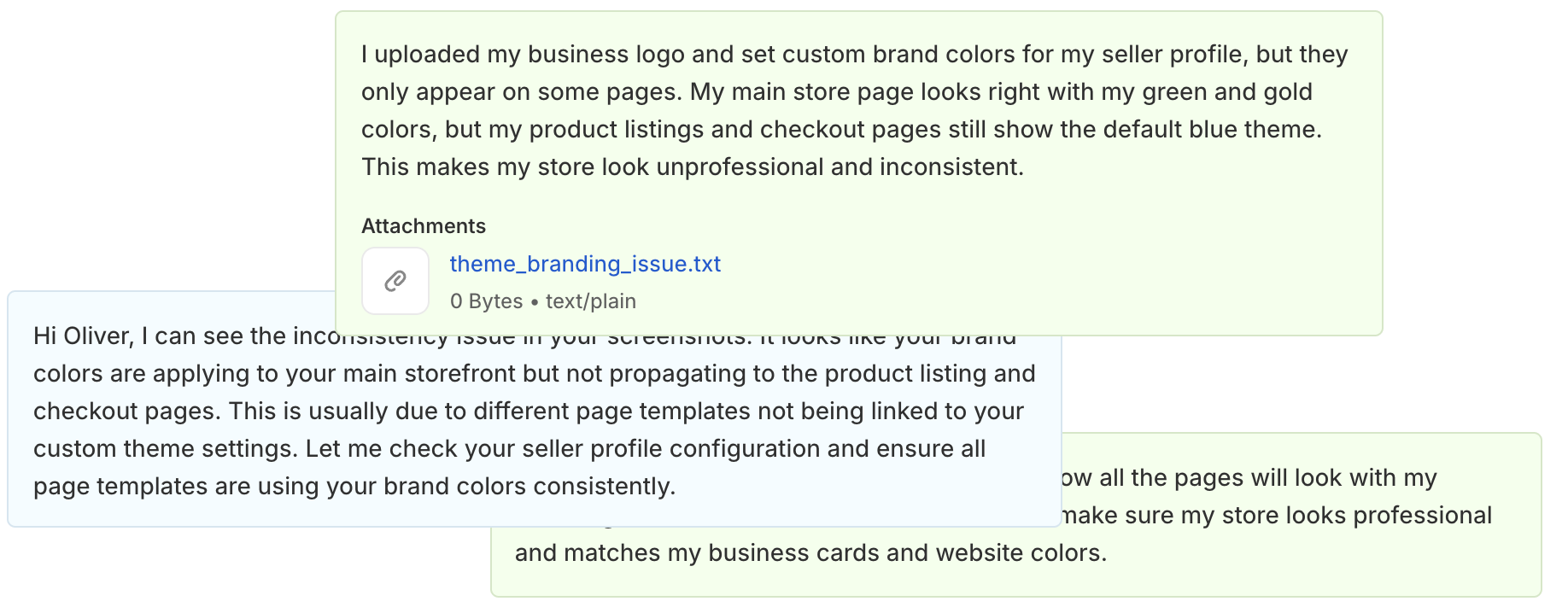

Hur det ser ut i ett riktigt team

I vardagen granskar assistenten hela ärendehistoriken, kontrollerar dokumentationen och tar fram en kort sammanfattning plus ett svarsförslag. En människa granskar, justerar för nyanser och skickar det slutgiltiga svaret. Om utkastet missar målet ber agenten om en mer precis version och itererar tills svaret är korrekt och användbart.

Poängen är inte att AI aldrig gör fel. Poängen är att felen fångas innan de blir löften till kunder, samtidigt som ert team sparar tid på läsning och första utkast.

Så förhindrar du AI-hallucinationer innan de når kunder

Inom support kan en påhittad detalj bli ett löfte som kunden håller er till. Målet är enkelt: hindra opålitliga svar från att nå kunder, särskilt när en förfrågan rör återbetalningar, leveranslöften eller policyundantag.

1. Svarspolicy (ett måste)

Börja med ett kort regelverk som assistenten följer varje gång:

- Vad den får göra (ta fram utkast, sammanfatta, ställa förtydligande frågor, citera godkända källor)

- Vad den aldrig får göra (hitta på steg, gissa policyer, lova utfall den inte kan verifiera)

- När den måste eskalera (pengar, juridiska åtaganden, undantag, låg konfidensgrad)

2. Skyddsmekanismer som faktiskt fungerar

Skyddsmekanismer hjälper bara när de matchar verkliga arbetsflöden. Det är här AI i kundservice blir pålitligt:

- Förankring i godkända källor (kunskapsbas, policysidor, orderdata, spårning)

- Konfidenströsklar (under tröskeln, inget autosvar)

- Riskflaggor som tvingar kontroll (pengar, leveranslöften, juridiskt språk)

3. Enkel QA-checklista mot hallucinationer

Innan du utökar automatiseringen till en ny ärendetyp, kontrollera de vanligaste avvikelseutlösarna:

- Luckor i kunskapsbasen (inget pålitligt att förankra i)

- Motstridiga policyer (regler som inte stämmer överens eller "undantag" som inte är dokumenterade)

- Specialfall (delleveranser, restordrar, paket, engångsundantag)

Om du behandlar hallucinationer som ett arbetsflödesproblem istället för ett modellproblem löser du dem snabbare och med långt färre kundpåverkande misstag.

Hur AI överför kontext till människor

Förr eller senare behöver ett ärende en människa. En smidig överlämning känns som att samma konversation fortsätter, inte som en omstart.

Förtroendet brister när kunder tvingas upprepa sig, detaljer försvinner mellan system eller nästa agent motsäger det assistenten sa tidigare. I samma ögonblick som en kund tror att assistenten lovade något löser ni inte längre ett ärende – ni reparerar trovärdighet.

För att undvika det bör varje överlämning innehålla ett litet, konsekvent kontextpaket. Det är detta som förvandlar konversations-AI till en verklig arbetsflödesuppgradering istället för ett extra lager i mitten:

- Avsikt + konfidensgrad (vad kunden försöker göra och hur säkert systemet är)

- Extraherade fält (ordernummer, e-post, produkt, datum, leveransstatus, anledning)

- AI-sammanfattning (kort resumé av vad som hänt hittills)

- Använda källor (vilka policyer eller KB-sidor som refererades)

- Riskflaggor (pengar, leveransåtaganden, juridik, policyundantag)

För att bevara förtroendet spelar själva överlämningsmeddelandet roll. Vid eskalering, signalera kontinuitet och undvik formuleringar som låter som en omstart. En enkel mening som denna brukar fungera bra: "Vår specialist har redan alla uppgifter och fortsätter härifrån." Om du behöver att kunden lämnar ytterligare information, var specifik om vad som saknas och varför, så att det känns som framsteg, inte friktion.

Automatisering av kundservice: nyckeltal att följa

Det är lätt att bli entusiastisk över antalet hanterade ärenden och missa det som verkligen spelar roll: fick kunden rätt utfall, med rätt grad av säkerhet?

Dessa nyckeltal visar om ni förbättrar kvalitet och förtroende, inte bara flyttar konversationer ur kön:

- CSAT efter AI-interaktioner: Mät kundnöjdhet specifikt för AI-assisterade ärenden, inte bara ert övergripande CSAT.

- Eskaleringsorsaker: Tagga varför ett ärende överlämnades (saknade data, policyundantag, låg konfidensgrad, pengarelaterad förfrågan) så att ni vet vad som behöver åtgärdas härnäst.

- Blockerade AI-beslut: Spåra när skyddsmekanismer stoppar ett osäkert svar eller en osäker åtgärd, och granska sedan de vanligaste utlösarna för att förfina regler och källor.

- Lösningstid efter överlämning: Mät om kontextpaketet hjälper agenter att avsluta snabbare utan att kunder behöver upprepa sig.

- Sparad agenttid: Uppskatta tidsbesparing på att läsa långa trådar, söka i policyer och ta fram första utkast.

Fåfängamått kan fortfarande vara till hjälp, men bara tillsammans med kvalitetssignaler:

- Avledning utan CSAT: Färre ärenden betyder ingenting om kunder lämnar frustrerade eller osäkra.

- Snabbhet utan korrekthet: Snabba svar som utlöser uppföljningar, återbetalningar eller policykonflikter är negativa framsteg.

Om dessa rör sig åt rätt håll tillsammans bygger ni ett system som förblir korrekt under press och eskalerar säkert när det behövs.

AI-supportplan: en realistisk 30-dagars utrullning

Ni behöver inte ett perfekt system dag ett. Ni behöver en säker sekvens som börjar med kontroll, bevisar pålitlighet och först därefter utökar autonomin.

Vecka 1: Policyer + kunskapsbas som grund

- Fokus: Svarspolicy, högriskärenden, rensade och godkända källor.

- Villkor: Policy godkänd och källförteckning slutförd.

Vecka 2: Enbart AI-analys (inga autosvar)

- Fokus: Avsikt + extraherade fält + utkast med resonemang, konfidensgrad och riskflaggor. Människor skickar alla svar. Logga avvikelser.

- Villkor: En målsatt andel utkast är användbara med mindre redigeringar (ofta ~60–70 % som tidigt mål).

Vecka 3: Säkra ärendetyper + kontrollerad överlämning

- Fokus: Autosvar enbart för lågriskärenden. Medel-/högriskärenden dirigeras till människor med kontextpaket. Kritiska ärenden blockeras med alternativt flöde.

- Villkor: CSAT är stabilt på autosvar för lågriskärenden och eskaleringsorsaker är tydliga.

Vecka 4: Copilot + optimering av ärendefördelning

- Fokus: Copilot i agentens arbetsyta, dirigering finjusterad utifrån loggar, säkra ärendetyper utökade en kategori i taget.

- Villkor: Nyckeltalen är stabila (CSAT oförändrat, lösningstiden förbättras, blockerade beslut minskar, agenter rapporterar tidsbesparingar).

Om ni missar ett villkor, driv inte vidare. Åtgärda policy, källor eller dirigering först, och utöka sedan igen.

Slutsats

Vid det här laget är mönstret tydligt. De flesta inbyggda assistenter misslyckas inte för att de inte kan skriva ett bra svar, utan för att arbetsflödet låter dem binda sig till utfall utan tillräcklig kontroll. Med en AI-strategi för kundsupport håller ni assistenten fokuserad på research och utkast, och verifierar allt som innebär risk innan det når kunden.

Vill du ta ett konkret nästa steg? Välj ut några lågriskintentioner, skriv en kort svarspolicy och börja mäta CSAT och eskaleringsorsaker direkt. Utöka automatiseringsgraden först när regler, datakällor och överlämningar håller under verklig belastning.

Vanliga frågor

Vilka är de bästa AI-verktygen för kundsupport 2026?

Det finns inget enskilt "bästa" verktyg för alla team, så det är bättre att jämföra funktioner som håller automatiseringen säker. Prioritera grunderna i arbetsflödet: förankring i godkända källor, konfidens- eller risksignaler och smidiga överlämningar som bevarar kontexten. Extrafunktioner som tonkontroll eller flerspråkigt stöd spelar roll först när grunderna sitter.

AI-chatbot för kundservice vs inbyggd assistent: vad är skillnaden?

En inbyggd assistent arbetar inom arbetsflödet (utkast, sammanfattningar, dirigering). En kundvänd bot kommunicerar direkt med kunder, och behöver därför striktare gränser och förutsägbar eskalering för allt som rör ordrar eller innebär risk.

Vilka nyckeltal bör följas för AI i kundservice?

Börja med kvalitetssignaler, inte volym: CSAT efter assisterade interaktioner, eskaleringsorsaker och blockerade riskbeslut. Följ sedan om överlämningarna blir snabbare och agenter lägger mindre tid på att söka och ta fram utkast.

Vilka är bästa praxis för att förhindra hallucinationer inom AI-driven kundservice?

Börja med analys och utkast, inte autosvar. Definiera förbjudna zoner (pengar, juridik, undantag), kräv verifiering för allt som innebär risk och utöka omfattningen först när resultaten är stabila på lågriskärenden.

Lär dig automatisera support med flöden, routing, segment och SLA-logik för WISMO-frågor, returer, avbeställningar och reklamationer.

En praktisk guide till att välja en kostnadsfri chatt: vad som spelar roll i gratisplaner, hur du ställer in den och när det är dags att uppgradera.

En praktisk guide till gratis kundsupport på Shopify: prismodeller, funktionsjämförelser, skalningsgränser och vad du kan använda när Inbox inte räcker till.

Börja gratis och lägg alla dina butiker, ärenden och chattar under en helpdesk som du kontrollerar.