Strategia AI per il supporto clienti: cosa automatizzare e cosa lasciare agli operatori

Una strategia AI per il supporto clienti è un framework per decidere dove l'AI può intervenire, dove deve escalare e come i team di assistenza mantengono le risposte accurate, conformi alle policy e sicure su larga scala.

La maggior parte dei team non fallisce perché la propria AI non è abbastanza intelligente. I problemi nascono quando un assistente integrato viene trattato come un sostituto sicuro del giudizio umano. Nel supporto clienti, una risposta sbagliata data con sicurezza costa cara: può generare rimborsi, violare le policy e minare silenziosamente la fiducia. Ecco perché una strategia AI per il supporto clienti conta più dell'attivazione di una nuova funzione AI.

La vera domanda è: chi prende la decisione e secondo quali regole. Questa guida mostra dove l'automazione è a basso rischio, dove serve una revisione e come mantenere risultati coerenti con il metodo Think → Verify → Act, barriere contro le allucinazioni e passaggi di consegna che preservano il contesto, così i clienti non devono ripetersi.

Cosa significa davvero "Strategia AI per il supporto clienti" nel 2026

Spesso "strategia" diventa sinonimo di "attivare e basta". Un equivoco comune è pensare di poter collegare un assistente al proprio helpdesk, puntarlo su una knowledge base e considerarlo operativo. L'estremo opposto è altrettanto sbagliato: se l'assistente può rispondere, allora dovrebbe rispondere a tutto. Entrambi gli approcci falliscono sullo stesso tipo di richieste: domande reali dei clienti che richiedono giudizio, eccezioni o sfumature nelle policy.

Una strategia AI solida per la customer experience è molto più specifica. Chiarisce dove l'assistente interviene e dove non è autorizzato a decidere. Stabilisce anche regole di qualità, affinché le risposte restino affidabili anche quando policy, prodotti e casi particolari cambiano.

Se non riesci a spiegare questi concetti base in modo semplice, non hai ancora una strategia. Hai solo una funzione attiva e la speranza che faccia tutto da sola.

AI Chatbot, assistenti AI, agenti AI, Copilot: ruoli senza confusione

Queste etichette si confondono facilmente, e così i team finiscono per dare a uno strumento più autonomia di quanta dovrebbe avere. Per fare chiarezza, la tabella seguente confronta ogni ruolo in base all'autonomia concessa e agli errori più frequenti.

| Ruolo | Autonomia consentita | Errori tipici |

|---|---|---|

| Chatbot (script/FAQ) | Risponde solo a ciò che hai scritto e approvato in anticipo. | Vicoli ciechi fuori dallo script; loop frustranti. |

| Assistente AI (AI integrata) | Integrato in Shopify o Magento come funzione AI. Riassume, prepara bozze, classifica e suggerisce i passaggi successivi. | Non coglie le sfumature specifiche dello store; bozze che ignorano i casi limite; tono incoerente senza linee guida. |

| AI chatbot (risposte generate) | Genera risposte basate sulle fonti fornite e sul contesto della conversazione. | Allucinazioni; promesse eccessive; riferimenti a policy obsolete. |

| Agente AI (azioni + workflow) | Esegue azioni su più sistemi in base a regole e approvazioni. | Azioni errate su larga scala; problemi di compliance; errori costosi senza barriere di sicurezza. |

| Copilot (per operatori) | Assiste l'operatore umano con bozze e suggerimenti; è la persona a decidere cosa inviare o fare. | Fiducia eccessiva; errori di copia-incolla; vantaggi ridotti se il contesto è scarso. |

Quando il livello di autonomia è sbagliato, gli errori crescono più velocemente della coda di supporto. Il rischio non è l'etichetta, ma la responsabilità poco chiara.

Automazione del supporto clienti: dove l'AI aiuta e dove non dovrebbe decidere

Non tutte le attività di supporto sono ugualmente automatizzabili. I risultati più sicuri vengono da workflow in cui l'assistente non può accidentalmente promettere denaro, aggirare le policy o innescare azioni irreversibili.

Una regola semplice funziona bene: automatizza ciò che è ripetitivo e verificabile, e mantieni un operatore nel processo quando la richiesta richiede giudizio, eccezioni o un impegno concreto.

Automazione ad alto valore e basso rischio

Attività in cui la velocità conta e la risposta può essere basata su fonti approvate.

- FAQ e domande base sulle policy (quando il testo delle policy è aggiornato)

- Raccolta dati (numero ordine, email, foto, motivo)

- Classificazione e smistamento (tagging per intento, priorità)

- Riepiloghi e bozze (riepilogo ticket, risposta in bozza da revisionare)

Automazione ad alto rischio (richiede controllo)

Queste richieste sembrano semplici, ma un dettaglio mancante può cambiare completamente l'esito corretto.

- Resi (casi limite di idoneità, scadenze)

- Cancellazioni (stato di evasione, controlli antifrode)

- Promesse di consegna (ordini arretrati, vincoli di magazzino)

- Compensazioni (crediti, sostituzioni, rimborsi spedizione)

Cosa non dovrebbe mai essere completamente autonomo

Se il risultato influisce su denaro, esposizione legale o eccezioni alle policy, il sistema deve prevedere un passaggio di consegna controllato.

- Denaro (rimborsi, crediti, sconti)

- Impegni legali (garanzie, dichiarazioni di conformità)

- Eccezioni alle policy (override manuali)

Matrice di rischio

Usa una semplice matrice per definire cosa può fare l'assistente in base all'intento. Mantiene il supporto clienti automatizzato coerente tra agenti, turni e periodi di picco. Leggila come percorso predefinito: risposta automatica per gli intenti a basso rischio, escalation per tutto ciò che richiede valutazione, blocco o segnalazione per i casi critici.

| Intento / attività | Livello di rischio | Automazione consentita | Fonti / policy richieste |

|---|---|---|---|

| Dov'è il mio ordine? | Basso | Risposta automatica consentita | Policy di spedizione + fonte tracking |

| Modifica indirizzo di spedizione | Medio | Passaggio di consegna | Regole modifica ordine + passaggi di verifica |

| Annulla il mio ordine | Alto | Passaggio di consegna / blocco se incerto | Policy di cancellazione + stato pagamento |

| Richiesta di rimborso | Alto | Solo passaggio di consegna | Policy di rimborso + regole di idoneità + dati ordine |

| Richiesta di sconto | Alto | Blocco + flusso alternativo | Policy sconti + regole di escalation |

| Garanzia / reclamo legale | Critico | Blocco + passaggio di consegna immediato | Policy legale + approvazione umana |

Se un intento non è ancora mappato, imposta come predefinito il passaggio di consegna, poi aggiungilo quando policy e fonti sono definite.

AI vs operatore umano: prepara la risposta, approva la decisione

Quando un assistente è integrato nel workflow di supporto, è allettante trattarlo come un operatore più veloce. Ma velocità non significa responsabilità. Una risposta generata può sembrare impeccabile ed essere sbagliata proprio dove conta: nell'impegno che assume per conto della tua azienda.

Il modello più sicuro è semplice: lascia che l'AI faccia il lavoro pesante, ma mantieni le decisioni sotto responsabilità umana. Usa l'AI generativa nel supporto clienti per analisi e bozze, non per impegni autonomi.

L'assistente può leggere il thread, estrarre i dettagli rilevanti, verificare le fonti approvate e proporre una risposta motivata. Un operatore approva poi ciò che viene inviato o smista il caso quando riguarda denaro, eccezioni alle policy o questioni legalmente sensibili. Pensalo come una bozza e un revisore. Si procede comunque più velocemente, ma con le giuste barriere di sicurezza.

Regola d'oro da condividere: l'AI prepara la risposta. Il tuo team approva la decisione.

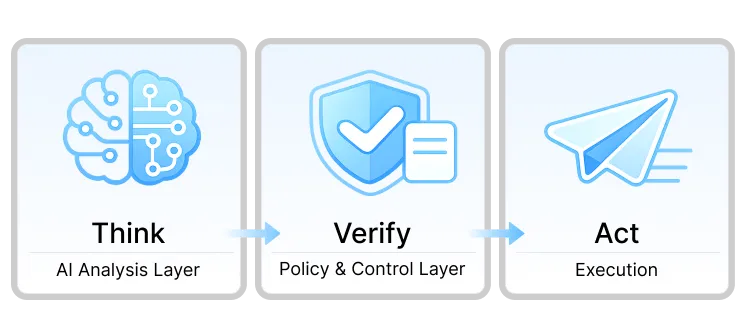

Architettura AI per il supporto clienti: Think → Verify → Act

Non serve un assistente che invii messaggi in autonomia. Serve un workflow che separi l'analisi dall'approvazione e mantenga l'esecuzione sotto controllo. In pratica, si tratta di un'implementazione AI nel servizio clienti che accelera il lavoro di routine senza trasformare i casi limite in promesse verso i clienti.

Think: livello di analisi AI

Il Think avviene dietro le quinte. L'assistente legge il messaggio e lo storico del ticket, identifica l'intento, estrae i dettagli rilevanti dalle fonti approvate e prepara una bozza con motivazione, livello di confidenza e flag di rischio. È preparazione, non una promessa, quindi non dovrebbe essere il livello che parla al cliente.

Verify: livello policy e controllo

Il Verify è il punto di controllo. La bozza viene confrontata con le regole aziendali e le fonti su cui si basa. Poi il workflow sceglie uno tra questi esiti:

- Risposta automatica sicura (intenti a basso rischio con fonti solide)

- Passaggio a un operatore (giudizio, eccezioni, contesto mancante)

- Blocco + flusso alternativo (denaro, questioni legali, richieste poco chiare)

Act: esecuzione

L'Act è l'output controllato. Un caso sicuro ottiene una risposta conforme alle policy. Tutto ciò che richiede un operatore viene smistato con il contesto chiave già confezionato, così l'operatore può proseguire senza rileggere l'intero thread. I casi bloccati seguono un percorso di fallback, come la raccolta di dettagli mancanti o l'escalation a uno specialista.

Come funziona in un team reale

Nel quotidiano, l'assistente esamina l'intero storico, verifica la documentazione e produce un breve riepilogo più una bozza di risposta. Un operatore la revisiona, aggiusta le sfumature e invia la risposta definitiva. Se la bozza non è all'altezza, l'operatore chiede un affinamento e itera fino a ottenere un risultato accurato e utilizzabile.

Il punto non è che l'AI non commetta mai errori, ma che gli errori vengano intercettati prima di diventare impegni verso i clienti, mentre il team risparmia tempo su lettura e prime bozze.

Come prevenire le allucinazioni dell'AI prima che raggiungano i clienti

Nel supporto, un dettaglio inventato può trasformarsi in una promessa che il cliente ti farà rispettare. L'obiettivo è semplice: impedire che risposte inaffidabili raggiungano i clienti, soprattutto quando la richiesta riguarda rimborsi, impegni di consegna o eccezioni alle policy.

1. Policy di risposta (indispensabile)

Parti con un breve regolamento che l'assistente segue ogni volta:

- Cosa può fare (preparare bozze, riassumere, porre domande di chiarimento, citare fonti approvate)

- Cosa non deve mai fare (inventare passaggi, interpretare le policy, promettere risultati non verificabili)

- Quando deve escalare (denaro, impegni legali, eccezioni, bassa confidenza)

2. Barriere di sicurezza che funzionano davvero

Le barriere di sicurezza funzionano solo quando rispecchiano il workflow reale. È qui che l'AI nel servizio clienti diventa affidabile:

- Ancoraggio a fonti approvate (knowledge base, pagine policy, dati ordine, tracking)

- Soglie di confidenza (sotto la soglia, nessuna risposta automatica)

- Flag di rischio che impongono il controllo (denaro, promesse di consegna, linguaggio legale)

3. Checklist QA semplice contro le allucinazioni

Prima di estendere l'automazione a un nuovo intento, verifica i trigger di deriva più comuni:

- Lacune nella knowledge base (nessuna fonte affidabile su cui basarsi)

- Policy in conflitto (regole che si contraddicono o "eccezioni" non documentate)

- Casi limite (spedizioni parziali, ordini arretrati, bundle, eccezioni una tantum)

Se tratti le allucinazioni come un problema di workflow anziché di modello, le risolverai più velocemente e con molti meno errori visibili ai clienti.

Come l'AI trasferisce il contesto agli operatori

Prima o poi, un caso richiede un operatore. Un passaggio di consegna fluido deve sembrare la continuazione della stessa conversazione, non un nuovo inizio.

La fiducia si rompe quando i clienti devono ripetersi, i dettagli si perdono tra i sistemi o l'operatore successivo contraddice quanto detto dall'assistente. Nel momento in cui il cliente pensa che l'assistente abbia promesso qualcosa, non stai più risolvendo un ticket: stai riparando la credibilità.

Per evitarlo, ogni passaggio di consegna dovrebbe includere un pacchetto di contesto compatto e coerente. È questo che trasforma l'AI conversazionale in un vero miglioramento del workflow anziché un livello aggiuntivo nel mezzo:

- Intento + confidenza (cosa il cliente sta cercando di fare e quanto il sistema ne è sicuro)

- Campi estratti (numero ordine, email, prodotto, date, stato spedizione, motivo)

- Riepilogo AI (sintesi in un paragrafo di quanto accaduto finora)

- Fonti utilizzate (quali policy o pagine KB sono state consultate)

- Flag di rischio (denaro, impegni di consegna, questioni legali, eccezioni alle policy)

Per preservare la fiducia, conta anche il messaggio stesso del passaggio di consegna. Quando fai un'escalation, segnala continuità ed evita un linguaggio che sembri ricominciare da capo. Una frase semplice come questa di solito funziona bene: "Il nostro specialista ha già tutti i dettagli e proseguirà da qui." Se hai bisogno che il cliente fornisca qualcosa, specifica cosa manca e perché, così che sembri un avanzamento, non un ostacolo.

Automazione del servizio clienti: metriche da monitorare

È facile entusiasmarsi per il numero di ticket gestiti e perdere di vista ciò che conta davvero: il cliente ha ottenuto il risultato giusto, con il giusto livello di affidabilità?

Queste metriche mostrano se stai migliorando qualità e fiducia, non se stai solo spostando conversazioni fuori dalla coda:

- CSAT dopo le interazioni AI: Monitora la soddisfazione specificamente per i thread assistiti dall'AI, non solo il CSAT complessivo.

- Motivi di escalation: Classifica il motivo per cui un caso è stato trasferito (dati mancanti, eccezione alle policy, bassa confidenza, richiesta legata al denaro) per sapere cosa migliorare.

- Decisioni AI bloccate: Monitora quando le barriere di sicurezza fermano una risposta o un'azione non sicura, poi analizza i trigger principali per affinare regole e fonti.

- Tempo di risoluzione dopo il passaggio: Misura se il pacchetto di contesto aiuta gli operatori a concludere più velocemente senza far ripetere i clienti.

- Tempo risparmiato dagli operatori: Stima il tempo ridotto nella lettura di thread lunghi, nella ricerca delle policy e nella stesura delle prime risposte.

Le metriche di vanità possono essere utili, ma solo affiancate a indicatori di qualità:

- Deflection senza CSAT: Meno ticket non significano nulla se i clienti restano frustrati o incerti.

- Velocità senza accuratezza: Risposte rapide che generano follow-up, rimborsi o conflitti con le policy sono un progresso negativo.

Se queste metriche si muovono nella giusta direzione insieme, stai costruendo un sistema che resta accurato sotto pressione e scala in sicurezza quando necessario.

Roadmap del supporto AI: un piano di lancio realistico in 30 giorni

Non ti serve un sistema perfetto dal primo giorno. Ti serve una sequenza sicura che parta dal controllo, dimostri affidabilità e solo allora espanda l'autonomia.

Settimana 1: Policy + base KB

- Focus: Policy di risposta, intenti ad alto rischio, fonti approvate pulite.

- Gate: Policy approvata e lista fonti finalizzata.

Settimana 2: solo analisi AI (nessuna risposta automatica)

- Focus: Intento + campi estratti + bozza con motivazione, confidenza e flag di rischio. Gli operatori inviano tutte le risposte. Registrazione degli errori.

- Gate: Una percentuale target delle bozze è utilizzabile con modifiche minime (spesso ~60–70% come obiettivo iniziale).

Settimana 3: intenti sicuri + passaggio di consegna controllato

- Focus: Risposte automatiche solo per intenti a basso rischio. Rischio medio/alto smistato agli operatori con pacchetto di contesto. Intenti critici bloccati con flusso alternativo.

- Gate: Il CSAT resta stabile sulle risposte automatiche a basso rischio e i motivi di escalation sono chiari.

Settimana 4: Copilot + ottimizzazione dello smistamento

- Focus: Copilot nell'area di lavoro dell'operatore, smistamento ottimizzato dai log, intenti sicuri espansi una categoria alla volta.

- Gate: Le metriche restano stabili (CSAT costante, tempo di risoluzione in miglioramento, decisioni bloccate in calo, operatori segnalano tempo risparmiato).

Se non superi un gate, non forzare il passaggio. Correggi prima policy, fonti o smistamento, poi espandi di nuovo.

Conclusione

A questo punto, lo schema è chiaro. La maggior parte degli assistenti integrati fallisce non perché non sappia scrivere una risposta decente, ma perché il workflow gli permette di impegnarsi su risultati senza sufficiente controllo. Con una strategia AI per il supporto clienti, mantieni l'assistente concentrato su ricerca e bozze, poi verifichi tutto ciò che comporta rischio prima che raggiunga il cliente.

Come primo passo concreto, scegli alcuni intenti a basso rischio, definisci una policy di risposta sintetica e inizia subito a misurare CSAT e cause di escalation. Da lì, amplia l'autonomia del sistema solo quando regole, fonti e passaggi di contesto risultano affidabili sotto volumi reali.

Domande frequenti

Quali sono i migliori strumenti AI per il supporto clienti nel 2026?

Non esiste uno strumento "migliore" per tutti i team, perciò è utile confrontare le funzionalità che rendono l'automazione sicura. Dai priorità ai fondamentali del workflow: ancoraggio a fonti approvate, segnali di confidenza o rischio e passaggi di consegna puliti che preservino il contesto. Extra come il controllo del tono o il supporto multilingue contano solo quando queste basi sono solide.

AI chatbot per il servizio clienti vs assistente integrato: qual è la differenza?

Un assistente integrato lavora all'interno del workflow (bozze, riepiloghi, smistamento). Un bot rivolto ai clienti parla direttamente con gli acquirenti, quindi necessita di limiti più rigidi e un'escalation prevedibile per tutto ciò che riguarda ordini specifici o situazioni rischiose.

Quali metriche monitorare per l'AI nel servizio clienti?

Parti dai segnali di qualità, non dal volume: CSAT dopo le interazioni assistite, motivi di escalation e decisioni rischiose bloccate. Poi osserva se i passaggi di consegna diventano più rapidi e se gli operatori dedicano meno tempo a ricerche e bozze.

Quali sono le best practice AI nel servizio clienti per prevenire le allucinazioni?

Inizia con analisi e bozze, non con risposte automatiche. Definisci le zone off-limits (denaro, questioni legali, eccezioni), richiedi la verifica per tutto ciò che è rischioso ed espandi il perimetro solo quando i risultati restano stabili sugli intenti a basso rischio.

Scopri come automatizzare il supporto con flussi, smistamento, segmenti e logica SLA per gestire WISMO, resi, annullamenti e reclami per danni.

Guida pratica alla scelta di una chat gratuita: cosa conta nei piani free, come configurarla e quando passare a un piano a pagamento.

Guida pratica al supporto clienti gratuito su Shopify: modelli di prezzo, panoramica delle funzionalità, limiti di scalabilità e cosa usare quando Inbox non basta più.

Inizia gratis e riunisci tutti i tuoi negozi, ticket e chat in un helpdesk che controlli.