Stratégie IA pour le support client : ce qu'il faut automatiser et ce qui doit rester humain

Une stratégie IA pour le support client est un cadre qui définit où l'IA peut intervenir, où elle doit escalader, et comment les équipes maintiennent des réponses précises, conformes aux politiques et sûres à grande échelle.

La plupart des équipes n'échouent pas parce que leur IA n'est pas assez performante. Les problèmes surviennent lorsqu'un assistant intégré est considéré comme un substitut fiable au jugement humain. En support client, une réponse fausse mais assurée coûte cher : elle peut déclencher des remboursements, enfreindre les règles internes et éroder silencieusement la confiance. C'est pourquoi une stratégie IA pour le support client compte bien plus que l'activation d'une énième fonctionnalité IA.

La vraie question est de savoir qui prend la décision, et selon quelles règles. Ce guide montre où l'automatisation est à faible risque, où elle nécessite une vérification, et comment garantir des résultats cohérents grâce au cadre Think → Verify → Act, des garde-fous contre les hallucinations et des transferts qui préservent le contexte pour que les clients n'aient pas à se répéter.

Ce que « stratégie IA pour le support client » signifie vraiment en 2026

Le mot « stratégie » devient souvent un raccourci pour « activer la fonctionnalité ». Une idée reçue consiste à croire qu'il suffit de connecter un assistant à votre helpdesk, de le brancher sur une base de connaissances, et le tour est joué. L'autre extrême : si l'assistant peut répondre, il devrait tout gérer. Ces deux approches échouent généralement face aux mêmes types de demandes : de vraies questions clients qui nécessitent du jugement, des exceptions ou des nuances de politique interne.

Une véritable stratégie IA pour l'expérience client est bien plus précise. Elle clarifie où l'assistant intervient et où il n'a pas le droit de trancher. Elle fixe aussi des règles de qualité, afin que les réponses restent fiables même lorsque les politiques, les produits et les cas particuliers évoluent.

Si vous ne pouvez pas expliquer ces principes de base en termes simples, vous n'avez pas encore de stratégie. Vous avez simplement activé une fonctionnalité en espérant qu'elle fasse le reste.

Chatbots IA, assistants IA, agents IA, Copilots : des rôles bien distincts

Ces termes sont souvent confondus, et c'est ainsi que les équipes accordent à un outil plus d'autonomie qu'il ne devrait en avoir. Pour clarifier les choses, le tableau ci-dessous compare chaque rôle selon l'autonomie autorisée et les erreurs les plus fréquentes.

| Rôle | Autonomie autorisée | Erreurs fréquentes |

|---|---|---|

| Chatbot (scripts/FAQ) | Répond uniquement à partir de réponses prérédigées et validées. | Impasses hors script ; boucles frustrantes. |

| Assistant IA (IA intégrée) | Intégré à Shopify ou Magento en tant que fonctionnalité IA. Résume, rédige des brouillons, classifie et suggère les étapes suivantes. | Ignore les spécificités de la boutique ; brouillons qui passent à côté des cas particuliers ; ton incohérent sans cadrage. |

| Chatbot IA (réponses générées) | Génère des réponses à partir de sources fournies et du contexte de la conversation. | Hallucinations ; promesses excessives ; références à des politiques obsolètes. |

| Agent IA (actions + workflow) | Exécute des actions dans plusieurs systèmes selon des règles et des validations. | Actions erronées à grande échelle ; problèmes de conformité ; erreurs coûteuses sans garde-fous. |

| Copilot (pour les agents) | Assiste l'agent humain avec des brouillons et des suggestions ; c'est la personne qui décide de ce qui est envoyé ou exécuté. | Confiance excessive ; erreurs de copier-coller ; gains limités si le contexte est insuffisant. |

Quand le niveau d'autonomie est mal calibré, les erreurs se multiplient plus vite que la file d'attente du support. Le risque, ce n'est pas l'étiquette, c'est le flou dans les responsabilités.

Automatisation du support client : là où l'IA aide et là où elle ne devrait pas décider

Toutes les tâches de support ne se prêtent pas aussi bien à l'automatisation. Les gains les plus sûrs proviennent de workflows où l'assistant ne peut pas accidentellement promettre de l'argent, contourner une politique ou déclencher une action irréversible.

Une règle simple fonctionne bien : automatisez ce qui est répétitif et vérifiable, et gardez un humain dans la boucle dès que la demande implique du jugement, des exceptions ou un engagement réel.

Automatisation à forte valeur ajoutée et faible risque

Ce sont des tâches où la rapidité compte et où la réponse peut s'appuyer sur des sources validées.

- FAQ et questions de politique de base (lorsque le texte est à jour)

- Collecte d'informations (numéro de commande, e-mail, photos, motif)

- Classification & routage (identification de l'intention, priorité)

- Résumés & brouillons (synthèse de ticket, réponse préliminaire à valider)

Automatisation à haut risque (contrôle nécessaire)

Ces demandes semblent simples, mais un seul détail manquant peut changer la réponse appropriée.

- Retours (cas limites d'éligibilité, délais)

- Annulations (étape d'expédition, vérifications anti-fraude)

- Promesses de livraison (commandes en attente, contraintes d'entrepôt)

- Compensations (avoirs, remplacements, remboursements de frais de port)

Ce qui ne devrait jamais être entièrement autonome

Si le résultat touche à l'argent, à une exposition juridique ou à des exceptions de politique, le système doit par défaut effectuer un transfert contrôlé.

- Argent (remboursements, avoirs, remises)

- Engagements juridiques (garanties, promesses, déclarations de conformité)

- Exceptions de politique (dérogations manuelles)

Matrice de risques

Utilisez une matrice simple pour définir ce que l'assistant peut faire selon chaque intention. Cela garantit une assistance client automatisée cohérente entre les agents, les équipes et les périodes de forte activité. Lisez-la comme un chemin par défaut : réponse automatique pour les intentions à faible risque, transfert pour tout ce qui exige un jugement humain, blocage ou escalade pour les cas critiques.

| Intention / tâche | Niveau de risque | Automatisation autorisée | Sources / politiques requises |

|---|---|---|---|

| Où est ma commande ? | Faible | Réponse automatique autorisée | Politique d'expédition + source de suivi |

| Modifier l'adresse de livraison | Moyen | Transfert | Règles de modification de commande + étapes de vérification |

| Annuler ma commande | Élevé | Transfert / blocage en cas de doute | Politique d'annulation + statut du paiement |

| Demande de remboursement | Élevé | Transfert uniquement | Politique de remboursement + règles d'éligibilité + données de commande |

| Demande de remise | Élevé | Blocage + parcours alternatif | Politique de remises + règles d'escalade |

| Réclamation garantie / juridique | Critique | Blocage + transfert immédiat | Politique juridique + validation humaine |

Si une intention n'est pas encore référencée, optez par défaut pour un transfert, puis ajoutez-la une fois que la politique et les sources sont définies.

IA vs humain dans le service client : rédiger la réponse, valider la décision

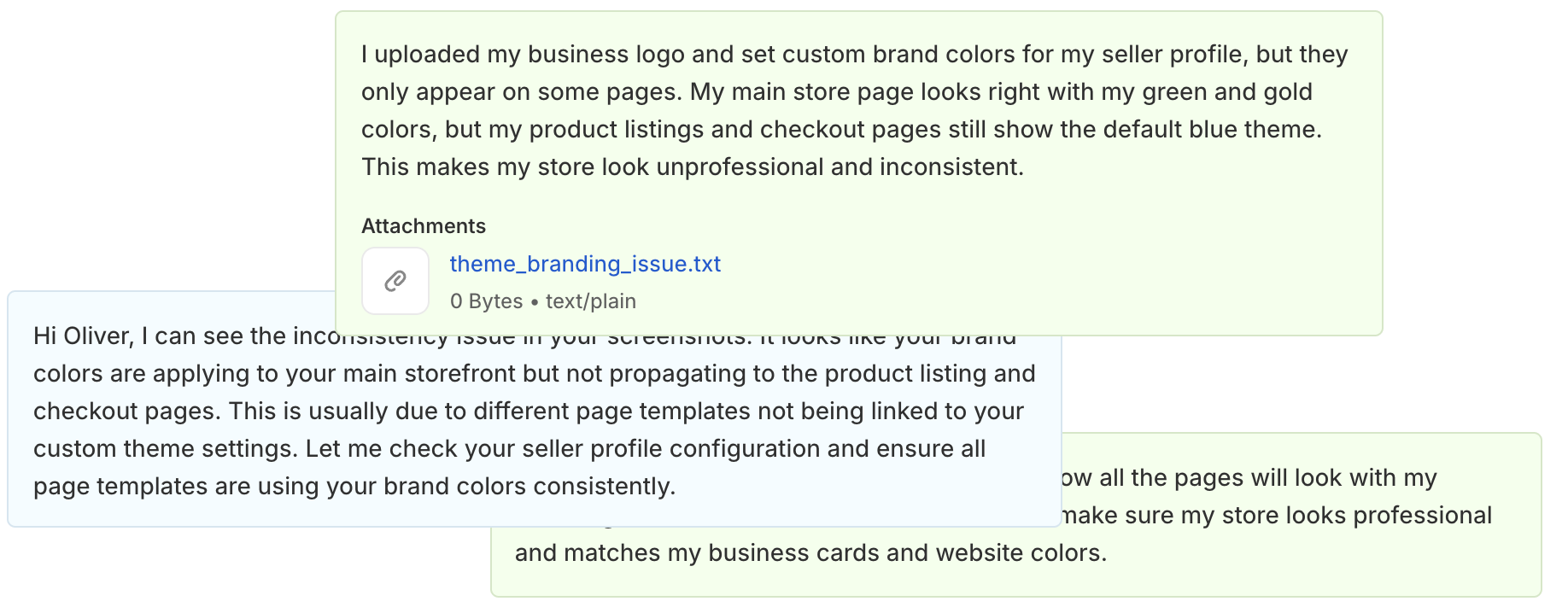

Lorsqu'un assistant est intégré à votre workflow de support, il est tentant de le traiter comme un agent plus rapide. Mais rapidité et responsabilité sont deux choses différentes. Une réponse générée peut sembler parfaite tout en étant erronée sur le point essentiel : ce à quoi elle engage votre entreprise.

Le modèle le plus sûr est simple : laissez l'IA faire le gros du travail, mais gardez le contrôle sur les décisions. Utilisez l'IA générative pour l'analyse et la rédaction, pas pour des engagements autonomes.

L'assistant peut lire le fil de discussion, extraire les détails pertinents, consulter les sources validées et proposer une réponse argumentée. Un humain approuve ensuite ce qui est envoyé ou redirige le cas lorsqu'il touche à l'argent, aux exceptions de politique ou à tout sujet juridiquement sensible. Voyez cela comme un brouillon et un relecteur. Vous allez toujours plus vite, mais avec des garde-fous.

Règle d'or à retenir : l'IA rédige la réponse, votre équipe valide la décision.

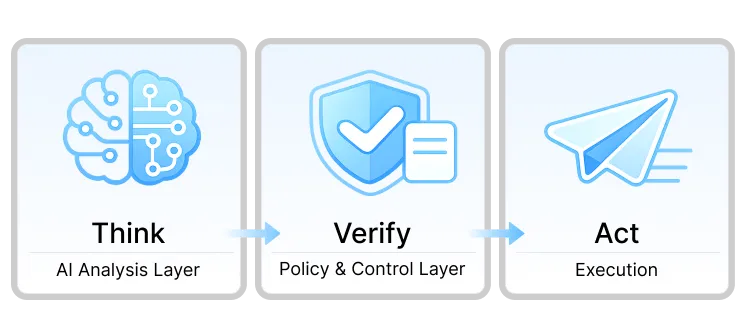

Architecture IA pour le support client : Think → Verify → Act

Vous n'avez pas besoin d'un assistant capable d'envoyer des messages de manière autonome. Vous avez besoin d'un workflow qui sépare l'analyse de la validation et garde l'exécution sous contrôle. Concrètement, c'est une implémentation IA du service client qui vous permet d'accélérer le traitement courant sans transformer les cas limites en promesses faites aux clients.

Think : couche d'analyse IA

Think se déroule en coulisses. L'assistant lit le message et l'historique du ticket, identifie l'intention, extrait les détails pertinents des sources validées et rédige une réponse avec son raisonnement, son niveau de confiance et des indicateurs de risque. C'est de la préparation, pas un engagement : ce n'est donc pas cette couche qui doit s'adresser au client.

Verify : couche de politique et de contrôle

Verify est le point de contrôle. Le brouillon est comparé à vos règles métier et aux sources sur lesquelles il s'appuie. Le workflow choisit ensuite l'un de ces résultats :

- Réponse automatique sûre (intentions à faible risque avec des sources fiables)

- Transfert vers un humain (jugement, exceptions, contexte manquant)

- Blocage + parcours alternatif (argent, juridique, demandes floues)

Act : exécution

Act est la sortie contrôlée. Un cas sûr reçoit une réponse conforme à la politique. Tout ce qui nécessite un humain est transféré avec le contexte clé déjà synthétisé, pour que l'agent puisse poursuivre sans relire tout le fil. Les cas bloqués suivent un parcours de repli : collecte des informations manquantes ou escalade vers un spécialiste.

À quoi ça ressemble dans une vraie équipe

Au quotidien, l'assistant passe en revue l'historique complet, vérifie la documentation et produit un court résumé accompagné d'un brouillon de réponse. Un humain le relit, ajuste les nuances et envoie la réponse finale. Si le brouillon est à côté, l'agent demande une version plus précise et itère jusqu'à obtenir un résultat fiable et exploitable.

L'objectif n'est pas que l'IA ne fasse jamais d'erreurs. C'est que les erreurs soient détectées avant de devenir des engagements vis-à-vis des clients, pendant que votre équipe gagne du temps sur la lecture et les premiers brouillons.

Comment empêcher les hallucinations de l'IA avant qu'elles n'atteignent les clients

En support client, un détail inventé peut devenir une promesse que le client vous demandera d'honorer. L'objectif est simple : empêcher les réponses peu fiables d'arriver jusqu'aux clients, surtout lorsqu'une demande concerne des remboursements, des engagements de livraison ou des exceptions de politique.

1. Politique de réponse (indispensable)

Commencez par un court cahier des charges que l'assistant suit systématiquement :

- Ce qu'il a le droit de faire (rédiger, résumer, poser des questions de clarification, citer des sources validées)

- Ce qu'il ne doit jamais faire (inventer des étapes, deviner la politique, promettre des résultats non vérifiables)

- Quand il doit escalader (argent, engagements juridiques, exceptions, faible niveau de confiance)

2. Des garde-fous qui fonctionnent vraiment

Les garde-fous ne sont utiles que lorsqu'ils correspondent au workflow réel. C'est là que l'IA dans le service client devient fiable :

- Ancrage sur des sources validées (base de connaissances, pages de politique, données de commande, suivi)

- Seuils de confiance (en dessous du seuil, pas de réponse automatique)

- Indicateurs de risque qui imposent un contrôle (argent, promesses de livraison, langage juridique)

3. Checklist simple de contrôle qualité des hallucinations

Avant d'étendre l'automatisation à une nouvelle intention, vérifiez les causes de dérive les plus courantes :

- Lacunes dans votre base de connaissances (aucune source fiable sur laquelle s'appuyer)

- Politiques contradictoires (règles incohérentes ou « exceptions » non documentées)

- Cas particuliers (expéditions partielles, commandes en attente, lots, exceptions ponctuelles)

Si vous traitez les hallucinations comme un problème de workflow plutôt que comme un problème de modèle, vous les corrigerez plus vite et avec beaucoup moins d'erreurs côté client.

Comment l'IA transmet le contexte aux humains

Tôt ou tard, un cas nécessite l'intervention d'une personne. Un transfert réussi donne l'impression que la conversation se poursuit, pas qu'elle recommence.

La confiance se brise quand les clients doivent se répéter, que des détails se perdent entre les systèmes ou que l'agent suivant contredit ce que l'assistant a dit précédemment. Dès qu'un client pense que l'assistant lui a fait une promesse, vous ne résolvez plus un ticket : vous réparez votre crédibilité.

Pour éviter cela, chaque transfert doit inclure un petit paquet de contexte standardisé. C'est ce qui transforme l'IA conversationnelle en une vraie amélioration du workflow plutôt qu'une couche supplémentaire inutile :

- Intention + confiance (ce que le client essaie de faire et le degré de certitude du système)

- Champs extraits (numéro de commande, e-mail, produit, dates, statut d'expédition, motif)

- Résumé IA (récapitulatif en un paragraphe de ce qui s'est passé)

- Sources utilisées (quelles politiques ou pages KB ont été consultées)

- Indicateurs de risque (argent, engagements de livraison, juridique, exception de politique)

Pour préserver la confiance, le message de transfert lui-même est important. Lors d'une escalade, signalez la continuité et évitez un langage qui donne l'impression de repartir de zéro. Une phrase simple comme celle-ci fonctionne généralement bien : « Notre spécialiste dispose déjà de tous les détails et va prendre le relais. » Si vous avez besoin que le client fournisse quelque chose, précisez ce qui manque et pourquoi, pour que cela ressemble à une avancée, pas à un obstacle.

Automatisation du service client : les indicateurs à suivre

Il est facile de se réjouir du nombre de tickets traités et de passer à côté de l'essentiel : le client a-t-il obtenu le bon résultat, avec le bon niveau de fiabilité ?

Ces indicateurs montrent si vous améliorez la qualité et la confiance, et pas seulement si vous videz la file d'attente :

- CSAT après les interactions IA : Mesurez la satisfaction spécifiquement sur les conversations assistées par l'IA, pas seulement votre CSAT global.

- Motifs d'escalade : Identifiez pourquoi un cas a été transféré (données manquantes, exception de politique, faible confiance, demande liée à l'argent) pour savoir quoi améliorer en priorité.

- Décisions IA bloquées : Suivez les cas où les garde-fous empêchent une réponse ou une action risquée, puis analysez les déclencheurs principaux pour affiner les règles et les sources.

- Temps de résolution après transfert : Mesurez si le paquet de contexte aide les agents à conclure plus vite sans que les clients aient à se répéter.

- Temps gagné par les agents : Estimez le temps économisé sur la lecture des longs fils de discussion, la recherche de politiques et la rédaction des premières réponses.

Les indicateurs de vanité peuvent avoir leur utilité, mais uniquement en complément d'indicateurs de qualité :

- Déflection sans CSAT : Moins de tickets ne signifie rien si les clients repartent frustrés ou dans l'incertitude.

- Rapidité sans exactitude : Des réponses rapides qui entraînent des relances, des remboursements ou des conflits de politique, c'est un progrès négatif.

Si ces indicateurs évoluent ensemble dans la bonne direction, vous construisez un système qui reste fiable sous pression et qui escalade en toute sécurité quand il le faut.

Feuille de route IA pour le support : un plan de déploiement réaliste en 30 jours

Vous n'avez pas besoin d'un système parfait dès le premier jour. Vous avez besoin d'une séquence sûre qui commence par le contrôle, prouve sa fiabilité, puis seulement ensuite étend l'autonomie.

Semaine 1 : Politiques + fondation de la base de connaissances

- Priorité : Politique de réponse, intentions à haut risque, sources validées et à jour.

- Jalon : Politique approuvée et liste des sources finalisée.

Semaine 2 : Analyse IA uniquement (pas de réponses automatiques)

- Priorité : Intention + champs extraits + brouillon avec raisonnement, confiance et indicateurs de risque. Les humains envoient toutes les réponses. Consignez les échecs.

- Jalon : Un pourcentage cible de brouillons est exploitable avec des modifications mineures (souvent ~60–70 % comme objectif initial).

Semaine 3 : Intentions sûres + transfert contrôlé

- Priorité : Réponses automatiques uniquement pour les intentions à faible risque. Les risques moyens/élevés sont transférés aux humains avec un paquet de contexte. Les intentions critiques sont bloquées avec un parcours alternatif.

- Jalon : Le CSAT reste stable sur les réponses automatiques à faible risque, et les motifs d'escalade sont clairs.

Semaine 4 : Copilot + optimisation du routage

- Priorité : Copilot intégré à l'espace de travail des agents, routage affiné à partir des logs, intentions sûres étendues une catégorie à la fois.

- Jalon : Les indicateurs restent stables (CSAT constant, temps de résolution en amélioration, décisions bloquées en baisse, agents signalant un gain de temps).

Si vous ne franchissez pas un jalon, n'allez pas plus loin. Corrigez d'abord la politique, les sources ou le routage, puis relancez l'expansion.

Conclusion

À ce stade, le constat est clair. La plupart des assistants intégrés n'échouent pas parce qu'ils sont incapables de rédiger une réponse correcte, mais parce que le workflow les laisse s'engager sur des résultats sans contrôle suffisant. Avec une stratégie IA pour le support client, vous gardez l'assistant concentré sur la recherche et la rédaction, puis vous vérifiez tout ce qui comporte un risque avant que cela n'atteigne le client.

Pour passer à l'action concrètement, sélectionnez quelques intentions à faible risque, rédigez une politique de réponse en une page, et commencez dès maintenant à mesurer le CSAT et les motifs d'escalade. Ensuite, n'élargissez l'autonomie que lorsque les règles, les sources et les transferts restent fiables face à un volume réel.

Questions fréquentes

Quels sont les meilleurs outils IA pour le support client en 2026 ?

Il n'existe pas un outil « idéal » pour toutes les équipes : mieux vaut comparer les fonctionnalités qui garantissent une automatisation sûre. Privilégiez les fondamentaux du workflow : ancrage sur des sources validées, signaux de confiance ou de risque, et transferts propres qui préservent le contexte. Les extras comme le contrôle du ton ou le support multilingue ne comptent qu'une fois ces bases solides.

Chatbot IA pour le service client vs assistant intégré : quelle différence ?

Un assistant intégré travaille au sein du workflow (brouillons, résumés, routage). Un chatbot en contact direct avec les clients échange avec les acheteurs, il a donc besoin de limites plus strictes et d'une escalade prévisible pour tout ce qui concerne les commandes ou les situations à risque.

Quels indicateurs suivre pour l'IA dans le service client ?

Commencez par les indicateurs de qualité, pas par le volume : CSAT après les interactions assistées, motifs d'escalade et décisions risquées bloquées. Observez ensuite si les transferts sont plus rapides et si les agents passent moins de temps à chercher et à rédiger.

Quelles sont les bonnes pratiques pour prévenir les hallucinations de l'IA dans le service client ?

Commencez par l'analyse et la rédaction, pas par les réponses automatiques. Définissez des zones interdites (argent, juridique, exceptions), exigez une vérification pour tout ce qui est risqué, et n'élargissez le périmètre que lorsque les résultats restent stables sur les intentions à faible risque.

Découvrez comment automatiser votre support grâce aux flux, au routage, aux segments et à la logique SLA pour les demandes de suivi de commande, les retours, les annulations et les réclamations pour articles endommagés.

Guide pratique pour choisir un chat gratuit : ce qui compte dans les offres gratuites, comment le configurer et quand passer à un forfait payant.

Guide pratique du support client gratuit sur Shopify : modèles tarifaires, comparatif des fonctionnalités, limites d’évolutivité et alternatives quand Inbox ne suffit plus.

Commencez gratuitement et réunissez toutes vos boutiques, tickets et chats dans un helpdesk que vous contrôlez.