AI-strategi for kundesupport: hvad du skal automatisere, og hvad der kræver mennesker

En AI-strategi for kundesupport er en ramme for at afgøre, hvor AI kan hjælpe, hvor den skal eskalere, og hvordan supportteams holder svar præcise, i overensstemmelse med retningslinjer og sikre i stor skala.

De fleste teams fejler ikke, fordi deres AI ikke er klog nok. Problemerne opstår, når en integreret assistent behandles som en sikker erstatning for menneskelig vurdering. I kundesupport er et selvsikkert forkert svar dyrt. Det kan udløse refunderinger, bryde retningslinjer og stille og roligt skade tilliden. Derfor er en AI-strategi for kundesupport vigtigere end at aktivere endnu en AI-funktion.

Det egentlige spørgsmål er, hvem der træffer beslutningen, og efter hvilke regler. Denne guide viser, hvor automatisering er lavrisiko, hvor den kræver gennemgang, og hvordan du holder resultater konsistente med Tænk → Verificér → Handl, sikkerhedsmekanismer mod hallucinationer og overdragelser, der bevarer konteksten, så kunder ikke behøver at gentage sig selv.

Hvad ”AI-strategi for kundesupport” reelt betyder i 2026

Strategi bliver ofte en forkortelse for bare at tænde det. Én misforståelse er, at du kan sætte en assistent ind i din helpdesk, pege den mod en vidensbase og kalde det færdigt. Den anden er det modsatte yderpunkt: hvis assistenten kan svare, bør den svare på alt. Begge tilgange bryder typisk sammen ved samme type forespørgsler: rigtige kundespørgsmål, der kræver vurdering, undtagelser eller nuancer i retningslinjerne.

En solid AI-strategi for kundeoplevelsen er langt mere specifik. Den tydeliggør, hvor assistenten deltager, og hvor den ikke må træffe beslutninger. Den fastsætter også kvalitetsregler, så svar forbliver velfunderede, selv når retningslinjer, produkter og grænsetilfælde ændrer sig.

Hvis du ikke kan forklare disse grundprincipper i et enkelt sprog, har du endnu ikke en strategi. Du har en funktion aktiveret og håber, den klarer resten.

AI-chatbots, AI-assistenter, AI-agenter, copilots: roller uden forvirring

Disse betegnelser blandes nemt sammen, og det er sådan, teams giver et værktøj mere autonomi, end det burde have. For at holde begreberne klare sammenligner tabellen nedenfor hver rolle efter tilladt autonomi og de fejl, teams oftest oplever.

| Rolle | Tilladt autonomi | Typiske fejl |

|---|---|---|

| Chatbot (scripts/FAQ) | Svarer kun på det, du har skrevet og godkendt på forhånd. | Blindgyder uden for scriptet; frustrerende loops. |

| AI-assistent (integreret AI) | Indbygget i Shopify eller Magento som en AI-funktion. Opsummerer, laver udkast, klassificerer og foreslår næste skridt. | Overser butiksspecifikke nuancer; udkast der ignorerer grænsetilfælde; inkonsistent tone uden vejledning. |

| AI-chatbot (genererede svar) | Genererer svar baseret på tilgængelige kilder og samtalekontekst. | Hallucinationer; overløfter; forældede retningslinjereferencer. |

| AI-agent (handlinger + workflow) | Udfører handlinger på tværs af systemer baseret på regler og godkendelser. | Forkerte handlinger i stor skala; compliance-problemer; dyre fejl uden sikkerhedsmekanismer. |

| Copilot (for agenter) | Hjælper en menneskelig agent med udkast og forslag; et menneske beslutter, hvad der sendes eller gøres. | For stor tillid; copy-paste-fejl; svage gevinster ved dårlig kontekst. |

Når autonominiveauet er forkert, skalerer fejl hurtigere end supportkøen. Risikoen er ikke betegnelsen. Det er uklar ansvarsfordeling.

Automatisering af kundesupport: hvor AI hjælper, og hvor den ikke bør beslutte

Ikke alle supportopgaver er lige nemme at automatisere. De sikreste gevinster kommer fra workflows, hvor assistenten ikke ved et uheld kan love penge, bøje retningslinjer eller udløse en irreversibel handling.

En simpel regel fungerer godt: automatisér det gentagende og verificerbare, og hold et menneske i processen, når forespørgslen kræver vurdering, undtagelser eller en reel forpligtelse.

Automatisering med høj værdi og lav risiko

Det er opgaver, hvor hastighed er vigtig, og svaret kan forankres i godkendte kilder.

- FAQ og grundlæggende spørgsmål om retningslinjer (når retningslinjerne er opdaterede)

- Dataindsamling (ordrenummer, e-mail, fotos, årsag)

- Klassificering og routing (intentmærkning, prioritering)

- Opsummeringer og udkast (sagsoversigt, svarudkast til godkendelse)

Højrisiko-automatisering (kræver kontrol)

Disse forespørgsler ser enkle ud, men én manglende detalje kan ændre det korrekte resultat.

- Returneringer (grænsetilfælde for berettigelse, deadlines)

- Annulleringer (opfyldelsesstadium, svindelkontrol)

- Leveringsløfter (restordrer, lagerbegrænsninger)

- Kompensation (kreditter, erstatninger, fragtrefunderinger)

Hvad der aldrig bør være fuldt autonomt

Hvis resultatet påvirker penge, juridisk eksponering eller undtagelser fra retningslinjer, bør systemet som standard gå til en kontrolleret overdragelse.

- Penge (refunderinger, kreditter, rabatter)

- Juridiske forpligtelser (garantier, indeståelser, compliance-erklæringer)

- Undtagelser fra retningslinjer (manuelle tilsidesættelser)

Risikomatrix

Brug en simpel matrix til at bestemme, hvad assistenten må gøre per intent. Det sikrer, at automatiseret kundesupport er ensartet på tværs af agenter, vagter og travle perioder. Læs den som en standardrute: auto-svar på lavrisikointents, overdrag det der kræver skøn, og bloker eller eskalér kritiske sager.

| Intent / opgave | Risikoniveau | Tilladt automatisering | Nødvendige kilder / retningslinjer |

|---|---|---|---|

| Hvor er min ordre? | Lav | Autosvar tilladt | Forsendelsesretningslinjer + sporingskilde |

| Ændr leveringsadresse | Mellem | Overdragelse | Regler for ordreredigering + verifikationstrin |

| Annuller min ordre | Høj | Overdragelse / blokering ved usikkerhed | Annulleringsretningslinjer + betalingsstatus |

| Refunderingsanmodning | Høj | Kun overdragelse | Refunderingsretningslinjer + berettigelsesregler + ordredata |

| Rabatanmodning | Høj | Blokering + alternativt flow | Rabatretningslinjer + eskaleringsregler |

| Garanti- / juridisk krav | Kritisk | Blokering + øjeblikkelig overdragelse | Juridiske retningslinjer + menneskelig godkendelse |

Hvis et intent endnu ikke er kortlagt, brug overdragelse som standard, og tilføj det, når retningslinjer og kilder er på plads.

AI vs menneskelig kundeservice: lav udkastet, godkend beslutningen

Når en assistent er integreret i dit support-workflow, er det fristende at behandle den som en hurtigere agent. Men hastighed er ikke det samme som ansvar. Et genereret svar kan lyde poleret og stadig tage fejl dér, hvor det virkelig betyder noget: hvad det forpligter din virksomhed til at gøre.

Den sikrere model er enkel: lad AI klare det tunge arbejde, men hold beslutninger ansvarlige. Brug generativ AI i kundesupport til analyse og udkast, ikke til selvstændige forpligtelser.

Assistenten kan læse tråden, trække relevante detaljer ud, tjekke godkendte kilder og foreslå et svar med begrundelse. Et menneske godkender derefter, hvad der sendes, eller dirigerer sagen videre, når den involverer penge, undtagelser fra retningslinjer eller noget juridisk følsomt. Tænk på det som et udkast og en redaktør. Du arbejder stadig hurtigere, men med sikkerhedsmekanismer.

Tommelfingerregel til at dele: AI bør lave udkastet. Dit team bør godkende beslutningen.

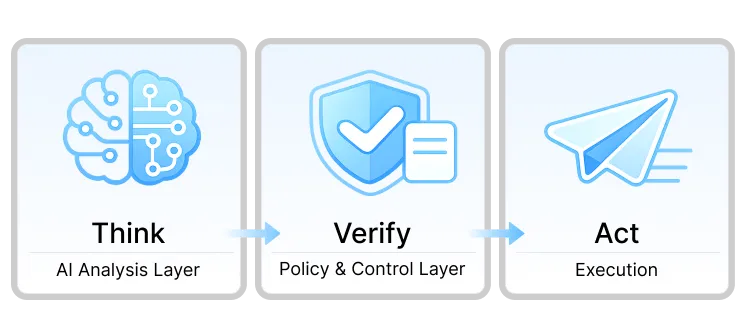

Arkitektur for AI-kundesupport: Tænk → Verificér → Handl

Du behøver ikke en assistent, der kan sende beskeder på egen hånd. Du har brug for et workflow, der adskiller analyse fra godkendelse og holder udførelsen under kontrol. I praksis er det en AI-kundeservice-implementering, der hjælper dig med at arbejde hurtigere med rutineopgaver uden at gøre grænsetilfælde til kundevendte løfter.

Tænk: AI-analyselaget

Tænk-fasen foregår bag kulisserne. Assistenten læser beskeden og ticket-historikken, identificerer intent, trækker relevante detaljer fra godkendte kilder og laver et udkast til svar med begrundelse, konfidensniveau og risikoflag. Det er forberedelse, ikke et løfte, så det bør ikke være det lag, der taler til kunden.

Verificér: retningslinje- og kontrollag

Verificér er kontrolpunktet. Udkastet sammenlignes med dine forretningsregler og de kilder, det bygger på. Derefter vælger workflowet ét resultat:

- Sikkert autosvar (lavrisiko-intents med solid kildehenvisning)

- Overdragelse til et menneske (vurdering, undtagelser, manglende kontekst)

- Blokering + alternativt flow (penge, juridisk, uklare forespørgsler)

Handl: udførelse

Handl er det kontrollerede output. En sikker sag får et svar i overensstemmelse med retningslinjer. Alt der kræver et menneske, dirigeres videre med den vigtigste kontekst allerede pakket, så agenten kan fortsætte uden at genlæse hele tråden. Blokerede sager følger en fallback-sti, som at indsamle manglende detaljer eller eskalere til en specialist.

Sådan ser det ud i et virkeligt team

I hverdagen gennemgår assistenten den fulde historik, tjekker dokumentation og producerer en kort opsummering plus et udkast til svar. Et menneske gennemgår det, justerer for nuancer og sender det endelige svar. Hvis udkastet rammer ved siden af, beder agenten om en mere præcis version og itererer, indtil det er korrekt og brugbart.

Pointen er ikke, at AI aldrig laver fejl. Det er, at fejl fanges, før de bliver kundevendte forpligtelser, mens dit team sparer tid på læsning og første udkast.

Sådan forebygger du AI-hallucinationer, før de når kunderne

I kundesupport kan en opdigtet detalje blive til et løfte, kunden holder dig fast på. Målet er enkelt: hold upålidelige svar væk fra kunderne, især når en forespørgsel berører refunderinger, leveringsløfter eller undtagelser fra retningslinjer.

1. Svarpolitik (et must)

Start med et kort regelsæt, som assistenten følger hver gang:

- Hvad den må gøre (lave udkast, opsummere, stille afklarende spørgsmål, citere godkendte kilder)

- Hvad den aldrig må gøre (opfinde trin, gætte retningslinjer, love resultater den ikke kan verificere)

- Hvornår den skal eskalere (penge, juridiske forpligtelser, undtagelser, lav konfidens)

2. Sikkerhedsmekanismer der faktisk virker

Sikkerhedsmekanismer hjælper kun, når de matcher det faktiske workflow. Det er her, AI i kundeservice bliver pålidelig:

- Forankring i godkendte kilder (vidensbase, retningslinjersider, ordredata, sporing)

- Konfidenstærskler (under tærsklen, intet autosvar)

- Risikoflag der fremtvinger kontrol (penge, leveringsløfter, juridisk sprog)

3. Simpel QA-tjekliste for hallucinationer

Før du udvider automatisering til et nyt intent, tjek de mest almindelige afvigelsesudløsere:

- Huller i din vidensbase (intet pålideligt at forankre i)

- Modstridende retningslinjer (regler der er uenige, eller ”undtagelser” der ikke er dokumenterede)

- Grænsetilfælde (delleverancer, restordrer, pakkeløsninger, engangsundtagelser)

Hvis du behandler hallucinationer som et workflow-problem i stedet for et model-problem, løser du dem hurtigere og med langt færre kundevendte fejl.

Sådan overfører AI kontekst til mennesker

Før eller siden kræver en sag et menneske. En glidende overdragelse føles som den samme samtale, der fortsætter, ikke en genstart.

Tillid brydes, når kunder gentager sig selv, detaljer går tabt mellem systemer, eller den næste agent modsiger, hvad assistenten sagde tidligere. I det øjeblik en kunde tror, assistenten lovede noget, løser du ikke længere en ticket, du reparerer troværdighed.

For at undgå det bør hver overdragelse indeholde en lille, konsistent kontekstpakke. Det er det, der gør konversationel AI til en reel workflow-opgradering i stedet for et ekstra lag i midten:

- Intent + konfidens (hvad kunden forsøger at gøre, og hvor sikker systemet er)

- Ekstraherede felter (ordrenummer, e-mail, produkt, datoer, forsendelsesstatus, årsag)

- AI-opsummering (resumé i ét afsnit af, hvad der er sket indtil videre)

- Anvendte kilder (hvilke retningslinjer eller KB-sider der blev refereret til)

- Risikoflag (penge, leveringsforpligtelser, juridisk, undtagelse fra retningslinjer)

For at bevare tillid er selve overdragelsesbeskeden vigtig. Når du eskalerer, signalér kontinuitet og undgå sprog, der lyder som at starte forfra. En simpel sætning som denne fungerer typisk godt: ”Vores specialist har allerede detaljerne og fortsætter herfra.” Hvis du har brug for, at kunden giver noget, vær specifik om, hvad der mangler og hvorfor, så det føles som fremskridt, ikke friktion.

Automatisering af kundeservice: metrics du skal følge

Det er nemt at blive begejstret over antallet af håndterede tickets og overse det, der virkelig betyder noget: fik kunden det rigtige resultat med det rette konfidensniveau?

Disse metrics viser, om du forbedrer kvalitet og tillid, og ikke bare flytter samtaler ud af køen:

- CSAT efter AI-interaktioner: Følg tilfredsheden specifikt for AI-assisterede tråde, ikke kun dit samlede CSAT.

- Eskaleringsårsager: Tag hvorfor en sag blev overdraget (manglende data, undtagelse fra retningslinjer, lav konfidens, pengerelateret forespørgsel), så du ved, hvad der skal fixes næste gang.

- Blokerede AI-beslutninger: Følg hvornår sikkerhedsmekanismer stopper et usikkert svar eller handling, og gennemgå derefter de vigtigste udløsere for at forfine regler og kilder.

- Løsningstid efter overdragelse: Mål om kontekstpakken hjælper agenter med at afslutte hurtigere, uden at kunder behøver at gentage sig selv.

- Sparet agenttid: Estimér tidsbesparelsen på at læse lange tråde, søge i retningslinjer og lave første udkast.

Vanity metrics kan stadig hjælpe, men kun sammen med kvalitetssignaler:

- Deflection uden CSAT: Færre tickets betyder intet, hvis kunder forlader dig frustrerede eller usikre.

- Hastighed uden korrekthed: Hurtige svar der udløser opfølgninger, refunderinger eller retningslinjekonflikter er negativ fremgang.

Hvis disse bevæger sig i den rigtige retning sammen, bygger du et system, der forbliver præcist under pres og eskalerer sikkert, når det skal.

AI-support-roadmap: en realistisk 30-dages udrulningsplan

Du behøver ikke et perfekt system på dag ét. Du har brug for en sikker sekvens, der starter med kontrol, beviser pålidelighed og først derefter udvider autonomi.

Uge 1: Retningslinjer + vidensbase-fundament

- Fokus: Svarpolitik, højrisiko-intents, rene godkendte kilder.

- Gate: Retningslinjer godkendt og kildeliste færdiggjort.

Uge 2: Kun AI-analyse (ingen autosvar)

- Fokus: Intent + ekstraherede felter + udkast med begrundelse, konfidens og risikoflag. Mennesker sender alle svar. Log fejl.

- Gate: En målsat andel af udkast er brugbare med mindre redigeringer (ofte ~60–70 % som tidligt mål).

Uge 3: Sikre intents + kontrolleret overdragelse

- Fokus: Autosvar kun for lavrisiko-intents. Mellem-/højrisiko dirigeres til mennesker med en kontekstpakke. Kritiske intents blokeres med et alternativt flow.

- Gate: CSAT forbliver stabilt ved lavrisiko-autosvar, og eskaleringsårsager er klare.

Uge 4: Copilot + routing-optimering

- Fokus: Copilot i agentens arbejdsområde, routing finjusteret fra logs, sikre intents udvidet én kategori ad gangen.

- Gate: Metrics forbliver stabile (CSAT stabilt, løsningstid forbedres, blokerede beslutninger falder, agenter rapporterer tidsbesparelse).

Hvis du ikke klarer en gate, så pres ikke fremad. Fix retningslinjer, kilder eller routing først, og udvid derefter igen.

Konklusion

På dette punkt er mønstret klart. De fleste integrerede assistenter fejler ikke, fordi de ikke kan skrive et ordentligt svar, men fordi workflowet lader dem forpligte sig til resultater uden tilstrækkelig kontrol. Med en AI-strategi for kundesupport holder du assistenten fokuseret på research og udkast og verificerer alt, der indebærer risiko, før det når kunden.

Vil du have et konkret næste skridt, så vælg et par lavrisikointents, skriv en kort svarpolitik og begynd straks at måle CSAT og årsager til eskalering. Udvid derefter automatiseringens råderum kun, når reglerne, kilderne og overdragelserne holder stik under reel belastning.

Ofte stillede spørgsmål

Hvad er de bedste AI-værktøjer til kundesupport i 2026?

Der er ikke ét ”bedste” værktøj for hvert team, så det hjælper at sammenligne kapabiliteter, der holder automatisering sikker. Prioritér workflow-grundprincipper: forankring i godkendte kilder, konfidens- eller risikosignaler og rene overdragelser, der bevarer kontekst. Ekstra funktioner som tonekontrol eller flersproget support har først betydning, når grundlaget er solidt.

AI-chatbot til kundeservice vs integreret assistent: hvad er forskellen?

En integreret assistent arbejder inde i workflowet (udkast, opsummeringer, routing). En kundevendt bot taler direkte til kunder, så den har brug for strammere grænser og forudsigelig eskalering for alt ordrespecifikt eller risikabelt.

Hvilke metrics skal du følge for AI i kundeservice?

Start med kvalitetssignaler, ikke volumen: CSAT efter assisterede interaktioner, eskaleringsårsager og blokerede risikable beslutninger. Følg derefter, om overdragelser bliver hurtigere, og agenter bruger mindre tid på at søge og lave udkast.

Hvad er best practices for AI i kundeservice til at forebygge hallucinationer?

Begynd med analyse og udkast, ikke autosvar. Definér no-go-zoner (penge, juridisk, undtagelser), kræv verifikation for alt risikabelt, og udvid kun omfanget, når resultater forbliver stabile på lavrisiko-intents.

Lær at automatisere kundesupport med flows, routing, segmentering og SLA-logik til ordrestatus, returneringer, annulleringer og reklamationer.

En praktisk guide til at vælge en gratis chat: hvad der betyder noget på gratisplaner, opsætning og hvornår du bør opgradere.

En praktisk guide til gratis kundesupport på Shopify: prismodeller, funktionsoversigter, skaleringsbegrænsninger, og hvad du kan bruge, når Inbox ikke længere er nok.

Start gratis og saml alle dine butikker, tickets og chats under én helpdesk, du kontrollerer.