Strategie AI zákaznické podpory: co automatizovat a co nechat na lidech

Strategie AI zákaznické podpory je rámec pro rozhodování, kde může AI pomáhat, kde musí eskalovat a jak týmy podpory udržují odpovědi přesné, v souladu s pravidly a bezpečné ve velkém měřítku.

Většina týmů neselhává kvůli tomu, že jejich AI není dost chytrá. Problémy nastanou, když se vestavěný asistent začne považovat za bezpečnou náhradu lidského úsudku. V zákaznické podpoře je sebejistá špatná odpověď drahá. Může vyvolat vrácení peněz, porušit pravidla a nenápadně poškodit důvěru. Proto je strategie AI zákaznické podpory důležitější než zapnutí další AI funkce.

Skutečná otázka zní, kdo rozhoduje a podle jakých pravidel. Tento průvodce ukazuje, kde je automatizace nízce riziková, kde potřebuje revizi a jak udržet výsledky konzistentní pomocí Promysli → Ověř → Jednej, ochranných mechanismů proti halucinacím a předání, která zachovávají kontext, aby zákazníci nemuseli opakovat svůj požadavek.

Co ve skutečnosti znamená „strategie AI zákaznické podpory“ v roce 2026

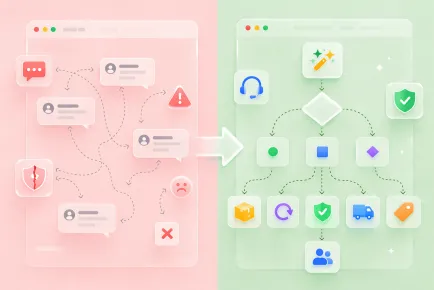

Strategie se často zredukuje na pouhé zapnutí. Jeden mýtus říká, že stačí připojit asistenta k helpdesku, nasměrovat ho na znalostní bázi a je hotovo. Druhý je opačný extrém: když asistent umí odpovědět, měl by odpovídat na všechno. Oba přístupy obvykle ztroskotají na stejném typu požadavků: skutečných otázkách zákazníků, které vyžadují úsudek, výjimky nebo znalost nuancí pravidel.

Kvalitní strategie AI zákaznické zkušenosti je mnohem konkrétnější. Jasně vymezuje, kde se asistent zapojuje a kde nesmí rozhodovat. Stanovuje také pravidla kvality, aby odpovědi zůstaly podložené, i když se mění pravidla, produkty a okrajové případy.

Pokud tyto základy nedokážete vysvětlit jednoduchým jazykem, strategii ještě nemáte. Máte zapnutou funkci a doufáte, že zbytek zvládne sama.

AI chatboti, AI asistenti, AI agenti, copiloti: role bez zmatků

Tyto pojmy se snadno zaměňují, a právě tak týmy dávají nástroji větší autonomii, než by měl mít. Pro přehlednost tabulka níže porovnává jednotlivé role podle povolené autonomie a nejčastějších selhání.

| Role | Povolená autonomie | Typická selhání |

|---|---|---|

| Chatbot (skripty/FAQ) | Odpovídá pouze na to, co předem napíšete a schválíte. | Slepé uličky mimo skript; frustrující smyčky. |

| AI asistent (vestavěná AI) | Vestavěný do Shopify nebo Magento jako AI funkce. Sumarizuje, připravuje návrhy, klasifikuje, navrhuje další kroky. | Přehlíží specifika obchodu; návrhy ignorující okrajové případy; nekonzistentní tón bez vedení. |

| AI chatbot (generované odpovědi) | Generuje odpovědi na základě poskytnutých zdrojů a kontextu konverzace. | Halucinace; nadměrné sliby; zastaralé odkazy na pravidla. |

| AI agent (akce + workflow) | Provádí akce napříč systémy na základě pravidel a schválení. | Chybné akce ve velkém měřítku; problémy s compliance; nákladné chyby bez ochranných mechanismů. |

| Copilot (pro agenty) | Pomáhá lidskému agentovi s návrhy a doporučeními; člověk rozhoduje, co se odešle nebo provede. | Přílišná důvěra; chyby z kopírování; slabé přínosy při nedostatečném kontextu. |

Když je úroveň autonomie špatná, chyby se šíří rychleji než fronta požadavků. Rizikem není název. Je to nejasná odpovědnost.

Automatizace zákaznické podpory: kde AI pomáhá a kde by neměla rozhodovat

Ne každý úkol podpory se dá stejně snadno automatizovat. Nejbezpečnější výhry přináší procesy, kde asistent nemůže omylem slíbit peníze, ohýbat pravidla nebo spustit nevratnou akci.

Funguje jednoduché pravidlo: automatizujte to, co je opakované a ověřitelné, a ponechte člověka ve hře, když požadavek vyžaduje úsudek, výjimky nebo skutečný závazek.

Automatizace s vysokou hodnotou a nízkým rizikem

Jde o úkoly, kde záleží na rychlosti a odpověď lze podložit schválenými zdroji.

- FAQ a základní dotazy na pravidla (pokud je text pravidel aktuální)

- Sběr dat (číslo objednávky, e-mail, fotografie, důvod)

- Klasifikace a směrování (tagování záměru, priorita)

- Shrnutí a koncepty (rekapitulace tiketu, koncept odpovědi k revizi)

Vysoce riziková automatizace (vyžaduje kontrolu)

Tyto požadavky vypadají jednoduše, ale jeden chybějící detail může změnit správný výsledek.

- Vrácení zboží (hraniční případy oprávněnosti, lhůty)

- Storna (stav plnění, kontroly podvodů)

- Sliby doručení (zpětné objednávky, kapacitní omezení skladu)

- Kompenzace (kredity, výměny, vrácení poštovného)

Co by nikdy nemělo být plně autonomní

Pokud výsledek ovlivňuje finance, právní rizika nebo výjimky z pravidel, systém by měl automaticky přejít na řízené předání.

- Peníze (vrácení, kredity, slevy)

- Právní závazky (záruky, garance, prohlášení o shodě)

- Výjimky z pravidel (ruční přepsání)

Matice rizik

Použijte jednoduchou matici k rozhodnutí, co smí asistent dělat u každého záměru. Udržuje automatizovanou zákaznickou podporu konzistentní napříč agenty, směnami i rušnými sezónami. Čtěte ji jako výchozí postup: automatická odpověď u nízkorizikových záměrů, předání čehokoli vyžadujícího úsudek a blokování nebo eskalace kritických případů.

| Záměr / úkol | Úroveň rizika | Povolená automatizace | Vyžadované zdroje / pravidla |

|---|---|---|---|

| Kde je moje objednávka? | Nízká | Automatická odpověď povolena | Pravidla dopravy + zdroj sledování |

| Změna doručovací adresy | Střední | Předání | Pravidla úprav objednávek + ověřovací kroky |

| Zrušení objednávky | Vysoká | Předání / blokování při nejistotě | Pravidla stornování + stav platby |

| Žádost o vrácení peněz | Vysoká | Pouze předání | Pravidla vrácení peněz + podmínky oprávněnosti + údaje objednávky |

| Žádost o slevu | Vysoká | Blokování + alternativní postup | Pravidla slev + pravidla eskalace |

| Záruční / právní reklamace | Kritická | Blokování + okamžité předání | Právní pravidla + schválení člověkem |

Pokud záměr ještě není namapován, výchozí volbou je předání. Přidejte ho, až budou pravidla a zdroje jasné.

AI vs lidská zákaznická podpora: připravte návrh odpovědi, schvalte rozhodnutí

Když je asistent vestavěný do vašeho procesu podpory, je lákavé zacházet s ním jako s rychlejším agentem. Rychlost ale není totéž co odpovědnost. Vygenerovaná odpověď může znít uhlazeně a přesto se mýlit v tom jediném, na čem záleží: k čemu váš podnik zavazuje.

Bezpečnější model je jednoduchý: nechte AI dělat těžkou práci, ale udržujte rozhodnutí pod kontrolou. Využívejte generativní AI v zákaznické podpoře pro analýzu a přípravu návrhů, ne pro samostatné závazky.

Asistent dokáže přečíst vlákno, vytáhnout relevantní informace, ověřit schválené zdroje a navrhnout odpověď s odůvodněním. Člověk pak schválí, co se odešle, nebo případ přesměruje, pokud se týká peněz, výjimek z pravidel nebo čehokoliv právně citlivého. Představte si to jako návrh a editora. Stále pracujete rychleji, ale s ochrannými mechanismy.

Pravidlo, které stojí za sdílení: AI by měla připravit návrh odpovědi. Váš tým by měl schválit rozhodnutí.

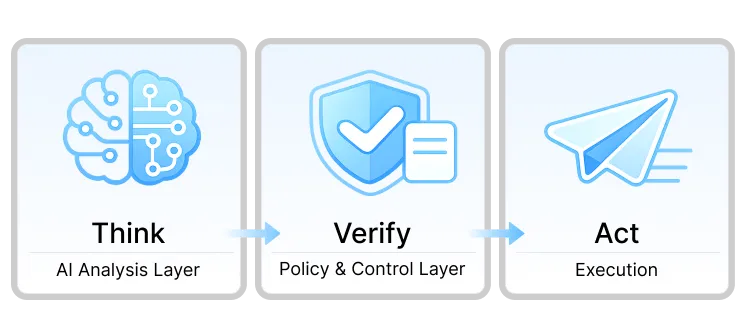

Architektura AI zákaznické podpory: Mysli → Ověř → Jednej

Nepotřebujete asistenta, který umí sám odesílat zprávy. Potřebujete proces, který odděluje analýzu od schvalování a udržuje provádění pod kontrolou. V praxi jde o implementaci AI zákaznického servisu, která vám pomůže zrychlit rutinní práci, aniž by okrajové případy proměnila v sliby směrem k zákazníkům.

Mysli: analytická vrstva AI

Fáze Mysli probíhá na pozadí. Asistent čte zprávu a historii tiketu, identifikuje záměr, vytahuje relevantní údaje ze schválených zdrojů a připravuje návrh odpovědi s odůvodněním, mírou jistoty a příznaky rizika. Je to příprava, ne slib, takže tato vrstva by neměla komunikovat se zákazníkem.

Ověř: vrstva pravidel a kontroly

Fáze Ověř je kontrolní bod. Návrh se porovná s vašimi obchodními pravidly a zdroji, na které se odkazuje. Poté proces zvolí jeden výsledek:

- Bezpečná automatická odpověď (nízkorizikové záměry s kvalitními zdroji)

- Předání člověku (úsudek, výjimky, chybějící kontext)

- Blokování + alternativní postup (peníze, právní záležitosti, nejasné požadavky)

Jednej: provedení

Fáze Jednej je řízený výstup. Bezpečný případ dostane odpověď v souladu s pravidly. Cokoliv vyžadující člověka je přesměrováno s již připraveným klíčovým kontextem, aby agent mohl pokračovat bez opětovného čtení celého vlákna. Blokované případy sledují záložní cestu, jako je shromáždění chybějících údajů nebo eskalace ke specialistovi.

Jak to vypadá ve skutečném týmu

V každodenní praxi asistent projde celou historii, zkontroluje dokumentaci a vytvoří krátký souhrn s návrhem odpovědi. Člověk ho posoudí, upraví nuance a odešle finální odpověď. Pokud návrh nesedí, agent požádá o přesnější verzi a iteruje, dokud není přesný a použitelný.

Pointou není, že AI nikdy nechybuje. Jde o to, že se chyby zachytí dříve, než se stanou závazky vůči zákazníkům, zatímco váš tým šetří čas na čtení a prvních návrzích.

Jak předejít halucinacím AI dříve, než se dostanou k zákazníkům

V zákaznické podpoře se vymyšlený detail může proměnit ve slib, na kterém vás zákazník bude trvat. Cíl je jednoduchý: zabránit nespolehlivým odpovědím, aby se dostaly k zákazníkům, zejména u požadavků týkajících se vrácení peněz, slibů doručení nebo výjimek z pravidel.

1. Pravidla odpovědí (nezbytné)

Začněte krátkým souborem pravidel, kterými se asistent řídí pokaždé:

- Co smí dělat (připravovat návrhy, sumarizovat, klást upřesňující otázky, citovat schválené zdroje)

- Co nesmí nikdy dělat (vymýšlet kroky, hádat pravidla, slibovat výsledky, které nemůže ověřit)

- Kdy musí eskalovat (peníze, právní závazky, výjimky, nízká míra jistoty)

2. Ochranné mechanismy, které skutečně fungují

Ochranné mechanismy pomáhají jen tehdy, když odpovídají reálnému procesu. Právě zde se AI v zákaznickém servisu stává spolehlivou:

- Ukotvení ve schválených zdrojích (znalostní báze, stránky pravidel, data objednávek, sledování)

- Prahové hodnoty jistoty (pod prahem žádná automatická odpověď)

- Příznaky rizika vynucující kontrolu (peníze, sliby doručení, právní formulace)

3. Jednoduchý checklist pro kontrolu halucinací

Před rozšířením automatizace na nový záměr zkontrolujte nejčastější spouštěče odchylek:

- Mezery ve znalostní bázi (nic spolehlivého, na čem lze stavět)

- Konfliktní pravidla (pravidla, která si odporují, nebo „výjimky“, které nejsou zdokumentované)

- Okrajové případy (částečné zásilky, zpětné objednávky, balíčky, jednorázové výjimky)

Pokud budete halucinace řešit jako problém procesu místo problému modelu, opravíte je rychleji a s mnohem méně chybami, které zasáhnou zákazníky.

Jak AI předává kontext lidem

Dříve či později případ vyžaduje člověka. Hladké předání působí jako pokračování stejné konverzace, ne jako nový začátek.

Důvěra se naruší, když zákazníci musí opakovat, detaily se ztratí mezi systémy nebo další agent odporuje tomu, co asistent řekl dříve. Ve chvíli, kdy zákazník nabyde dojmu, že mu asistent něco slíbil, už neřešíte tiket, ale opravujete důvěryhodnost.

Abyste se tomu vyhnuli, každé předání by mělo obsahovat malý, konzistentní kontextový balíček. Právě to promění konverzační AI ve skutečný upgrade procesu místo další vrstvy uprostřed:

- Záměr + míra jistoty (co se zákazník snaží udělat a jak si je systém jistý)

- Extrahovaná pole (číslo objednávky, e-mail, produkt, data, stav dopravy, důvod)

- AI souhrn (shrnutí dosavadního průběhu v jednom odstavci)

- Použité zdroje (na která pravidla nebo stránky znalostní báze bylo odkazováno)

- Příznaky rizika (peníze, sliby doručení, právní záležitosti, výjimky z pravidel)

Pro zachování důvěry záleží i na samotné zprávě při předání. Při eskalaci signalizujte kontinuitu a vyhněte se formulacím, které znějí jako nový začátek. Jednoduchá věta jako: „Náš specialista již má veškeré informace a bude pokračovat odtud.“ obvykle funguje dobře. Pokud potřebujete, aby zákazník něco doplnil, buďte konkrétní v tom, co chybí a proč, aby to působilo jako pokrok, ne jako překážka.

Automatizace zákaznického servisu: metriky ke sledování

Je snadné nadchnout se počtem vyřízených tiketů a přehlédnout to podstatné: dostal zákazník správný výsledek se správnou mírou jistoty?

Tyto metriky ukazují, zda zlepšujete kvalitu a důvěru, a nejen přesouváte konverzace z fronty:

- CSAT po AI interakcích: Sledujte spokojenost specificky u AI-asistovaných vláken, nejen celkové CSAT.

- Důvody eskalace: Označte, proč byl případ předán (chybějící data, výjimka z pravidel, nízká jistota, finanční požadavek), abyste věděli, co opravit jako další.

- Zablokovaná AI rozhodnutí: Sledujte, kdy ochranné mechanismy zastaví nebezpečnou odpověď nebo akci, a poté prozkoumejte hlavní spouštěče pro zpřesnění pravidel a zdrojů.

- Čas řešení po předání: Měřte, zda kontextový balíček pomáhá agentům řešit rychleji, aniž by zákazníci museli vše opakovat.

- Ušetřený čas agentů: Odhadněte úsporu času na čtení dlouhých vláken, vyhledávání pravidel a přípravu prvních odpovědí.

Ješitné metriky mohou stále pomoci, ale pouze ve spojení s ukazateli kvality:

- Odklonění bez CSAT: Méně tiketů nic neznamená, pokud zákazníci odcházejí frustrovaní nebo nejistí.

- Rychlost bez správnosti: Rychlé odpovědi, které vyvolávají follow-upy, vrácení peněz nebo konflikty pravidel, jsou negativní pokrok.

Pokud se tyto metriky pohybují správným směrem společně, budujete systém, který zůstává přesný pod tlakem a bezpečně eskaluje, když má.

Plán AI podpory: realistický 30denní plán zavedení

Nepotřebujete dokonalý systém hned první den. Potřebujete bezpečný postup, který začíná kontrolou, prokáže spolehlivost a teprve pak rozšiřuje autonomii.

Týden 1: Pravidla + základ znalostní báze

- Zaměření: Pravidla odpovědí, vysoce rizikové záměry, ověřené schválené zdroje.

- Brána: Pravidla schválena a seznam zdrojů finalizován.

Týden 2: Pouze AI analýza (žádné automatické odpovědi)

- Zaměření: Záměr + extrahovaná pole + návrh s odůvodněním, mírou jistoty a příznaky rizika. Lidé odesílají všechny odpovědi. Zaznamenávejte selhání.

- Brána: Cílový podíl návrhů je použitelný s drobnými úpravami (často ~60–70 % jako počáteční cíl).

Týden 3: Bezpečné záměry + řízené předání

- Zaměření: Automatické odpovědi pouze pro nízkorizikové záměry. Střední/vysoké riziko směrováno k lidem s kontextovým balíčkem. Kritické záměry jsou blokovány s alternativním postupem.

- Brána: CSAT zůstává stabilní u nízkorizikových automatických odpovědí a důvody eskalace jsou jasné.

Týden 4: Copilot + optimalizace směrování

- Zaměření: Copilot v pracovním prostoru agenta, směrování vyladěné z logů, bezpečné záměry rozšiřované po jedné kategorii.

- Brána: Metriky zůstávají stabilní (CSAT stabilní, čas řešení se zlepšuje, blokovaná rozhodnutí klesají, agenti hlásí úsporu času).

Pokud bránou neprojdete, netlačte dopředu. Nejprve opravte pravidla, zdroje nebo směrování a pak teprve rozšiřujte.

Závěr

V tuto chvíli je vzorec jasný. Většina vestavěných asistentů neselhává proto, že nedokáží napsat slušnou odpověď, ale proto, že jim proces umožňuje zavazovat se k výsledkům bez dostatečné kontroly. Se strategií AI zákaznické podpory udržíte asistenta zaměřeného na výzkum a návrhy a vše rizikové ověříte, než se dostane k zákazníkovi.

Pokud chcete praktický další krok, vyberte několik nízkorizikových záměrů, napište jednostránkovou politiku odpovědí a okamžitě začněte měřit CSAT a důvody eskalace. Poté rozšiřujte autonomii jen tehdy, když pravidla, zdroje a předání zůstávají spolehlivá při reálném objemu.

Často kladené dotazy

Jaké jsou nejlepší AI nástroje pro zákaznickou podporu v roce 2026?

Neexistuje jeden „nejlepší“ nástroj pro každý tým, proto je užitečné porovnávat schopnosti, které udržují automatizaci bezpečnou. Prioritizujte základy procesu: ukotvení ve schválených zdrojích, signály jistoty nebo rizika a čistá předávání zachovávající kontext. Doplňky jako kontrola tónu nebo vícejazyčná podpora mají význam až po solidních základech.

AI chatbot pro zákaznický servis vs vestavěný asistent: jaký je rozdíl?

Vestavěný asistent pracuje uvnitř procesu (návrhy, souhrny, směrování). Bot orientovaný na zákazníky komunikuje přímo s nakupujícími, takže potřebuje přísnější hranice a předvídatelnou eskalaci u čehokoliv specifického pro objednávku nebo rizikového.

Jaké metriky sledovat u AI zákaznického servisu?

Začněte ukazateli kvality, ne objemu: CSAT po asistovaných interakcích, důvody eskalace a zablokovaná riziková rozhodnutí. Poté sledujte, zda jsou předání rychlejší a agenti tráví méně času vyhledáváním a přípravou návrhů.

Jaké jsou osvědčené postupy AI zákaznického servisu pro předcházení halucinacím?

Začněte analýzou a přípravou návrhů, ne automatickými odpověďmi. Definujte zakázané zóny (peníze, právní záležitosti, výjimky), vyžadujte ověření u čehokoliv rizikového a rozšiřujte rozsah pouze tehdy, když výsledky zůstávají stabilní u nízkorizikových záměrů.

Zjistěte, jak automatizovat podporu pomocí flows, směrování, segmentace a SLA logiky pro dotazy na stav objednávek, vrácení zboží, storna a reklamace poškozených zásilek.

Praktický průvodce výběrem bezplatného chatu: na co záleží u free tarifů, jak ho nastavit a kdy přejít na placený plán.

Praktický průvodce bezplatnou zákaznickou podporou na Shopify: cenové modely, přehled funkcí, limity škálování a co dělat, když Inbox přestane stačit.

Začněte zdarma a spojte všechny své obchody, tikety a chaty do jednoho helpdesku, který řídíte.