Strategia AI w obsłudze klienta: co zautomatyzować, a co zostawić człowiekowi

Strategia AI w obsłudze klienta to zestaw zasad określających, gdzie AI może pomagać, gdzie musi eskalować, i jak zespoły wsparcia utrzymują odpowiedzi trafne, zgodne z polityką firmy i bezpieczne na dużą skalę.

Większość zespołów nie ponosi porażki dlatego, że ich AI nie jest wystarczająco inteligentne. Problemy zaczynają się, gdy wbudowany asystent traktowany jest jak bezpieczny zamiennik ludzkiej oceny sytuacji. W obsłudze klienta pewna siebie, ale błędna odpowiedź kosztuje – może wywołać zwroty, naruszyć politykę firmy i po cichu nadszarpnąć zaufanie. Dlatego strategia AI w obsłudze klienta jest ważniejsza niż włączenie kolejnej funkcji AI.

Kluczowe pytanie brzmi: kto podejmuje decyzję i na jakich zasadach. Ten przewodnik pokazuje, gdzie automatyzacja jest bezpieczna, gdzie wymaga weryfikacji i jak utrzymać spójność wyników dzięki podejściu Think → Verify → Act, zabezpieczeniom przed halucynacjami oraz przekazywaniu spraw z pełnym kontekstem, żeby klienci nie musieli powtarzać tego samego.

Co naprawdę oznacza „strategia AI w obsłudze klienta" w 2026 roku

Strategia często sprowadza się do „po prostu włącz". Jeden błąd to przekonanie, że wystarczy podłączyć asystenta do helpdesku, wskazać mu bazę wiedzy i uznać temat za zamknięty. Drugi skrajność: skoro asystent potrafi odpowiadać, niech odpowiada na wszystko. Oba podejścia zwykle sypią się na tym samym typie zgłoszeń – na prawdziwych pytaniach klientów wymagających oceny sytuacji, wyjątków lub niuansów polityki firmy.

Solidna strategia AI customer experience jest znacznie bardziej precyzyjna. Jasno określa, gdzie asystent uczestniczy, a gdzie nie wolno mu podejmować decyzji. Ustala też reguły jakości, żeby odpowiedzi pozostawały trafne w miarę zmian polityk, produktów i przypadków brzegowych.

Jeśli nie potrafisz wyjaśnić tych podstaw prostym językiem, to nie masz jeszcze strategii. Masz włączoną funkcję i nadzieję, że reszta jakoś się ułoży.

AI Chatboty, asystenci AI, agenci AI, Copilots: role bez nieporozumień

Te pojęcia łatwo pomylić, a właśnie tak zespoły dają narzędziu więcej autonomii, niż powinno mieć. Żeby zachować jasność, poniższa tabela porównuje każdą rolę pod kątem dozwolonej autonomii i najczęstszych problemów.

| Rola | Dozwolona autonomia | Typowe problemy |

|---|---|---|

| Chatbot (skrypty/FAQ) | Odpowiada tylko na to, co wcześniej napiszesz i zatwierdzisz. | Ślepe zaułki poza skryptem; frustrujące pętle. |

| Asystent AI (wbudowane AI) | Wbudowany w Shopify lub Magento jako funkcja AI. Podsumowuje, tworzy szkice, klasyfikuje, sugeruje kolejne kroki. | Pomija niuanse danego sklepu; szkice ignorujące przypadki brzegowe; niespójny ton bez odpowiednich wytycznych. |

| AI chatbot (generowane odpowiedzi) | Generuje odpowiedzi na podstawie dostarczonych źródeł i kontekstu rozmowy. | Halucynacje; składanie obietnic bez pokrycia; odwoływanie się do nieaktualnych polityk. |

| Agent AI (działania + workflow) | Wykonuje działania w różnych systemach na podstawie reguł i zatwierdzeń. | Błędne działania na dużą skalę; problemy z compliance; kosztowne pomyłki bez zabezpieczeń. |

| Copilot (dla agentów) | Wspiera agenta szkicami i sugestiami; to człowiek decyduje, co zostanie wysłane lub zrobione. | Nadmierne zaufanie; błędy kopiuj-wklej; słabe wyniki przy ubogim kontekście. |

Gdy poziom autonomii jest źle ustawiony, błędy skalują się szybciej niż kolejka zgłoszeń. Ryzyko nie tkwi w nazwie – tkwi w niejasnej odpowiedzialności.

Automatyzacja obsługi klienta: gdzie AI pomaga, a gdzie nie powinno decydować

Nie każde zadanie w obsłudze klienta da się równie łatwo zautomatyzować. Najbezpieczniejsze korzyści płyną z procesów, w których asystent nie może przypadkiem obiecać pieniędzy, nagiąć polityki ani uruchomić nieodwracalnego działania.

Prosta zasada działa świetnie: automatyzuj to, co powtarzalne i weryfikowalne, a człowieka angażuj wtedy, gdy zgłoszenie wymaga oceny, wyjątku lub realnego zobowiązania.

Automatyzacja o dużej wartości i niskim ryzyku

To zadania, w których liczy się szybkość, a odpowiedź można oprzeć na zatwierdzonych źródłach.

- FAQ i podstawowe pytania o politykę firmy (gdy tekst polityki jest aktualny)

- Zbieranie danych (numer zamówienia, e-mail, zdjęcia, powód zgłoszenia)

- Klasyfikacja i routing (tagowanie intencji, priorytety)

- Podsumowania i szkice odpowiedzi (streszczenie zgłoszenia, wersja robocza do akceptacji)

Automatyzacja wysokiego ryzyka (wymaga kontroli)

Te zgłoszenia wyglądają prosto, ale jeden brakujący szczegół może zmienić prawidłowy wynik.

- Zwroty (przypadki brzegowe kwalifikowalności, terminy)

- Anulowania (etap realizacji, weryfikacja oszustw)

- Obietnice dostawy (zamówienia oczekujące, ograniczenia magazynowe)

- Rekompensaty (kredyty, wymiana, zwrot kosztów wysyłki)

Co nigdy nie powinno być w pełni autonomiczne

Jeśli wynik wpływa na finanse, odpowiedzialność prawną lub wyjątki od polityki, system powinien domyślnie przekazywać sprawę do człowieka.

- Finanse (zwroty, kredyty, rabaty)

- Zobowiązania prawne (gwarancje, rękojmie, oświadczenia compliance)

- Wyjątki od polityki (ręczne nadpisania)

Matryca ryzyka

Prosta macierz decyzyjna pozwala określić, jakie działania asystent może podejmować dla każdej intencji. Dzięki temu automatyczna obsługa klienta działa spójnie – niezależnie od agenta, zmiany czy sezonu. Schemat jest prosty: automatyczna odpowiedź dla spraw niskiego ryzyka, przekazanie agentowi gdy potrzebna jest ocena sytuacji, blokada lub eskalacja w przypadkach krytycznych.

| Intencja / zadanie | Poziom ryzyka | Dozwolona automatyzacja | Wymagane źródła / polityki |

|---|---|---|---|

| Gdzie jest moje zamówienie? | Niski | Automatyczna odpowiedź dozwolona | Polityka wysyłki + źródło śledzenia |

| Zmiana adresu wysyłki | Średni | Przekazanie | Zasady edycji zamówienia + kroki weryfikacji |

| Anuluj moje zamówienie | Wysoki | Przekazanie / blokada w razie wątpliwości | Polityka anulacji + status płatności |

| Wniosek o zwrot | Wysoki | Tylko przekazanie | Polityka zwrotów + reguły kwalifikowalności + dane zamówienia |

| Prośba o rabat | Wysoki | Blokada + ścieżka alternatywna | Polityka rabatowa + reguły eskalacji |

| Gwarancja / roszczenie prawne | Krytyczny | Blokada + natychmiastowe przekazanie | Polityka prawna + zatwierdzenie przez człowieka |

Jeśli intencja nie jest jeszcze zmapowana, domyślnie przekazuj ją do człowieka, a dodaj ją do matrycy, gdy polityka i źródła będą jasne.

AI kontra człowiek w obsłudze klienta: AI pisze szkic, człowiek zatwierdza decyzję

Gdy asystent jest wbudowany w proces obsługi, kuszące jest traktowanie go jak szybszego agenta. Ale szybkość to nie to samo co odpowiedzialność. Wygenerowana odpowiedź może brzmieć profesjonalnie, a jednocześnie być błędna w najważniejszym punkcie: do czego zobowiązuje Twoją firmę.

Bezpieczniejszy model jest prosty: niech AI wykonuje ciężką robotę, ale decyzje niech pozostaną pod kontrolą. Wykorzystuj generatywne AI w obsłudze klienta do analizy i tworzenia szkiców, nie do samodzielnego podejmowania zobowiązań.

Asystent może przeczytać wątek, wyciągnąć istotne szczegóły, sprawdzić zatwierdzone źródła i zaproponować odpowiedź z uzasadnieniem. Człowiek zatwierdza to, co zostanie wysłane, lub przekierowuje sprawę, gdy dotyczy finansów, wyjątków od polityki lub kwestii prawnych. Traktuj to jak szkic i redaktora. Nadal działasz szybciej, ale z zabezpieczeniami.

Zasada, którą warto zapamiętać: AI pisze szkic odpowiedzi. Twój zespół zatwierdza decyzję.

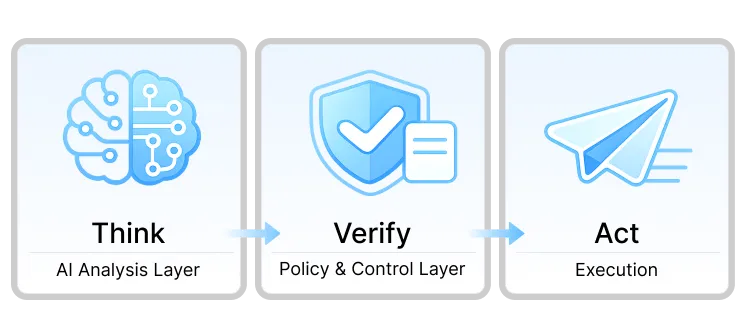

Architektura AI w obsłudze klienta: Think → Verify → Act

Nie potrzebujesz asystenta, który samodzielnie wysyła wiadomości. Potrzebujesz procesu, który oddziela analizę od zatwierdzania i utrzymuje wykonanie pod kontrolą. W praktyce to wdrożenie AI w obsłudze klienta, które przyspiesza rutynową pracę bez zamieniania przypadków brzegowych w obietnice składane klientom.

Think: warstwa analizy AI

Think dzieje się za kulisami. Asystent czyta wiadomość i historię zgłoszenia, identyfikuje intencję, wyciąga istotne szczegóły z zatwierdzonych źródeł i przygotowuje szkic odpowiedzi z uzasadnieniem, poziomem pewności i flagami ryzyka. To przygotowanie, nie obietnica – dlatego to nie ta warstwa powinna rozmawiać z klientem.

Verify: warstwa polityki i kontroli

Verify to punkt kontrolny. Szkic jest porównywany z regułami biznesowymi i źródłami, na których się opiera. Następnie workflow wybiera jeden z wyników:

- Bezpieczna automatyczna odpowiedź (intencje niskiego ryzyka z solidnym źródłem)

- Przekazanie do człowieka (ocena sytuacji, wyjątki, brakujący kontekst)

- Blokada + ścieżka alternatywna (finanse, prawo, niejasne zgłoszenia)

Act: wykonanie

Act to kontrolowane działanie. Bezpieczna sprawa otrzymuje odpowiedź zgodną z polityką. Wszystko, co wymaga człowieka, jest przekierowywane z gotowym pakietem kontekstu, żeby agent mógł kontynuować bez ponownego czytania całego wątku. Zablokowane sprawy przechodzą ścieżką awaryjną – np. zbieranie brakujących danych lub eskalacja do specjalisty.

Jak to wygląda w prawdziwym zespole

Na co dzień asystent przegląda pełną historię, sprawdza dokumentację i tworzy krótkie podsumowanie oraz szkic odpowiedzi. Człowiek go weryfikuje, dopasowuje niuanse i wysyła finalną odpowiedź. Jeśli szkic nie trafia w sedno, agent prosi o poprawkę i iteruje, aż będzie trafny i użyteczny.

Chodzi nie o to, że AI nigdy się nie myli. Chodzi o to, że błędy są wychwytywane, zanim staną się zobowiązaniami wobec klienta – a Twój zespół w tym czasie oszczędza czas na czytaniu i tworzeniu pierwszych szkiców.

Jak zapobiegać halucynacjom AI, zanim dotrą do klientów

W obsłudze klienta zmyślony szczegół może zamienić się w obietnicę, z której klient Cię rozliczy. Cel jest prosty: nie dopuścić niewiarygodnych odpowiedzi do klientów, szczególnie gdy zgłoszenie dotyczy zwrotów, obietnic dostawy lub wyjątków od polityki.

1. Polityka odpowiedzi (niezbędna)

Zacznij od krótkiego zestawu reguł, których asystent przestrzega za każdym razem:

- Co wolno mu robić (tworzyć szkice, podsumowywać, zadawać pytania doprecyzowujące, cytować zatwierdzone źródła)

- Czego nie wolno mu robić nigdy (wymyślać kroków, zgadywać politykę, obiecywać wyników, których nie może zweryfikować)

- Kiedy musi eskalować (finanse, zobowiązania prawne, wyjątki, niska pewność)

2. Zabezpieczenia, które naprawdę działają

Zabezpieczenia pomagają tylko wtedy, gdy odpowiadają rzeczywistemu workflow. To właśnie tu AI w obsłudze klienta staje się niezawodne:

- Oparcie na zatwierdzonych źródłach (baza wiedzy, strony polityk, dane zamówień, śledzenie)

- Progi pewności (poniżej progu – brak automatycznej odpowiedzi)

- Flagi ryzyka wymuszające kontrolę (finanse, obietnice dostawy, język prawny)

3. Prosta checklista QA pod kątem halucynacji

Zanim rozszerzysz automatyzację na nową intencję, sprawdź najczęstsze przyczyny odchyleń:

- Luki w bazie wiedzy (brak wiarygodnych źródeł, na których można się oprzeć)

- Sprzeczne polityki (reguły, które sobie przeczą, lub „wyjątki", które nie są udokumentowane)

- Przypadki brzegowe (częściowe wysyłki, zamówienia oczekujące, zestawy, jednorazowe wyjątki)

Jeśli potraktujesz halucynacje jako problem procesu, a nie modelu, naprawisz je szybciej i z dużo mniejszą liczbą błędów widocznych dla klientów.

Jak AI przekazuje kontekst ludziom

Prędzej czy później sprawa wymaga człowieka. Płynne przekazanie wygląda jak kontynuacja tej samej rozmowy, nie jak zaczynanie od nowa.

Zaufanie pęka, gdy klienci muszą się powtarzać, szczegóły giną między systemami lub kolejny agent zaprzecza temu, co asystent powiedział wcześniej. W momencie, gdy klient uznaje, że asystent coś obiecał, nie rozwiązujesz już zgłoszenia – naprawiasz wiarygodność.

Żeby tego uniknąć, każde przekazanie powinno zawierać mały, spójny pakiet kontekstu. To właśnie zmienia konwersacyjne AI z dodatkowej warstwy pośredniej w prawdziwe usprawnienie procesu:

- Intencja + pewność (co klient próbuje zrobić i jak pewny jest system)

- Wyodrębnione pola (numer zamówienia, e-mail, produkt, daty, status wysyłki, powód)

- Podsumowanie AI (krótkie streszczenie tego, co się wydarzyło do tej pory)

- Użyte źródła (które polityki lub strony KB były cytowane)

- Flagi ryzyka (finanse, obietnice dostawy, kwestie prawne, wyjątek od polityki)

Żeby zachować zaufanie, liczy się sama wiadomość przekazania. Przy eskalacji sygnalizuj ciągłość i unikaj języka, który brzmi jak zaczynanie od nowa. Prosty komunikat zwykle sprawdza się dobrze: „Nasz specjalista ma już wszystkie szczegóły i przejmie sprawę od tego miejsca." Jeśli potrzebujesz od klienta dodatkowych informacji, precyzyjnie powiedz, czego brakuje i dlaczego – żeby to wyglądało jak postęp, a nie przeszkoda.

Automatyzacja obsługi klienta: metryki do śledzenia

Łatwo ekscytować się liczbą obsłużonych zgłoszeń i przegapić to, co naprawdę ważne: czy klient otrzymał właściwy wynik, z odpowiednim poziomem pewności?

Te metryki pokazują, czy poprawiasz jakość i zaufanie, a nie tylko zdejmujesz rozmowy z kolejki:

- CSAT po interakcjach z AI: Śledź satysfakcję konkretnie dla wątków obsługiwanych z pomocą AI, nie tylko ogólny CSAT.

- Powody eskalacji: Taguj, dlaczego sprawa została przekazana (brak danych, wyjątek od polityki, niska pewność, zgłoszenie finansowe) – żebyś wiedział, co naprawić w następnej kolejności.

- Zablokowane decyzje AI: Śledź, kiedy zabezpieczenia zatrzymują niebezpieczną odpowiedź lub działanie, a następnie analizuj główne wyzwalacze, żeby udoskonalić reguły i źródła.

- Czas rozwiązania po przekazaniu: Mierz, czy pakiet kontekstu pomaga agentom kończyć szybciej, bez konieczności powtarzania się przez klientów.

- Oszczędność czasu agentów: Szacuj zaoszczędzony czas na czytaniu długich wątków, wyszukiwaniu polityk i tworzeniu pierwszych szkiców odpowiedzi.

Metryki próżności nadal mogą być przydatne, ale tylko w zestawieniu ze wskaźnikami jakości:

- Deflection bez CSAT: Mniej zgłoszeń nie znaczy nic, jeśli klienci odchodzą sfrustrowani lub niepewni.

- Szybkość bez trafności: Szybkie odpowiedzi, które generują dodatkowe zgłoszenia, zwroty lub konflikty z polityką, to regres, nie postęp.

Jeśli te wskaźniki idą w dobrym kierunku jednocześnie, budujesz system, który pozostaje trafny pod presją i bezpiecznie eskaluje, gdy powinien.

Plan wdrożenia AI w supportcie: realistyczny plan na 30 dni

Nie potrzebujesz idealnego systemu od pierwszego dnia. Potrzebujesz bezpiecznej sekwencji, która zaczyna od kontroli, dowodzi niezawodności, a dopiero potem rozszerza autonomię.

Tydzień 1: Polityki + fundament bazy wiedzy

- Fokus: Polityka odpowiedzi, intencje wysokiego ryzyka, uporządkowane zatwierdzone źródła.

- Bramka: Polityka zatwierdzona i lista źródeł sfinalizowana.

Tydzień 2: Tylko analiza AI (bez automatycznych odpowiedzi)

- Fokus: Intencja + wyodrębnione pola + szkic z uzasadnieniem, poziomem pewności i flagami ryzyka. Ludzie wysyłają wszystkie odpowiedzi. Loguj błędy.

- Bramka: Docelowy odsetek szkiców nadaje się do użycia z drobnymi poprawkami (często ~60–70% jako wczesny cel).

Tydzień 3: Bezpieczne intencje + kontrolowane przekazywanie

- Fokus: Automatyczne odpowiedzi tylko dla intencji niskiego ryzyka. Średnie/wysokie ryzyko kierowane do ludzi z pakietem kontekstu. Intencje krytyczne blokowane ze ścieżką alternatywną.

- Bramka: CSAT pozostaje stabilny przy automatycznych odpowiedziach niskiego ryzyka, a powody eskalacji są jasne.

Tydzień 4: Copilot + optymalizacja routingu

- Fokus: Copilot w przestrzeni roboczej agenta, routing dostrojony na podstawie logów, bezpieczne intencje rozszerzane o jedną kategorię na raz.

- Bramka: Metryki pozostają stabilne (CSAT bez zmian, czas rozwiązania się poprawia, zablokowane decyzje maleją, agenci raportują oszczędność czasu).

Jeśli nie przejdziesz bramki, nie idź dalej. Najpierw napraw politykę, źródła lub routing, a potem rozszerzaj ponownie.

Podsumowanie

W tym momencie schemat jest jasny. Większość wbudowanych asystentów nie zawodzi dlatego, że nie potrafią napisać przyzwoitej odpowiedzi, ale dlatego, że workflow pozwala im zobowiązywać się do wyników bez wystarczającej kontroli. Dzięki strategii AI w obsłudze klienta asystent koncentruje się na analizie i szkicach, a wszystko, co niesie ryzyko, jest weryfikowane przed dotarciem do klienta.

Jeśli szukasz konkretnego pierwszego kroku – wybierz kilka intencji niskiego ryzyka, opracuj jednostronicową politykę odpowiedzi i od razu zacznij mierzyć CSAT oraz powody eskalacji. Zakres automatyzacji rozszerzaj tylko wtedy, gdy reguły, źródła danych i przekazywanie spraw działają niezawodnie w realnym ruchu.

Najczęściej zadawane pytania

Jakie są najlepsze narzędzia AI do obsługi klienta w 2026 roku?

Nie ma jednego „najlepszego" narzędzia dla każdego zespołu, dlatego warto porównywać funkcje zapewniające bezpieczeństwo automatyzacji. Priorytetem powinny być fundamenty workflow: oparcie na zatwierdzonych źródłach, sygnały pewności lub ryzyka oraz czyste przekazywanie spraw z zachowaniem kontekstu. Dodatki jak kontrola tonu czy wsparcie wielojęzyczne mają znaczenie dopiero, gdy te podstawy są solidne.

AI chatbot do obsługi klienta a wbudowany asystent: jaka jest różnica?

Wbudowany asystent działa wewnątrz workflow (szkice, podsumowania, routing). Bot kontaktujący się bezpośrednio z klientami rozmawia z kupującymi, więc potrzebuje ściślejszych granic i przewidywalnej eskalacji dla wszystkiego, co dotyczy zamówień lub niesie ryzyko.

Jakie metryki śledzić dla AI w obsłudze klienta?

Zacznij od wskaźników jakości, nie wolumenu: CSAT po interakcjach z asystentem, powody eskalacji i zablokowane ryzykowne decyzje. Potem obserwuj, czy przekazywanie spraw przyspiesza, a agenci spędzają mniej czasu na wyszukiwaniu i pisaniu szkiców.

Jakie są najlepsze praktyki zapobiegania halucynacjom AI w obsłudze klienta?

Zacznij od analizy i tworzenia szkiców, nie od automatycznych odpowiedzi. Zdefiniuj strefy zakazane (finanse, prawo, wyjątki), wymagaj weryfikacji dla wszystkiego, co ryzykowne, i rozszerzaj zakres dopiero wtedy, gdy wyniki są stabilne na intencjach niskiego ryzyka.

Dowiedz się, jak zautomatyzować obsługę klienta za pomocą przepływów, routingu, segmentów i logiki SLA – dla zapytań WISMO, zwrotów, anulowań i reklamacji.

Praktyczny przewodnik po wyborze darmowego czatu: co liczy się w darmowych planach, jak go skonfigurować i kiedy przejść na płatny plan.

Praktyczny przewodnik po darmowym wsparciu klienta na Shopify: modele cenowe, przegląd funkcji, limity skalowania i co wybrać, gdy Inbox już nie wystarcza.

Rozpocznij za darmo i połącz wszystkie sklepy, zgłoszenia i czaty w jednym helpdesku.