Een AI-klantenservicestrategie is een raamwerk om te bepalen waar AI kan helpen, waar moet worden geëscaleerd en hoe supportteams antwoorden nauwkeurig, beleidsconform en veilig houden op schaal.

De meeste teams falen niet omdat hun AI niet slim genoeg is. Het gaat mis wanneer een ingebouwde assistent wordt behandeld als een veilige vervanging voor menselijk beoordelingsvermogen. Bij klantenservice is een zelfverzekerd fout antwoord kostbaar. Het kan leiden tot terugbetalingen, beleidsschendingen en ongemerkt verlies van vertrouwen. Daarom is een AI-klantenservicestrategie belangrijker dan weer een nieuwe AI-functie inschakelen.

De echte vraag is: wie neemt de beslissing, en onder welke voorwaarden? Deze gids laat zien waar automatisering weinig risico oplevert, waar menselijke controle nodig is en hoe je resultaten consistent houdt met Think → Verify → Act, beveiligingen tegen hallucinaties en overdrachten die context behouden zodat klanten zichzelf niet hoeven te herhalen.

Wat "AI-klantenservicestrategie" werkelijk betekent in 2026

Strategie wordt al snel een synoniem voor gewoon aanzetten. Een veelvoorkomend misverstand is dat je een assistent aan je helpdesk koppelt, naar een kennisbank verwijst en klaar bent. Het andere uiterste: als de assistent kan antwoorden, moet hij alles beantwoorden. Beide aanpakken lopen vast op dezelfde soort vragen: echte klantvragen die beoordelingsvermogen, uitzonderingen of beleidsnuance vereisen.

Een goede AI-klantbelevingsstrategie is veel specifieker. Die bepaalt waar de assistent mag meewerken en waar hij geen beslissingen mag nemen. Er worden ook kwaliteitsregels vastgesteld, zodat antwoorden betrouwbaar blijven wanneer beleid, producten en uitzonderingsgevallen veranderen.

Als je deze basisprincipes niet in gewone taal kunt uitleggen, heb je nog geen strategie. Dan heb je een functie aangezet en hoop je dat het vanzelf goed gaat.

AI-chatbots, AI-assistenten, AI-agents en Copilots: rollen zonder verwarring

Deze termen worden makkelijk door elkaar gehaald, en dat is hoe teams een tool meer autonomie geven dan verantwoord is. Om de begrippen helder te houden vergelijkt de onderstaande tabel elke rol op basis van toegestane autonomie en de meest voorkomende fouten.

| Rol | Toegestane autonomie | Veelvoorkomende fouten |

|---|---|---|

| Chatbot (scripts/FAQ) | Beantwoordt alleen wat je vooraf schrijft en goedkeurt. | Doodlopende paden buiten het script; frustrerende lussen. |

| AI-assistent (ingebouwde AI) | Ingebouwd in Shopify of Magento als AI-functie. Vat samen, stelt concepten op, classificeert en suggereert vervolgstappen. | Mist winkelspecifieke nuances; concepten die uitzonderingsgevallen negeren; inconsistente toon zonder sturing. |

| AI-chatbot (gegenereerde antwoorden) | Genereert antwoorden op basis van aangeleverde bronnen en gesprekscontext. | Hallucinaties; te veel beloven; verwijzingen naar verouderd beleid. |

| AI-agent (acties + workflow) | Voert acties uit in verschillende systemen op basis van regels en goedkeuringen. | Verkeerde acties op schaal; complianceproblemen; kostbare fouten zonder beveiligingen. |

| Copilot (voor medewerkers) | Ondersteunt een menselijke medewerker met concepten en suggesties; een persoon beslist wat er wordt verstuurd of gedaan. | Te veel vertrouwen; kopieerfouten; beperkte winst bij slechte context. |

Als het autonomieniveau verkeerd is ingesteld, schalen fouten sneller dan de wachtrij. Het risico zit niet in het label, maar in onduidelijke verantwoordelijkheid.

Automatisering van klantenservice: waar AI helpt en waar het niet mag beslissen

Niet elke supporttaak is even goed te automatiseren. De veiligste winst komt uit workflows waar de assistent niet per ongeluk geld kan beloven, beleid kan omzeilen of een onomkeerbare actie kan uitvoeren.

Een eenvoudige regel werkt goed: automatiseer wat repetitief en verifieerbaar is, en houd een mens in de loop wanneer het verzoek beoordelingsvermogen, uitzonderingen of een echte toezegging vereist.

Waardevolle automatisering met laag risico

Dit zijn taken waarbij snelheid belangrijk is en het antwoord gebaseerd kan worden op goedgekeurde bronnen.

- FAQ en standaard beleidsvragen (wanneer de beleidstekst actueel is)

- Gegevensverzameling (ordernummer, e-mail, foto's, reden)

- Classificatie en routing (intentherkenning, prioriteit)

- Samenvattingen en concepten (ticketoverzicht, conceptantwoord ter beoordeling)

Automatisering met hoog risico (vereist controle)

Deze verzoeken lijken eenvoudig, maar één ontbrekend detail kan de juiste uitkomst veranderen.

- Retouren (grensgevallen bij geschiktheid, deadlines)

- Annuleringen (verwerkingsfase, fraudecontroles)

- Leveringsbeloftes (nabestellingen, magazijnbeperkingen)

- Compensatie (tegoeden, vervangingen, verzendkostenrestituties)

Wat nooit volledig autonoom mag zijn

Als de uitkomst invloed heeft op geld, juridische aansprakelijkheid of beleidsuitzonderingen, moet het systeem standaard een gecontroleerde overdracht starten.

- Geld (restituties, tegoeden, kortingen)

- Juridische toezeggingen (garanties, waarborgen, complianceverklaringen)

- Beleidsuitzonderingen (handmatige overschrijvingen)

Risicomatrix

Gebruik een eenvoudige matrix om te bepalen wat de assistent per intent mag doen. Zo blijft geautomatiseerde klantenservice consistent over medewerkers, diensten en drukke periodes heen. Lees het als een standaardpad: automatisch antwoorden bij intents met laag risico, alles overdragen wat beoordelingsvermogen vereist en kritieke gevallen blokkeren of escaleren.

| Intent / taak | Risiconiveau | Toegestane automatisering | Vereiste bronnen / beleid |

|---|---|---|---|

| Waar is mijn bestelling? | Laag | Automatisch antwoord toegestaan | Verzendbeleid + trackingbron |

| Verzendadres wijzigen | Gemiddeld | Overdracht | Regels voor orderwijzigingen + verificatiestappen |

| Mijn bestelling annuleren | Hoog | Overdracht / blokkeren bij onzekerheid | Annuleringsbeleid + betalingsstatus |

| Restitutieverzoek | Hoog | Alleen overdracht | Restitutiebeleid + geschiktheidsregels + ordergegevens |

| Kortingsverzoek | Hoog | Blokkeren + alternatief pad | Kortingsbeleid + escalatieregels |

| Garantie / juridische claim | Kritiek | Blokkeren + directe overdracht | Juridisch beleid + menselijke goedkeuring |

Als een intent nog niet in kaart is gebracht, kies dan standaard voor een overdracht en voeg het toe zodra het beleid en de bronnen duidelijk zijn.

AI versus menselijke klantenservice: stel het antwoord op, keur de beslissing goed

Wanneer een assistent is ingebouwd in je supportworkflow, is het verleidelijk om hem als een snellere medewerker te behandelen. Maar snelheid is niet hetzelfde als verantwoordelijkheid. Een gegenereerd antwoord kan gepolijst klinken en toch fout zijn op het punt dat ertoe doet: wat het je bedrijf verplicht om te doen.

Het veiligere model is eenvoudig: laat AI het zware werk doen, maar houd beslissingen controleerbaar. Gebruik generatieve AI-klantenservice voor analyse en het opstellen van concepten, niet voor zelfstandige toezeggingen.

De assistent kan de thread lezen, relevante details ophalen, goedgekeurde bronnen raadplegen en een antwoord voorstellen met onderbouwing. Een mens keurt vervolgens goed wat wordt verstuurd of stuurt de zaak door wanneer het gaat om geld, beleidsuitzonderingen of juridisch gevoelige zaken. Zie het als een concept en een redacteur. Je werkt nog steeds sneller, maar met beveiligingen.

Vuistregel om te delen: AI stelt het antwoord op. Je team keurt de beslissing goed.

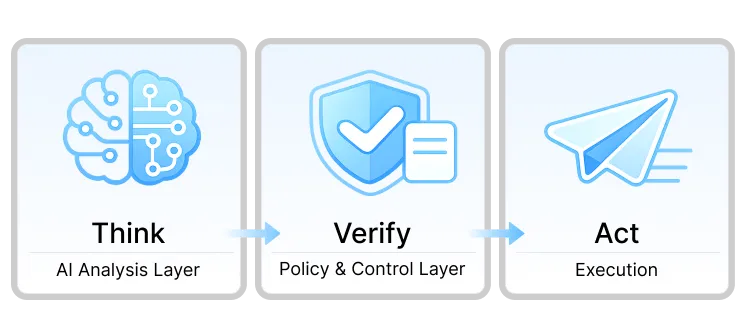

AI-klantenservicearchitectuur: Think → Verify → Act

Je hebt geen assistent nodig die zelfstandig berichten kan versturen. Je hebt een workflow nodig die analyse scheidt van goedkeuring en de uitvoering onder controle houdt. In de praktijk is dit een AI-klantenservice-implementatie die je helpt sneller te werken bij routinetaken zonder dat uitzonderingsgevallen veranderen in beloftes aan klanten.

Think: AI-analyselaag

Think vindt plaats achter de schermen. De assistent leest het bericht en de ticketgeschiedenis, herkent de intent, haalt relevante details op uit goedgekeurde bronnen en stelt een antwoord op met onderbouwing, betrouwbaarheidsscore en risicovlaggen. Het is voorbereiding, geen belofte, dus dit mag niet de laag zijn die met de klant communiceert.

Verify: beleids- en controlelaag

Verify is het controlepunt. Het concept wordt vergeleken met je bedrijfsregels en de bronnen waarop het gebaseerd is. Vervolgens kiest de workflow één uitkomst:

- Veilig automatisch antwoord (intents met laag risico en solide bronvermelding)

- Overdracht aan een mens (beoordelingsvermogen, uitzonderingen, ontbrekende context)

- Blokkeren + alternatief pad (geld, juridisch, onduidelijke verzoeken)

Act: uitvoering

Act is de gecontroleerde output. Een veilige zaak krijgt een beleidsconform antwoord. Alles wat een mens nodig heeft wordt doorgestuurd met de belangrijkste context al gebundeld, zodat de medewerker verder kan zonder de hele thread opnieuw te lezen. Geblokkeerde zaken volgen een terugvalpad, zoals het verzamelen van ontbrekende gegevens of escalatie naar een specialist.

Hoe dit eruitziet in een echt team

In de dagelijkse praktijk bekijkt de assistent de volledige geschiedenis, controleert de documentatie en levert een korte samenvatting plus een conceptantwoord. Een mens beoordeelt het, past nuances aan en verstuurt het definitieve antwoord. Als het concept niet goed genoeg is, vraagt de medewerker om een betere versie en itereert tot het nauwkeurig en bruikbaar is.

Het punt is niet dat AI nooit fouten maakt. Het punt is dat fouten worden onderschept voordat ze beloftes aan klanten worden, terwijl je team tijd bespaart op het lezen en opstellen van eerste concepten.

Hoe voorkom je AI-hallucinaties voordat ze klanten bereiken?

Bij klantenservice kan een verzonnen detail veranderen in een belofte waar de klant je aan houdt. Het doel is eenvoudig: houd onbetrouwbare antwoorden weg bij klanten, vooral wanneer een verzoek gaat over restituties, leveringsbeloftes of beleidsuitzonderingen.

1. Antwoordbeleid (essentieel)

Begin met een kort regelboek dat de assistent altijd volgt:

- Wat het mag doen (concepten opstellen, samenvatten, verduidelijkende vragen stellen, goedgekeurde bronnen citeren)

- Wat het nooit mag doen (stappen verzinnen, beleid raden, uitkomsten beloven die het niet kan verifiëren)

- Wanneer het moet escaleren (geld, juridische toezeggingen, uitzonderingen, lage betrouwbaarheid)

2. Beveiligingen die echt werken

Beveiligingen helpen alleen wanneer ze aansluiten bij de echte workflow. Dit is waar AI in klantenservice betrouwbaar wordt:

- Verankering in goedgekeurde bronnen (kennisbank, beleidspagina's, ordergegevens, tracking)

- Betrouwbaarheidsdrempels (onder de drempel geen automatisch antwoord)

- Risicovlaggen die controle afdwingen (geld, leveringsbeloftes, juridisch taalgebruik)

3. Eenvoudige QA-checklist voor hallucinaties

Voordat je automatisering uitbreidt naar een nieuwe intent, controleer de meest voorkomende afwijkingstriggers:

- Hiaten in je kennisbank (niets betrouwbaars om op te baseren)

- Tegenstrijdig beleid (regels die elkaar tegenspreken of "uitzonderingen" die niet gedocumenteerd zijn)

- Grensgevallen (deelzendingen, nabestellingen, bundels, eenmalige uitzonderingen)

Als je hallucinaties behandelt als een workflowprobleem in plaats van een modelprobleem, los je ze sneller op en met veel minder fouten richting klanten.

Hoe AI context overdraagt aan mensen

Vroeg of laat heeft een zaak een mens nodig. Een soepele overdracht voelt als een voortzetting van hetzelfde gesprek, niet als een herstart.

Vertrouwen breekt wanneer klanten zichzelf moeten herhalen, details verloren gaan tussen systemen of de volgende medewerker tegenspreekt wat de assistent eerder zei. Zodra een klant denkt dat de assistent iets heeft beloofd, los je geen ticket meer op maar herstel je geloofwaardigheid.

Om dat te voorkomen moet elke overdracht een compact, consistent contextpakket bevatten. Dit is wat conversational AI verandert in een echte workflowverbetering in plaats van een extra laag ertussen:

- Intent + betrouwbaarheid (wat de klant probeert te doen en hoe zeker het systeem is)

- Verzamelde velden (ordernummer, e-mail, product, datums, verzendstatus, reden)

- AI-samenvatting (beknopt overzicht van wat er tot nu toe is gebeurd)

- Gebruikte bronnen (welk beleid of welke KB-pagina's zijn geraadpleegd)

- Risicovlaggen (geld, leveringstoezeggingen, juridisch, beleidsuitzondering)

Om vertrouwen te behouden is het overdrachtsbericht zelf belangrijk. Wanneer je escaleert, geef dan continuïteit aan en vermijd taal die klinkt als opnieuw beginnen. Een eenvoudige zin als deze werkt meestal goed: "Onze specialist heeft alle gegevens al en gaat hier verder." Als je iets van de klant nodig hebt, wees dan specifiek over wat er ontbreekt en waarom, zodat het aanvoelt als vooruitgang in plaats van frictie.

Automatisering van klantenservice: welke metrics je moet bijhouden

Het is verleidelijk om enthousiast te worden over het aantal afgehandelde tickets en te missen wat er echt toe doet: heeft de klant de juiste uitkomst gekregen, met het juiste niveau van betrouwbaarheid?

Deze metrics laten zien of je kwaliteit en vertrouwen verbetert, en niet alleen gesprekken uit de wachtrij haalt:

- CSAT na AI-interacties: Meet tevredenheid specifiek voor AI-ondersteunde gesprekken, niet alleen je algehele CSAT.

- Escalatieredenen: Tag waarom een zaak is overgedragen (ontbrekende gegevens, beleidsuitzondering, lage betrouwbaarheid, geldgerelateerd verzoek) zodat je weet wat je als volgende moet verbeteren.

- Geblokkeerde AI-beslissingen: Houd bij wanneer beveiligingen een onveilig antwoord of actie tegenhouden en beoordeel de belangrijkste triggers om regels en bronnen te verfijnen.

- Oplostijd na overdracht: Meet of het contextpakket medewerkers helpt sneller af te ronden zonder dat klanten zichzelf moeten herhalen.

- Bespaarde tijd voor medewerkers: Schat de tijdsbesparing in bij het lezen van lange threads, het zoeken in beleidsdocumenten en het opstellen van eerste antwoorden.

Ijdelheidsmetrics kunnen nog steeds nuttig zijn, maar alleen naast kwaliteitssignalen:

- Afbuiging zonder CSAT: Minder tickets betekent niets als klanten gefrustreerd of onzeker achterblijven.

- Snelheid zonder juistheid: Snelle antwoorden die vervolgvragen, restituties of beleidsconflicten veroorzaken zijn negatieve vooruitgang.

Als deze metrics samen de goede kant op bewegen, bouw je een systeem dat nauwkeurig blijft onder druk en veilig escaleert wanneer dat nodig is.

AI-supportroadmap: een realistisch 30-dagenplan

Je hebt geen perfect systeem nodig op dag één. Je hebt een veilige volgorde nodig die begint met controle, betrouwbaarheid bewijst en pas dan de autonomie uitbreidt.

Week 1: Beleid + KB-fundament

- Focus: Antwoordbeleid, intents met hoog risico, opgeschoonde goedgekeurde bronnen.

- Gate: Beleid goedgekeurd en bronnenlijst afgerond.

Week 2: Alleen AI-analyse (geen automatische antwoorden)

- Focus: Intent + verzamelde velden + concept met onderbouwing, betrouwbaarheidsscore en risicovlaggen. Mensen versturen alle antwoorden. Log fouten.

- Gate: Een doelpercentage van de concepten is bruikbaar met kleine aanpassingen (vaak ~60–70% als vroeg doel).

Week 3: Veilige intents + gecontroleerde overdracht

- Focus: Automatische antwoorden alleen voor intents met laag risico. Gemiddeld/hoog risico wordt doorgestuurd naar mensen met een contextpakket. Kritieke intents worden geblokkeerd met een alternatief pad.

- Gate: CSAT blijft stabiel bij automatische antwoorden met laag risico en escalatieredenen zijn duidelijk.

Week 4: Copilot + routingoptimalisatie

- Focus: Copilot in de medewerkersomgeving, routing afgestemd op basis van logs, veilige intents stap voor stap uitgebreid per categorie.

- Gate: Metrics blijven stabiel (CSAT constant, oplostijd verbetert, geblokkeerde beslissingen nemen af, medewerkers rapporteren tijdsbesparing).

Als je een gate niet haalt, ga dan niet door. Los eerst het beleid, de bronnen of de routing op en breid dan opnieuw uit.

Conclusie

Op dit punt is het patroon duidelijk. De meeste ingebouwde assistenten falen niet omdat ze geen fatsoenlijk antwoord kunnen schrijven, maar omdat de workflow hen laat vastleggen op uitkomsten zonder voldoende controle. Met een AI-klantenservicestrategie houd je de assistent gericht op onderzoek en concepten, en verifieer je alles wat risico met zich meebrengt voordat het de klant bereikt.

Wil je een praktische volgende stap? Kies een paar intents met laag risico, schrijf een antwoordbeleid van één pagina en begin direct met het meten van CSAT en escalatieredenen. Breid daarna de autonomie alleen uit wanneer de regels, bronnen en overdrachten betrouwbaar blijven onder echt volume.

Veelgestelde vragen

Wat zijn de beste AI-tools voor klantenservice in 2026?

Er is niet één "beste" tool voor elk team, dus het helpt om mogelijkheden te vergelijken die automatisering veilig houden. Geef prioriteit aan workflowfundamenten: verankering in goedgekeurde bronnen, betrouwbaarheids- of risicosignalen en soepele overdrachten die context behouden. Extra's zoals tooncontrole of meertalige ondersteuning zijn pas belangrijk als die basis solide is.

AI-chatbot voor klantenservice versus ingebouwde assistent: wat is het verschil?

Een ingebouwde assistent werkt binnen de workflow (concepten, samenvattingen, routing). Een klantgerichte bot praat rechtstreeks met kopers en heeft daarom strengere grenzen en voorspelbare escalatie nodig voor alles wat orderspecifiek of risicovol is.

Welke metrics moet je bijhouden voor AI in klantenservice?

Begin met kwaliteitssignalen, niet met volume: CSAT na ondersteunde interacties, escalatieredenen en geblokkeerde risicovolle beslissingen. Kijk vervolgens of overdrachten sneller verlopen en medewerkers minder tijd besteden aan zoeken en opstellen.

Wat zijn de best practices voor AI-klantenservice om hallucinaties te voorkomen?

Begin met analyse en concepten, niet met automatische antwoorden. Definieer verboden zones (geld, juridisch, uitzonderingen), eis verificatie voor alles wat risicovol is en breid het bereik alleen uit wanneer resultaten stabiel blijven bij intents met laag risico.